网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事it行业的老鸟或是对it行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

table table3 = tableenv.sqlquery("select … from table1 … ");

// 将 table2 的结果使用 table api 写入 outputtable 中,并返回结果

tableresult tableresult = table2.executeinsert(“outputtable”);

tableresult…

总结一下上面案例使用到的一些 api,让大家先对 table / sql api 的能力有一个大概了解:

* `tableenvironment`:table api 和 sql api 的都集成在一个 **统一上下文**(即 `tableenvironment`)中,其地位等同于 datastream api 中的 `streamexecutionenvironment` 的地位

* `tableenvironment::executesql`:用于 sql api 中,可以执行一段完整 ddl、dml sql。举例,方法入参可以是 `create table xxx`,`insert into xxx select xxx from xxx`。

* `tableenvironment::from(xxx)`:用于 table api 中,可以以强类型接口的方式运行。方法入参是一个表名称。

* `tableenvironment::sqlquery`:用于 sql api 中,可以执行一段查询 sql,并把结果以 table 的形式返回。举例,方法的入参是 `select xxx from xxx`。

* `table::executeinsert`:用于将 table 的结果插入到结果表中。方法入参是写入的目标表。

无论是对于 sql api 来说还是对于 table api 来说,都是使用 `tableenvironment` 接口承载我们的业务查询逻辑的。只是在用户的使用接口的方式上有区别,以上述的 java 代码为例,table api 其实就是模拟 sql 的查询方式封装了 java 语言的 lambda 强类型 api,sql 就是纯 sql 查询。table 和 sql 很多时候都是掺杂在一起的,大家理解的时候就可以直接将 table 和 sql api 直接按照 sql 进行理解,不用强行做特殊的区分。

而且博主推荐的话,直接上 sql api 就行,其实 table api 在企业实战中用的不是特别多。你说 table api 方便吧,它确实比 datastream api 方便,但是又比 sql 复杂。一般生产使用不多。

注意:由于 table 和 sql api 基本上属于一回事,后续如果没有特别介绍的话,博主就直接按照 sql api 进行介绍了。

### 2.2 sql 上下文:tableenvironment

`tableenvironment` 是使用 sql api 永远都离不开的一个接口。其是 sql api 使用的入口(上下文),就像是你要使用 java datastream api 去写一个 flink 任务需要使用到 `streamexecutionenvironment` 一样。

可以认为 `tableenvironment` 在 sql api 中的地位和 `streamexecutionenvironment` 在 datastream 中的地位是一样的,都是包含了一个 flink 任务运行时的所有上下文环境信息。大家这样对比学习会比较好理解。

`tableenvironment` 包含的功能如下:

* **catalog 管理**:`catalog` 可以理解为 flink 的 `metastore`,类似 `hive metastore` 对在 hive 中的地位,关于 flink catalog 的详细内容后续进行介绍。

* **表管理**:在 catalog 中注册表。

* **sql 查询**:(这 tmd 还用说,最基本的功能啊),就像 datastream 中提供了 `addsource`、`map`、`flatmap` 等接口。

* **udf 管理**:注册用户定义(标量函数:一进一出、表函数:一进多出、聚合函数:多进一出)函数。

* **udf 扩展**:加载可插拔 module(module 可以理解为 flink 管理 udf 的模块,是可插拔的,可以让小伙伴萌自定义 module,去支持奇奇怪怪的 udf 功能)。

datastream 和 table(table / sql api 的查询结果)之间进行转换:目前

1.13

1.13

1.13 版本的只有流任务支持,批任务不支持。

1.14

1.14

1.14 支持批任务。

接下来介绍如何创建一个 `tableenvironment`。案例为 java。

* **方法 1**:通过 `environmentsettings` 创建 `tableenvironment`

import org.apache.flink.table.api.environmentsettings;

import org.apache.flink.table.api.tableenvironment;

// 1. 就是设置一些环境信息

environmentsettings settings = environmentsettings

.newinstance()

.instreamingmode() // 声明为流任务

//.inbatchmode() // 声明为批任务

.build();

// 2. 创建 tableenvironment

tableenvironment tenv = tableenvironment.create(settings);

在

1.13

1.13

1.13 版本中:

* 如果你是 `instreamingmode`,则最终创建出来的 `tableenvironment` 实例为 `streamtableenvironmentimpl`。

* 如果你是 `inbatchmode`,则最终创建出来的 `tableenvironment` 实例为 `tableenvironmentimpl`。

它两虽然都继承了 `tableenvironment` 接口,但是 `streamtableenvironmentimpl` 支持的功能更多一些。大家可以直接去看看接口实验一下,这里就不进行详细介绍。

* **方法 2**:通过已有的 `streamexecutionenvironment` 创建 `tableenvironment`

import org.apache.flink.streaming.api.environment.streamexecutionenvironment;

import org.apache.flink.table.api.bridge.java.streamtableenvironment;

streamexecutionenvironment env = streamexecutionenvironment.getexecutionenvironment();

streamtableenvironment tenv = streamtableenvironment.create(env);

### 2.3 sql 中表的概念(外部表 table、视图 view)

一个表的全名(标识)会由三个部分组成:**catalog 名称.数据库名称.表名称**。如果 catalog 名称或者数据库名称没有指明,就会使用当前默认值 `default`。

举个例子,下面这个 sql 创建的 table 的全名为 `default.default.table1`。

tableenv.executesql(“create temporary table table1 … with ( ‘connector’ = … )”);

下面这个 sql 创建的 table 的全名为 `default.mydatabase.table1`。

tableenv.executesql(“create temporary table mydatabase.table1 … with ( ‘connector’ = … )”);

**表** 可以是 **常规的**(外部表 table),也可以是 **虚拟的**(视图 view)。

* **外部表 table**:描述的是外部数据,例如文件(hdfs)、消息队列(kafka)等。依然拿离线 hive sql 举个例子,离线中一个表指的是 hive 表,也就是所说的外部数据。

* **视图 view**:从已经存在的表中创建,视图一般是一个 sql 逻辑的查询结果。对比到离线的 hive sql 中,在离线的场景(hive 表)中 view 也都是从已有的表中去创建的。其实 flink 也是一样的。

注意:这里有不同的地方就是,离线 hive metastore 中不会有 catalog 这个概念,其标识都是 **数据库.数据表**。

### 2.4 sql 临时表、永久表

* 表(视图、外部表)可以是 **临时的**,并与单个 flink session(可以理解为 flink 任务运行一次就是一个 session)的生命周期绑定。

* 表(视图、外部表)也可以是 **永久的**,并且对多个 flink session 都生效。

**临时表**:通常保存于内存中并且仅在创建它们的 flink session(可以理解为一次 flink 任务的运行)持续期间存在。这些表对于其它 session(即其他 flink 任务或非此次运行的 flink 任务)是不可见的。因为这个表的元数据没有被持久化。如下案例:

– 临时外部表

create temporary table source_table (

user_id bigint,

name string

) with (

‘connector’ = ‘user_defined’,

‘format’ = ‘json’,

‘class.name’ = ‘flink.examples.sql._03.source_sink.table.user_defined.userdefinedsource’

);

– 临时视图

create temporary view query_view as

select *

from source_table;

**永久表**:需要外部 catalog(例如 hive metastore)来持久化表的元数据。一旦永久表被创建,它将对任何连接到这个 catalog 的 flink session 可见且持续存在,直至从 catalog 中被明确删除。如下案例:

– 永久外部表。需要外部 catalog 持久化!!!

create table source_table (

user_id bigint,

name string

) with (

‘connector’ = ‘user_defined’,

‘format’ = ‘json’,

‘class.name’ = ‘flink.examples.sql._03.source_sink.table.user_defined.userdefinedsource’

);

– 永久视图。需要外部 catalog 持久化!!!

create view query_view as

select *

from source_table;

>

> 🚀 **注意**:如果临时表和永久表使用了相同的名称(**catalog名.数据库名.表名**)。那么在这个 flink session 中,你的任务访问到这个表时,访问到的永远是临时表(即 **相同名称的表,临时表会屏蔽永久表**)。

>

>

>

### 2.5 sql 外部数据表

由于目前在实时数据的场景中多以消息队列作为数据表。此处就以 kafka 为例创建一个外部数据表。

#### 2.5.1 table api 创建外部数据表

public static void main(string[] args) throws exception {

streamexecutionenvironment env =

streamexecutionenvironment.createlocalenvironmentwithwebui(new configuration());

environmentsettings settings = environmentsettings

.newinstance()

.useblinkplanner()

.instreamingmode()

.build();

streamtableenvironment tenv = streamtableenvironment.create(env, settings);

// kafka 数据源

datastream<row> r = env.addsource(new flinkkafkaconsumer<row>(xxx));

// 将 datastream 转为一个 table api 中的 table 对象进行使用

table sourcetable = tenv.fromdatastream(r

, schema

.newbuilder()

.column("f0", "string")

.column("f1", "string")

.column("f2", "bigint")

.columnbyexpression("proctime", "proctime()")

.build());

tenv.createtemporaryview("source\_table", sourcetable);

string selectwheresql = "select f0 from source\_table where f1 = 'b'";

table resulttable = tenv.sqlquery(selectwheresql);

tenv.toretractstream(resulttable, row.class).print();

env.execute();

}

上述案例中,table api 将一个 datastream 的结果集通过 `streamtableenvironment::fromdatastream` 转为一个 table 对象来使用。

#### 2.5.2 sql api 创建外部数据表

environmentsettings settings = environmentsettings

.newinstance()

.useblinkplanner()

.instreamingmode()

.build();

streamtableenvironment tenv = streamtableenvironment.create(env, settings);

// sql api 执行 create table 创建表

tenv.executesql(

“create table kafkasourcetable (\n”

+ " f0 string,\n"

+ " f1 string\n"

+ “) with (\n”

+ " ‘connector’ = ‘kafka’,\n"

+ " ‘topic’ = ‘topic’,\n"

+ " ‘properties.bootstrap.servers’ = ‘localhost:9092’,\n"

+ " ‘properties.group.id’ = ‘testgroup’,\n"

+ " ‘format’ = ‘json’\n"

+ “)”

);

table t = tenv.sqlquery(“select * from kafkasourcetable”);

具体的创建方式就是使用 `create table xxx ddl` 定义一个 kafka 数据源(输入)表(也可以是 kafka 数据汇(输出)表)。

xdm,是不是又和 hive 一样?惊不惊喜意不意外。对比学习 +1。

### 2.6 sql 视图 view

上文已经说了,一个 view 其实就是一段 sql 逻辑的查询结果。

视图 view 在 table api 中的体现就是:一个 table 的 java 对象,其封装了一段查询逻辑。如下案例所示。

#### 2.6.1 table api 创建 view

import org.apache.flink.table.api.environmentsettings;

import org.apache.flink.table.api.tableenvironment;

environmentsettings settings = environmentsettings

.newinstance()

.instreamingmode() // 声明为流任务

.build();

tableenvironment tenv = tableenvironment.create(settings);

// table api 中的一个 table 对象

table projtable = tenv.from(“x”).select(…);

// 将 projtable 创建为一个叫做 projectedtable 的 view

tenv.createtemporaryview(“projectedtable”, projtable);

table api 是使用了 `tableenvironment::createtemporaryview` 接口将一个 table 对象创建为一个 view。

#### 2.6.2 sql api 创建 view

import org.apache.flink.table.api.environmentsettings;

import org.apache.flink.table.api.tableenvironment;

environmentsettings settings = environmentsettings

.newinstance()

.instreamingmode() // 声明为流任务

.build();

tableenvironment tenv = tableenvironment.create(settings);

string sql = “create table source_table (\n”

+ " user_id bigint,\n"

+ " name string\n"

+ “) with (\n”

+ " ‘connector’ = ‘user_defined’,\n"

+ " ‘format’ = ‘json’,\n"

+ " ‘class.name’ = ‘flink.examples.sql._03.source_sink.table.user_defined.userdefinedsource’\n"

+ “);\n”

+ “\n”

+ “create table sink_table (\n”

+ " user_id bigint,\n"

+ " name string\n"

+ “) with (\n”

+ " ‘connector’ = ‘print’\n"

+ “);\n”

+ “create view query_view as\n” // 创建 view

+ “select\n”

+ " *\n"

+ “from source_table\n”

+ “;\n”

+ “insert into sink_table\n”

+ “select\n”

+ " *\n"

+ “from query_view;”;

arrays.stream(sql.split(“;”))

.foreach(tenv::executesql);

sql api 是直接通过一段 `create view query_view as select * from source_table` 来创建的 view,是纯 sql 写法。

这种创建方式是不是贼熟悉,和离线 hive 一样。对比学习 +1。

>

> 🚀 **注意**:在 table api 中的一个 table 对象被后续的多个查询使用的场景下,table 对象不会真的产生一个中间表供下游多个查询去引用,即多个查询不共享这个 table 的结果,小伙伴萌可以理解为是一种中间表的简化写法,不会先产出一个中间表结果,然后将这个结果在下游多个查询中复用,后续的多个查询会将这个 table 的逻辑执行多次。类似于 `with tmp as (dml)` 的语法

>

>

>

### 2.7 一个 sql 查询案例

来看看一个 sql 查询案例。

* 案例场景:计算每一种商品(`sku_id` 唯一标识)的售出个数、总销售额、平均销售额、最低价、最高价。

* 数据准备:数据源为商品的销售流水(`sku_id`:商品,`price`:销售价格),然后写入到 kafka 的指定 `topic` 当中(`sku_id`:商品,`count_result`:售出个数、`sum_result`:总销售额、`avg_result`:平均销售额、`min_result`:最低价、`max_result`:最高价)。

environmentsettings settings = environmentsettings

.newinstance()

.instreamingmode() // 声明为流任务

//.inbatchmode() // 声明为批任务

.build();

tableenvironment tenv = tableenvironment.create(settings);

// 1. 创建一个数据源(输入)表,这里的数据源是 flink 自带的一个随机 mock 数据的数据源。

string sourcesql = “create table source_table (\n”

+ " sku_id string,\n"

+ " price bigint\n"

+ “) with (\n”

+ " ‘connector’ = ‘datagen’,\n"

+ " ‘rows-per-second’ = ‘1’,\n"

+ " ‘fields.sku_id.length’ = ‘1’,\n"

+ " ‘fields.price.min’ = ‘1’,\n"

+ " ‘fields.price.max’ = ‘1000000’\n"

+ “)”;

// 2. 创建一个数据汇(输出)表,输出到 kafka 中

string sinksql = “create table sink_table (\n”

+ " sku_id string,\n"

+ " count_result bigint,\n"

+ " sum_result bigint,\n"

+ " avg_result double,\n"

+ " min_result bigint,\n"

+ " max_result bigint,\n"

+ " primary key (sku\_id) not enforced\n"

+ “) with (\n”

+ " ‘connector’ = ‘upsert-kafka’,\n"

+ " ‘topic’ = ‘tuzisir’,\n"

+ " ‘properties.bootstrap.servers’ = ‘localhost:9092’,\n"

+ " ‘key.format’ = ‘json’,\n"

+ " ‘value.format’ = ‘json’\n"

+ “)”;

// 3. 执行一段 group by 的聚合 sql 查询

string selectwheresql = “insert into sink_table\n”

+ “select sku_id,\n”

+ " count(*) as count_result,\n"

+ " sum(price) as sum_result,\n"

+ " avg(price) as avg_result,\n"

+ " min(price) as min_result,\n"

+ " max(price) as max_result\n"

+ “from source_table\n”

+ “group by sku_id”;

tenv.executesql(sourcesql);

tenv.executesql(sinksql);

tenv.executesql(selectwheresql);

### 2.8 sql 与 datastream api 的转换

大家会比较好奇,要写 sql 就纯 sql 呗,要写 datastream 就纯 datastream 呗,为啥还要把这两类接口做集成呢?

博主举一个案例:在 pdd 这种发补贴券的场景下,希望可以在发的补贴券总金额超过

10000

10000

10000 元时,及时报警出来,来帮助控制预算,防止发的太多。

对应的解决方案,我们可以想到使用 sql 计算补贴券发放的结果,但是 sql 的问题在于无法做到报警。所以我们可以将 sql 的查询的结果(即 table 对象)转为 datastream,然后就可以在 datastream 后自定义报警逻辑的算子。

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

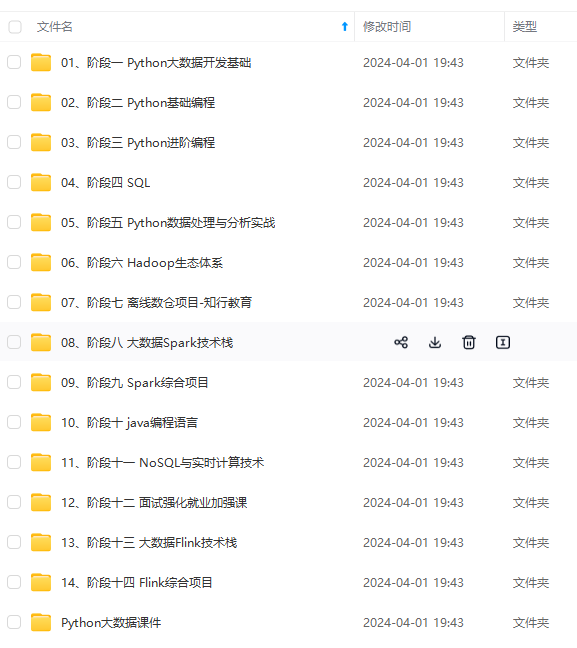

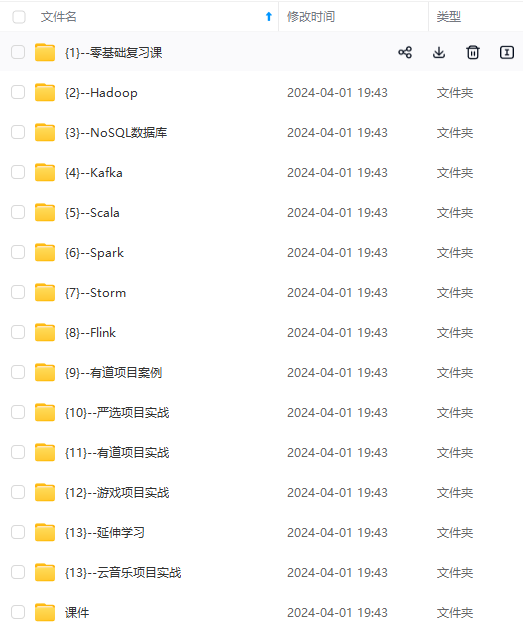

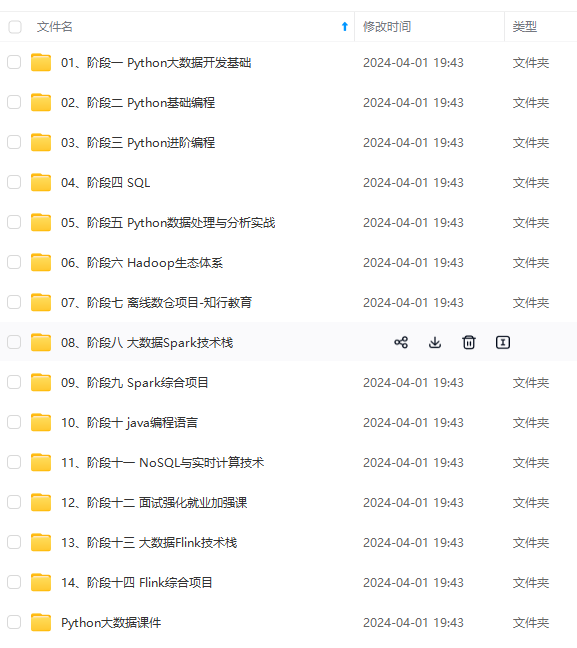

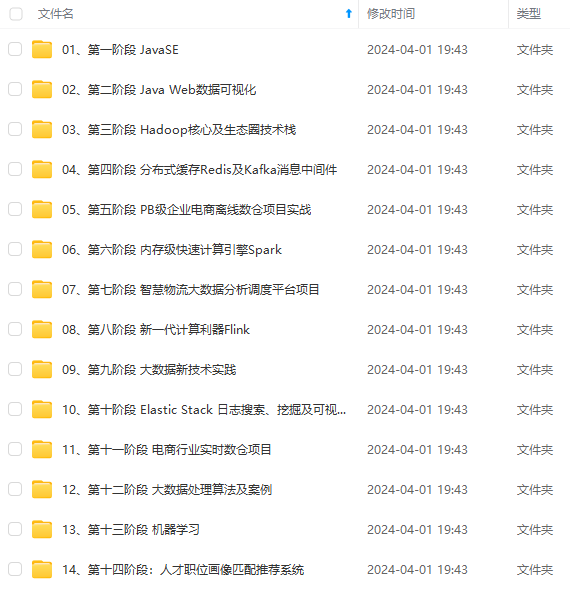

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

00

10000 元时,及时报警出来,来帮助控制预算,防止发的太多。

对应的解决方案,我们可以想到使用 sql 计算补贴券发放的结果,但是 sql 的问题在于无法做到报警。所以我们可以将 sql 的查询的结果(即 table 对象)转为 datastream,然后就可以在 datastream 后自定义报警逻辑的算子。

[外链图片转存中...(img-vl8oy5ms-1714985906554)]

[外链图片转存中...(img-bnnayvyl-1714985906555)]

[外链图片转存中...(img-zavylpnr-1714985906555)]

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

发表评论