斯坦福用几百块钱训练的alpaca,体验一下基于llama的7b和13b模型,据说比gpt3.0还牛,结果怎样??你能信?

2024年07月28日

•

内存

• 我要评论

我要评论

虽然我的服务器配置相当可以了,但是速度还是不快哦!毕竟是斯坦福大学训练的模型,对中文的确支持的不好。1、自己买个GPU服务器(如果不训练,可以随便买个高内存的即可),有些网站很便宜,小时起租!3、上面两个模型搞定跑起来之后,是否能训练自己的模型呢?,不知道哪里下载的我可以放出网盘地址。1、中文的大语言模型已经有人训练出来了。2、中文的alpaca模型也训练出来了。5、运行起来:./chat -m。好久没写代码了,上头了,强撸了!4、编译:make chat。,记得放到同一个目录哦。

好久没写代码了,上头了,强撸了!

1、自己买个gpu服务器(如果不训练,可以随便买个高内存的即可),有些网站很便宜,小时起租!

2、alpaca和模型下载地址:github - antimatter15/alpaca.cpp: locally run an instruction-tuned chat-style llm

git clone github - antimatter15/alpaca.cpp: locally run an instruction-tuned chat-style llm

cd alpaca.cpp

3、模型下载:ggml-alpaca-7b-q4.bin 、ggml-alpaca-13b-q4.bin ,不知道哪里下载的我可以放出网盘地址

4、编译:make chat

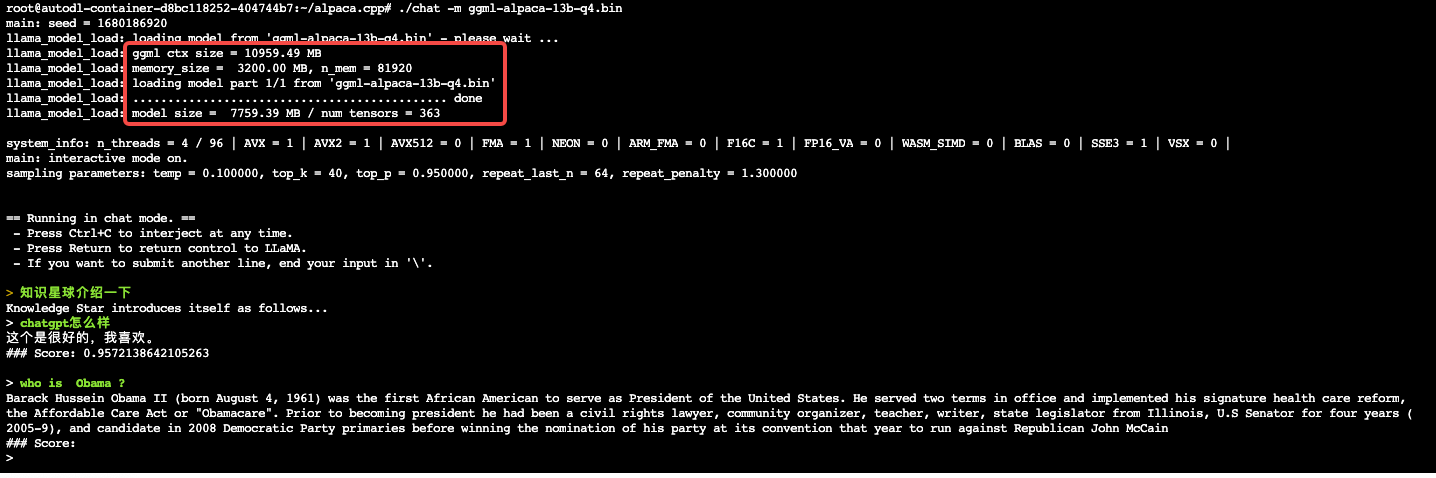

5、运行起来:./chat -m ggml-alpaca-13b-q4.bin ,记得放到同一个目录哦

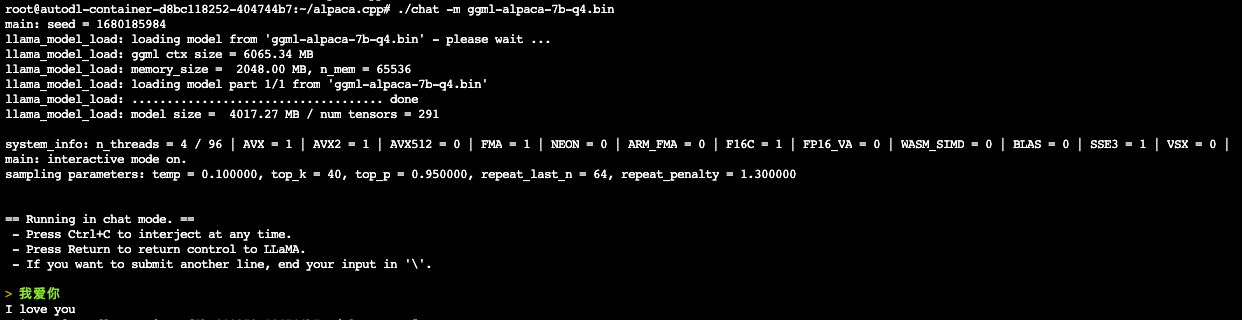

7b效果如下:

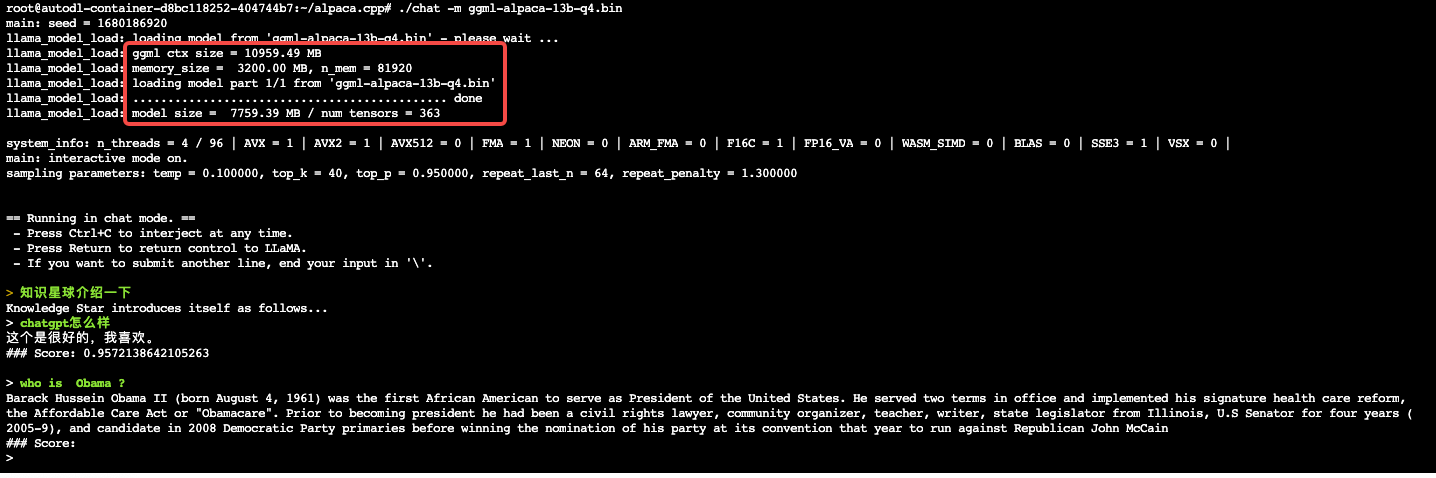

虽然我的服务器配置相当可以了,但是速度还是不快哦!毕竟是斯坦福大学训练的模型,对中文的确支持的不好

13b效果如下:

后续:

1、中文的大语言模型已经有人训练出来了

2、中文的alpaca模型也训练出来了

3、上面两个模型搞定跑起来之后,是否能训练自己的模型呢?你猜

相关文章:

-

设置RabbitMQ超时时间

RabbitMQ默认的超时时间是30分钟,在消息消费超过30分钟后,rabbitMQ会发生错误,导致整个channel被销毁,无法继续消费。值得注意的是,这个事...

[阅读全文]

-

一 zookeeper介绍首先需要了解zookeeper是什么,zookeeper是一个分布式协调服务。所谓分布式协调主要是来解决分布式系统中多个进程之间的同步限制,防止出现脏读,…

-

-

-

transformer组件在处理图像特征图中的不足。在初始化时,注意模块对特征图中的所有像素施加了几乎一致的注意权重。长时间的训练周期是为了学习注意权重,以关注稀疏的有意义的位置。…

-

版权声明:本文内容由互联网用户贡献,该文观点仅代表作者本人。本站仅提供信息存储服务,不拥有所有权,不承担相关法律责任。

如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 2386932994@qq.com 举报,一经查实将立刻删除。

发表评论