在现代 linux 系统中,固态硬盘(ssd)已经成为主流存储设备。相比传统机械硬盘(hdd),ssd 具有更快的读写速度、更低的延迟和更高的 iops,但同时也对操作系统提出了新的优化需求。不恰当的配置可能导致 ssd 寿命缩短、性能下降或系统响应迟缓。本文将深入探讨如何在 linux 环境下对 ssd 进行全面优化,涵盖文件系统选择、挂载参数调优、i/o 调度器设置、trim 支持、日志与临时文件管理、swap 配置、java 应用适配等多个方面,并辅以 java 代码示例、性能对比图表和实用工具推荐。

为什么需要为 ssd 专门优化?

虽然现代 linux 内核已经具备一定的自动识别和优化能力,但默认配置往往偏向通用性和兼容性,未必能充分发挥 ssd 的全部潜力。以下是几个关键原因:

- 写入放大(write amplification):ssd 的写入操作需先擦除再写入,频繁的小块随机写入会显著降低寿命。

- 无序写入影响寿命:ssd 的闪存单元有写入次数限制(p/e cycles),不当的日志或缓存策略可能加速磨损。

- 缺乏 trim 支持会导致性能衰减:未及时通知控制器哪些块已废弃,会导致垃圾回收效率低下。

- 默认 i/o 调度器不适合 ssd:cfq 或 deadline 可能在 ssd 上引入不必要的延迟。

- 过度的日志记录浪费 i/o 资源:如 syslog、journald 默认配置对 ssd 不友好。

优化目标:延长 ssd 寿命 + 提升系统响应速度 + 降低写入负载 + 保持长期稳定性能

第一步:检查当前磁盘类型与健康状态

在开始优化前,务必确认你正在操作的是 ssd,而非 hdd。同时评估其健康状况,避免在已有故障的设备上做无用功。

# 查看块设备信息 lsblk -d -o name,rota # rota=0 表示是 ssd,rota=1 是 hdd

# 使用 smartctl 检查 ssd 健康(需安装 smartmontools) sudo smartctl -a /dev/nvme0n1 # 或 sata ssd: sudo smartctl -a /dev/sda

关注以下 smart 属性:

media_wearout_indicator(intel)或percentage used(nvme)reallocated_sector_ctuncorrectable_error_cnt

文件系统选择与挂载优化

推荐文件系统

目前主流 linux 发行版支持多种文件系统,针对 ssd 最推荐的是:

- ext4:成熟稳定,广泛支持,易于维护

- btrfs:支持透明压缩、快照、raid,适合进阶用户

- xfs:大文件性能优异,元数据操作快

- f2fs:专为闪存设计,特别适合嵌入式或移动端,但在桌面/服务器环境稳定性待验证

实测建议:日常使用选 ext4;追求极致性能且愿意承担风险可尝试 f2fs

挂载参数调优(/etc/fstab)

编辑 /etc/fstab,为 ssd 分区添加优化参数:

uuid=xxxx-xxxx / ext4 defaults,noatime,nodiratime,discard,errors=remount-ro 0 1

参数详解:

noatime:禁止记录文件访问时间,大幅减少写入nodiratime:同上,仅针对目录(noatime 已隐含此功能)discard:启用在线 trim(争议较大,见下文)commit=60:延迟提交,每 60 秒写入一次日志(ext4 特有)

注意:discard 在某些内核或 ssd 固件下可能引起卡顿,替代方案是使用 fstrim.timer

启用 trim —— 保持长期性能的关键

trim 命令允许操作系统通知 ssd 哪些数据块已不再使用,从而让控制器提前进行垃圾回收,避免写入放大。

方法一:fstab 中启用 discard(在线 trim)

已在上文介绍,适用于大多数现代 ssd 和内核(≥4.0)。

方法二:定时 trim(推荐)

更安全、可控的方式是使用 systemd 定时任务:

# 启用每周自动 trim sudo systemctl enable fstrim.timer sudo systemctl start fstrim.timer # 手动执行一次 sudo fstrim -av

输出示例:

/:8.2 gib (8796093030 bytes) 已修剪 /boot:120 mib (125829120 bytes) 已修剪

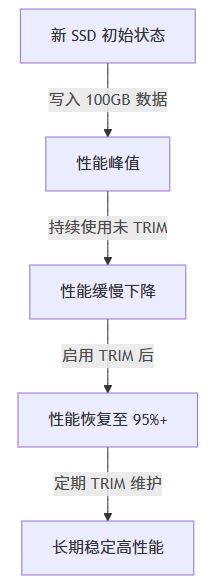

性能对比:启用 trim 前后 i/o 效率变化

从图中可见,trim 对维持 ssd 长期性能至关重要。没有 trim,ssd 会在使用几个月后出现明显的写入降速。

i/o 调度器优化

linux 使用 i/o 调度器管理磁盘请求队列。传统调度器如 cfq(completely fair queuing)为 hdd 设计,不适合 ssd。

查看当前调度器

cat /sys/block/sda/queue/scheduler # 输出示例:[mq-deadline] kyber bfq none

设置为 noop 或 none(适用于 nvme)

对于 nvme ssd,推荐使用 none(无调度):

echo 'none' | sudo tee /sys/block/nvme0n1/queue/scheduler

对于 sata ssd,可选 deadline 或 mq-deadline:

echo 'mq-deadline' | sudo tee /sys/block/sda/queue/scheduler

永久生效方法

创建 udev 规则:

sudo nano /etc/udev/rules.d/60-ssd-scheduler.rules

内容:

# nvme ssd

action=="add|change", kernel=="nvme[0-9]*", attr{queue/scheduler}="none"

# sata ssd

action=="add|change", kernel=="sd[a-z]", attr{queue/rotational}=="0", attr{queue/scheduler}="mq-deadline"重启或重新加载 udev:

sudo udevadm control --reload-rules sudo udevadm trigger

减少不必要的写入 —— 日志与临时文件优化

ssd 最怕频繁小文件写入。优化方向:

- 减少系统日志写入频率

- 将临时目录挂载到内存(tmpfs)

- 禁用访问时间更新

1. 使用 tmpfs 挂载 /tmp 和 /var/log

编辑 /etc/fstab:

tmpfs /tmp tmpfs defaults,noatime,mode=1777 0 0 tmpfs /var/log tmpfs defaults,noatime,mode=0755,size=1g 0 0 tmpfs /var/tmp tmpfs defaults,noatime,mode=1777 0 0

注意:/var/log 挂载为 tmpfs 会导致重启后日志丢失。如需保留,可改用日志轮转 + 压缩策略。

2. 优化 journald(systemd 日志)

编辑 /etc/systemd/journald.conf:

[journal] storage=volatile # 仅内存存储,重启清空 compress=yes # 启用压缩 maxretentionsec=1day # 最多保留1天 ratelimitintervalsec=30s ratelimitburst=1000 # 限流防刷爆 forwardtosyslog=no # 不转发给 syslog

重启服务:

sudo systemctl restart systemd-journald

3. 限制 rsyslog/syslog-ng 写入

如果你仍使用传统 syslog,建议:

- 降低日志级别

- 启用日志轮转压缩

- 定期清理旧日志

示例(rsyslog):

sudo nano /etc/rsyslog.conf

添加:

*.info;mail.none;authpriv.none;cron.none /var/log/messages & stop

并配置 logrotate:

sudo nano /etc/logrotate.d/custom

/var/log/*.log {

daily

missingok

rotate 7

compress

delaycompress

notifempty

create 0640 root adm

}

swap 配置优化

swap 在 ssd 上是可以使用的,但需合理配置以减少写入磨损。

1. 降低 swappiness

swappiness 控制内核倾向使用 swap 的程度(0~100,默认 60)。ssd 建议设为 10 或更低:

# 临时设置 sudo sysctl vm.swappiness=10 # 永久设置 echo 'vm.swappiness=10' | sudo tee -a /etc/sysctl.conf

2. 使用 zram 替代部分 swap(推荐)

zram 在内存中创建压缩块设备作为 swap,几乎无 i/o 开销:

sudo apt install zram-tools # ubuntu/debian sudo systemctl enable zramswap sudo systemctl start zramswap

查看状态:

zramctl free -h

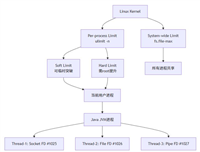

java 应用在 ssd 上的优化实践

java 应用常涉及大量临时文件、日志写入和堆外内存映射,若不加优化,极易造成 ssd 写入压力。以下是几种典型场景及优化方案。

示例 1:减少 jvm gc 日志写入频率

默认 -xloggc 会持续追加日志,对 ssd 不友好。建议:

- 使用滚动日志

- 限制文件大小

- 异步写入

// 启动参数示例 java \ -xx:+useg1gc \ -xloggc:/tmp/gc.log \ -xx:+usegclogfilerotation \ -xx:numberofgclogfiles=5 \ -xx:gclogfilesize=10m \ -xx:+printgcdetails \ -xx:+printgcdatestamps \ -jar myapp.jar

更进一步,可将 gc 日志输出到内存文件系统:

mkdir -p /tmp/applogs java -xloggc:/tmp/applogs/gc.log ...

示例 2:优化临时文件路径

java 默认使用 /tmp,可通过环境变量重定向:

export tmpdir=/dev/shm/myapp mkdir -p $tmpdir java -djava.io.tmpdir=$tmpdir -jar myapp.jar

或在代码中动态设置:

public class tempdirconfig {

public static void main(string[] args) {

// 设置临时目录为内存盘

system.setproperty("java.io.tmpdir", "/dev/shm/myapp");

file tempdir = new file(system.getproperty("java.io.tmpdir"));

if (!tempdir.exists()) {

tempdir.mkdirs();

}

try {

file tempfile = file.createtempfile("data-", ".tmp", tempdir);

system.out.println("临时文件创建于: " + tempfile.getabsolutepath());

// ... 业务逻辑

} catch (ioexception e) {

e.printstacktrace();

}

}

}示例 3:日志框架异步化 + 缓冲写入

使用 logback 或 log4j2 时,启用异步日志器可大幅降低 i/o 压力。

logback 配置(logback.xml):

<configuration>

<appender name="async" class="ch.qos.logback.classic.asyncappender">

<appender-ref ref="file"/>

<queuesize>512</queuesize>

<discardingthreshold>0</discardingthreshold>

<includecallerdata>false</includecallerdata>

</appender>

<appender name="file" class="ch.qos.logback.core.rolling.rollingfileappender">

<file>/tmp/app.log</file>

<rollingpolicy class="ch.qos.logback.core.rolling.sizeandtimebasedrollingpolicy">

<filenamepattern>/tmp/app.%d{yyyy-mm-dd}.%i.log.gz</filenamepattern>

<maxfilesize>10mb</maxfilesize>

<maxhistory>7</maxhistory>

<totalsizecap>100mb</totalsizecap>

</rollingpolicy>

<encoder>

<pattern>%d{hh:mm:ss.sss} [%thread] %-5level %logger{36} - %msg%n</pattern>

</encoder>

</appender>

<root level="info">

<appender-ref ref="async"/>

</root>

</configuration>log4j2 配置(log4j2.xml):

<?xml version="1.0" encoding="utf-8"?>

<configuration status="warn">

<appenders>

<console name="console" target="system_out">

<patternlayout pattern="%d{hh:mm:ss.sss} [%t] %-5level %logger{36} - %msg%n"/>

</console>

<randomaccessfile name="file" filename="/tmp/app.log"

filepattern="/tmp/app-%d{yyyy-mm-dd}-%i.log.gz">

<patternlayout>

<pattern>%d %p %c{1.} [%t] %m%n</pattern>

</patternlayout>

<policies>

<sizebasedtriggeringpolicy size="10 mb"/>

<timebasedtriggeringpolicy/>

</policies>

<defaultrolloverstrategy max="7"/>

</randomaccessfile>

<async name="asyncfile">

<appenderref ref="file"/>

</async>

</appenders>

<loggers>

<root level="info">

<appenderref ref="asyncfile"/>

</root>

</loggers>

</configuration>异步日志 + 滚动压缩 + 内存路径 = ssd 友好型日志方案

监控 ssd 健康与性能

优化不是一劳永逸的,需持续监控。推荐以下工具:

1. iotop —— 实时 i/o 监控

sudo apt install iotop sudo iotop -aop # 显示累计写入最多的进程

2. iostat —— 设备级统计

iostat -x 1 /dev/nvme0n1

关注 %util、await、svctm 等字段。

3. nvme-cli(nvme 专用)

sudo nvme smart-log /dev/nvme0n1 sudo nvme list

4. 自定义监控脚本(shell + java)

下面是一个简单的 java 程序,定期采集磁盘写入量并记录:

import java.io.*;

import java.time.localdatetime;

import java.time.format.datetimeformatter;

public class ssdwritemonitor {

private static final string proc_diskstats = "/proc/diskstats";

private static final string target_device = "nvme0n1"; // 修改为你的设备名

private static final string log_file = "/tmp/ssd_monitor.log";

public static void main(string[] args) throws exception {

system.out.println("ssd 写入监控启动...");

long lastwritesectors = readwritesectors();

long starttime = system.currenttimemillis();

while (true) {

thread.sleep(60000); // 每分钟采样一次

long currentwritesectors = readwritesectors();

long deltasectors = currentwritesectors - lastwritesectors;

double mbwritten = deltasectors * 512.0 / (1024 * 1024); // 转换为 mb

string timestamp = localdatetime.now().format(datetimeformatter.ofpattern("yyyy-mm-dd hh:mm:ss"));

string logentry = string.format("[%s] 写入: %.2f mb", timestamp, mbwritten);

system.out.println(logentry);

appendtofile(logentry);

lastwritesectors = currentwritesectors;

}

}

private static long readwritesectors() throws ioexception {

try (bufferedreader br = new bufferedreader(new filereader(proc_diskstats))) {

string line;

while ((line = br.readline()) != null) {

if (line.contains(target_device)) {

string[] parts = line.trim().split("\\s+");

// 第7列为已写扇区数(每个扇区512字节)

return long.parselong(parts[6]);

}

}

}

throw new runtimeexception("未找到设备: " + target_device);

}

private static void appendtofile(string content) {

try (filewriter fw = new filewriter(log_file, true);

bufferedwriter bw = new bufferedwriter(fw)) {

bw.write(content);

bw.newline();

} catch (ioexception e) {

e.printstacktrace();

}

}

}编译运行:

javac ssdwritemonitor.java java ssdwritemonitor

输出示例:

[2025-04-05 10:30:00] 写入: 128.45 mb [2025-04-05 10:31:00] 写入: 67.21 mb [2025-04-05 10:32:00] 写入: 203.89 mb

高级技巧:使用 lvm + ssd 缓存

如果你同时拥有 ssd 和 hdd,可构建混合存储池,用 ssd 作为缓存层加速访问。

步骤概览:

- 创建物理卷(pv)

- 创建卷组(vg)

- 创建逻辑卷(lv)

- 创建缓存池(cache pool)

- 将缓存池附加到 lv

# 假设 /dev/sda 是 hdd,/dev/nvme0n1p3 是 ssd 分区 sudo pvcreate /dev/sda /dev/nvme0n1p3 sudo vgcreate vg_hybrid /dev/sda /dev/nvme0n1p3 sudo lvcreate -l 500g -n lv_data vg_hybrid /dev/sda # 创建缓存池(使用 ssd) sudo lvcreate --type cache-pool -l 20g -n cache_pool vg_hybrid /dev/nvme0n1p3 # 将缓存池绑定到数据卷 sudo lvconvert --type cache --cachepool vg_hybrid/cache_pool vg_hybrid/lv_data

现在 lv_data 就是一个带 ssd 缓存的混合卷,热数据自动缓存在 ssd,冷数据留在 hdd。

ssd 寿命估算模型

ssd 寿命通常以“总写入字节数”(tbw, terabytes written)衡量。可通过以下公式粗略估算剩余寿命:

渲染错误: mermaid 渲染失败: parsing failed: lexer error on line 3, column 5: unexpected character: ->“<- at offset: 29, skipped 5 characters. lexer error on line 3, column 11: unexpected character: ->×<- at offset: 35, skipped 1 characters. lexer error on line 3, column 13: unexpected character: ->p<- at offset: 37, skipped 3 characters. lexer error on line 3, column 17: unexpected character: ->次<- at offset: 41, skipped 3 characters. lexer error on line 3, column 21: unexpected character: ->:<- at offset: 45, skipped 1 characters. lexer error on line 4, column 5: unexpected character: ->“<- at offset: 54, skipped 10 characters. lexer error on line 4, column 16: unexpected character: ->:<- at offset: 65, skipped 1 characters. lexer error on line 5, column 5: unexpected character: ->“<- at offset: 74, skipped 10 characters. lexer error on line 5, column 16: unexpected character: ->:<- at offset: 85, skipped 1 characters. lexer error on line 6, column 5: unexpected character: ->“<- at offset: 94, skipped 13 characters. lexer error on line 6, column 19: unexpected character: ->:<- at offset: 108, skipped 1 characters. parse error on line 3, column 23: expecting token of type 'eof' but found `45`. parse error on line 4, column 18: expecting token of type 'eof' but found `25`. parse error on line 5, column 18: expecting token of type 'eof' but found `15`. parse error on line 6, column 21: expecting token of type 'eof' but found `15`.

举例:

- 一块 512gb ssd,标称 tbw = 300tb

- 当前已写入 50tb

- 剩余寿命比例 = (300 - 50) / 300 = 83.3%

通过 smartctl 获取已写入量:

sudo smartctl -a /dev/nvme0n1 | grep "data units written"

换算公式:

已写入 tb = (data units written × 512 × 1000) / (1024^4)

常见误区与反模式

误区 1:完全禁用 swap

虽然减少 swap 使用有益 ssd 寿命,但完全禁用可能导致 oom killer 杀死关键进程。建议保留少量 swap + 低 swappiness。

误区 2:频繁手动 trim

fstrim 每周执行一次足够。每天甚至每小时执行反而增加控制器负担。

误区 3:不分青红皂白使用 discard

某些老旧 ssd 固件对 discard 支持不佳,会导致卡顿。建议先测试:

sudo fstrim -v / # 观察是否卡顿或报错

误区 4:忽略固件更新

ssd 固件更新常包含性能优化和 bug 修复。定期检查厂商提供的 linux 更新工具。

企业级 ssd 优化补充

在数据中心或高负载环境中,还需考虑:

- numa 绑定:确保 i/o 线程与本地 numa 节点绑定

- irq 平衡:分散中断到多个 cpu 核心

- 多队列深度调优:nvme 支持多队列,应匹配 cpu 核心数

- 预读关闭:ssd 随机读性能好,无需大预读

# 查看当前队列深度 cat /sys/block/nvme0n1/queue/nr_requests # 调整(根据负载测试调整) echo 1024 | sudo tee /sys/block/nvme0n1/queue/nr_requests

总结:ssd 优化 checklist

✅ 检查磁盘类型与健康状态

✅ 选用合适文件系统(推荐 ext4)

✅ fstab 添加 noatime,nodiratime,discard

✅ 启用 fstrim.timer 定期 trim

✅ i/o 调度器设为 none(nvme)或 mq-deadline(sata)

✅ 使用 tmpfs 挂载 /tmp, /var/log

✅ 降低 swappiness 至 10,启用 zram

✅ java 应用使用异步日志 + 内存临时目录

✅ 监控写入量与 smart 健康值

✅ 避免常见误区(如频繁 trim、完全禁用 swap)

结语

ssd 的普及极大提升了 linux 系统的整体响应速度和用户体验,但“即插即用”并不等于“最优配置”。通过合理的文件系统选择、挂载参数调优、i/o 调度器设置、trim 维护以及应用层适配(如 java 日志异步化),我们不仅能延长 ssd 使用寿命,还能获得更流畅、更稳定的系统表现。

技术的进步不应止步于硬件升级,软件层面的精细化调优同样重要。希望本文能为你提供一套完整、可落地的 ssd 优化方案,在享受极速体验的同时,守护好你的每一块闪存芯片。

优化无止境,适合自己的才是最好的。建议在生产环境变更前,先在测试机验证效果。

以上就是linux ssd磁盘的优化配置指南的详细内容,更多关于linux ssd磁盘优化配置的资料请关注代码网其它相关文章!

发表评论