目录

一、相关技术链接:

二、操作代码

cd /export/software

进入sqoop安装包所在位置

tar -zxvf sqoop-1.4.7.bin__hadoop-2.6.0.tar.gz -c /export/servers/

把sqoop安装包解压到servers目录下

cd /export/servers/

mv sqoop-1.4.7.bin__hadoop-2.6.0 sqoop

cd ./sqoop/conf

mv sqoop-env-template.sh sqoop-env.sh

vim sqoop-env.sh

export hadoop_common_home=/export/servers/hadoop-2.7.2

export hadoop_mapred_home=/export/servers/hadoop-2.7.2

export hive_home=/export/servers/hive

export hive_conf_dir=$hive_home/conf

export zookeeper_home=/export/servers/zookeeper

export zoocfgdir=/export/servers/conf

找到sqoop-env.sh文件添加这些内容

#hive是要自己取下载包来安装的

vim /etc/profile

sqoop_home=/export/servers/sqoop

path=$path:$sqoop_home/bin

classpath=$classpath:$sqoop_home/lib

export sqoop_home path classpath

source /etc/profile

添加sqoop环境变量

mv /home/kie/mysql-connector-java-5.1.31.jar /export/servers/sqoop/lib

把mysql的驱动包导入sqoop的lib目录下

sqoop list-databases --connect jdbc:mysql://localhost:3306/ --username root --password root

sqoop list-tables --connect jdbc:mysql://localhost:3306/test -username root -password root

登入mysql查看数据库和表

sqoop import --connect jdbc:mysql://localhost:3306/test -username root -password root -table webs -hive-import --create-hive-table -m 1 --target-dir /webs --hive-table dblab.webs

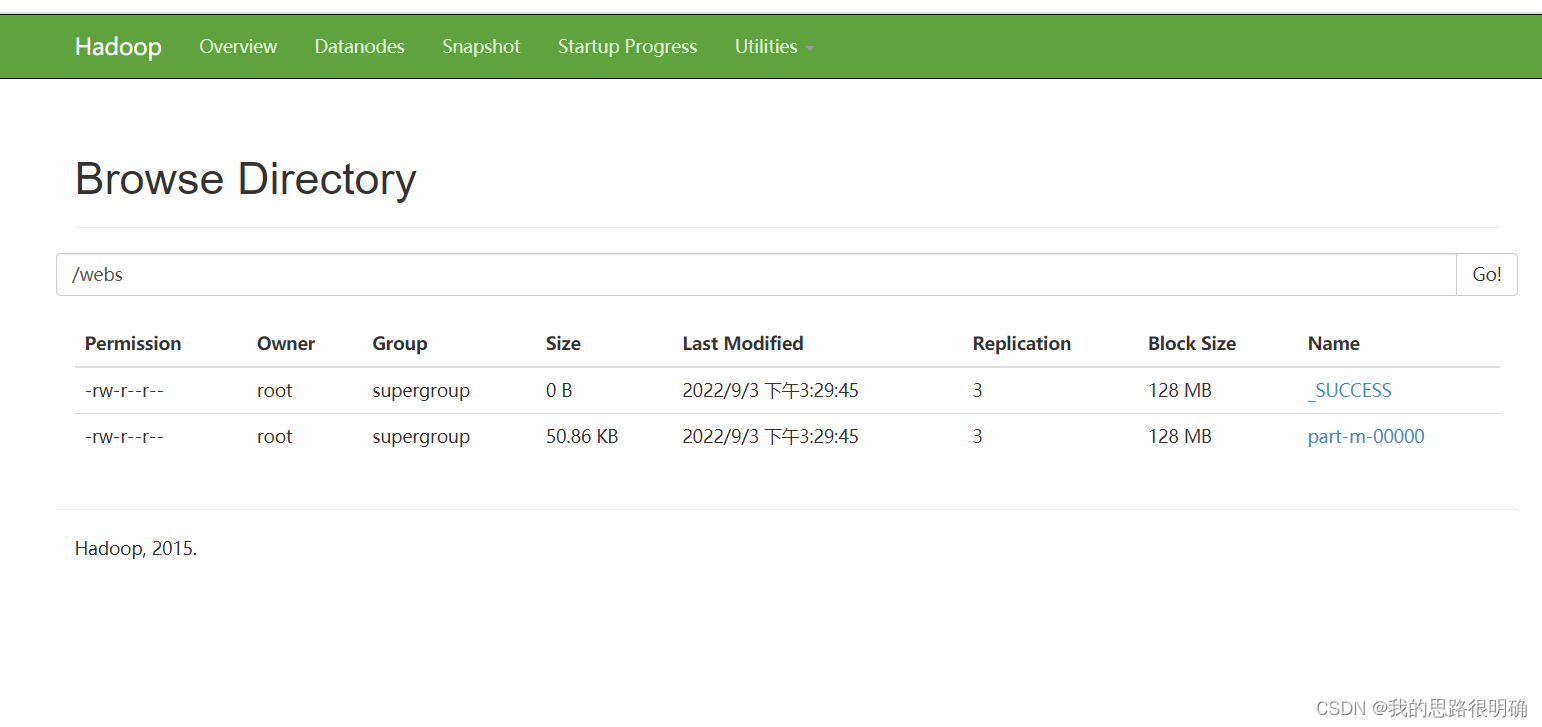

import从mysql的webs表中导入数据到hdfs中,创建表,指定目录是webs

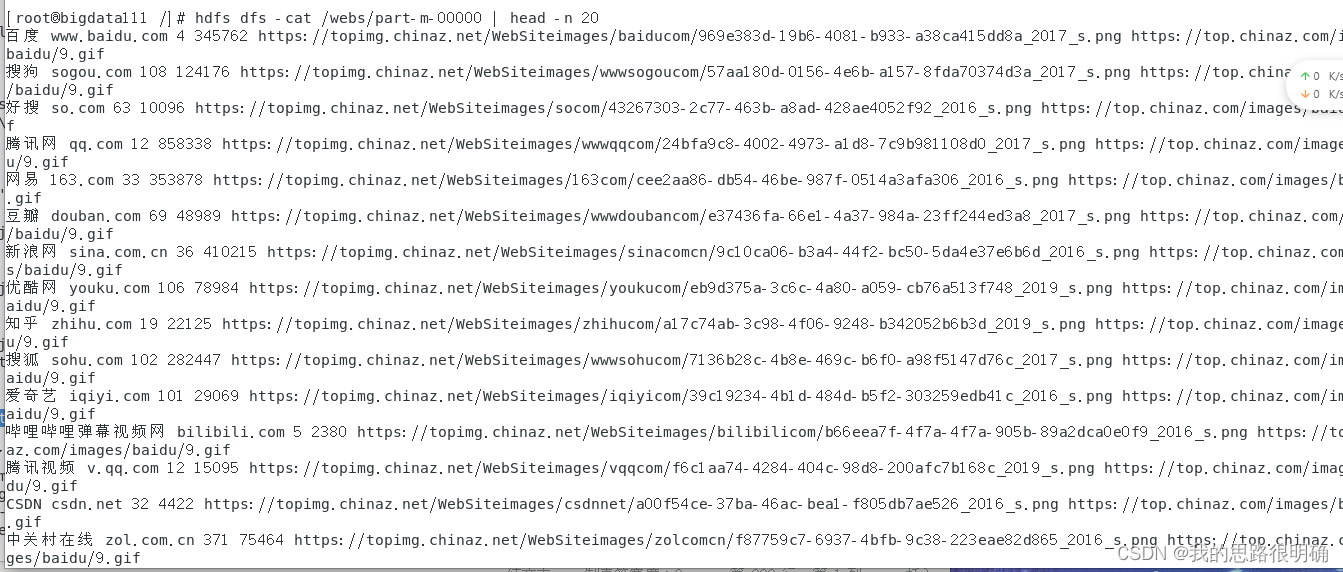

hdfs dfs -cat /webs/part-m-00000 | head -n 20

利用hdfs命令查看webs对应目录下的数据文件part-m-00000的前二十行

三、实现结果

这里打开我的http://bigdata111:50070/主页,在后面找到browse directory就可以看到hdfs对应的数据库下的目录文件,同时也可以下载.

发表评论