apachespark是一个开源的大数据处理框架,它提供了丰富的功能和api,用于分布式数据处理、数据分析和机器学习等任务。在springboot中整合apachespark可以实现更加灵活和高效的数据分析应用。下面我们就来看看如何在springboot应用中整合apachespark。

第一步、添加依赖

由于需要用到apache spark数据处理相关的功能,所以需要引入spark的sql依赖,如下所示。

<dependency>

<groupid>org.apache.spark</groupid>

<artifactid>spark-sql_2.12</artifactid>

<version>3.4.2</version>

</dependency>

第二步、编写配置类

在springboot项目中创建sparkconfig配置类并且添加sparksession的依赖bean。

@configuration

public class sparkconfig {

@bean

public sparksession sparksession() {

return sparksession.builder()

.appname("springbootsparkintegration")

.master("local[*]") // 在本地模式下运行

.getorcreate();

}

}

第三步、编写控制类

创建一个controller类,用于处理请求并调用apachespark进行数据分析

@restcontroller

@requestmapping("/test")

public class testcontroller {

@autowired

private sparksession sparksession;

@getmapping("/analyze")

public map<string,object> test(){

map<string,object> ajax = new hashmap<>();

// 创建 sparkcontext

javasparkcontext sparkcontext = javasparkcontext.fromsparkcontext(sparksession.sparkcontext());

// 创建一个 rdd

javardd<integer> datardd = sparkcontext.parallelize(arrays.aslist(1, 2, 3, 4, 5));

// 执行一些数据分析操作

long count = datardd.count();

list<person> personlist = arrays.aslist(new person("alice", 30), new person("bob", 25));

// 创建一个 dataset

dataset<row> dataset = sparksession.createdataframe(personlist, person.class);

// 执行一些 sql 查询

dataset.createorreplacetempview("people");

dataset<row> result = sparksession.sql("select * from people");

ajax.put("data",count);

ajax.put("result",result.collectaslist().get(0).json());

sparksession.stop();

return ajax;

}

}

person实体类如下所示。

public class person implements serializable {

private string name;

private int age;

public person() {}

public person(string name, int age) {

this.name = name;

this.age = age;

}

// getters and setters

}

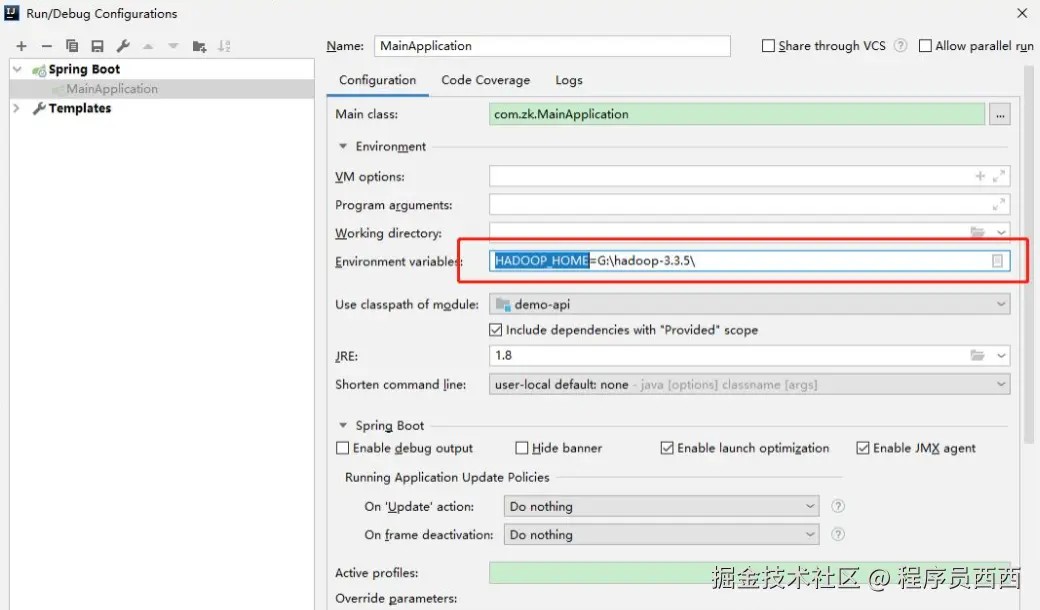

这里需要注意,直接引入apache spark的时候,在项目启动的时候会报一个hadoop_home不存在的异常。这个异常是可以忽略的,当然如果需要解决的话,就可以到

添加配置完成之后项目启动就正常了。

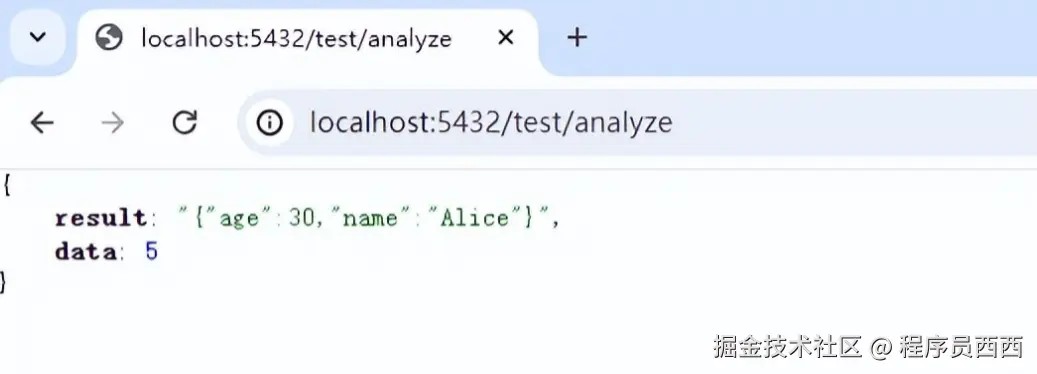

启动项目并测试

启动springboot应用,并访 /analyze路径,即可触发数据分析操作。如下所示。

总结

到这里,你就可以在springboot应用中使用apachespark进行数据分析了。当然,实际应用中可能会涉及更加复杂的数据处理和分析任务,你可以根据实际需求扩展和优化代码。

以上就是springboot整合apache spark实现一个简单的数据分析功能的详细内容,更多关于springboot数据分析的资料请关注代码网其它相关文章!

![Java中将byte[]转MultipartFile的具体实现方式](/images/newimg/nimg4.png)

发表评论