故障转移

集群的master节点会监控集群中的节点状态,如果发现有节点宕机,会立即将宕机节点的分片数据迁移到其它节点,确保数据安全,这个叫做故障转移。

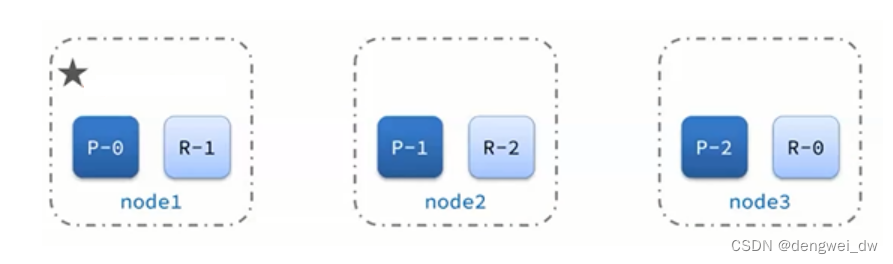

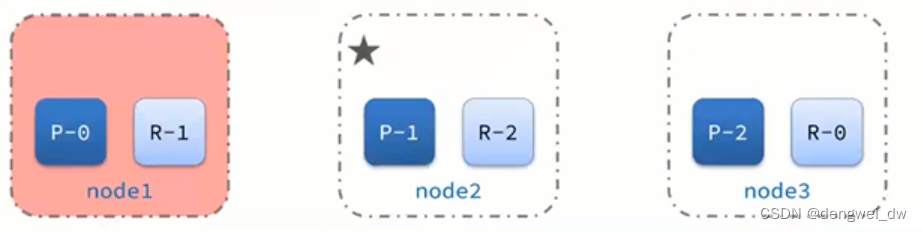

下图中node1是主节点,其他两个节点是从节点

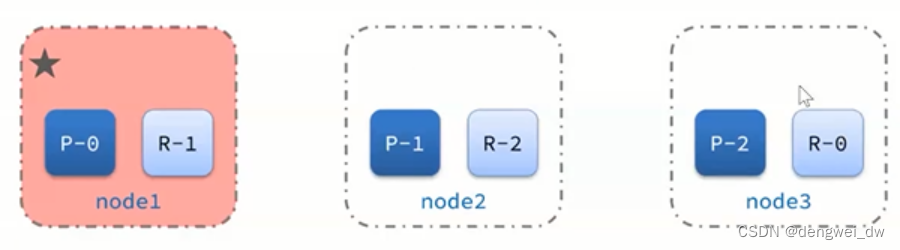

节点故障

此时node1节点发生故障

宕机后的第一件事就是重新选主,此时选中node2

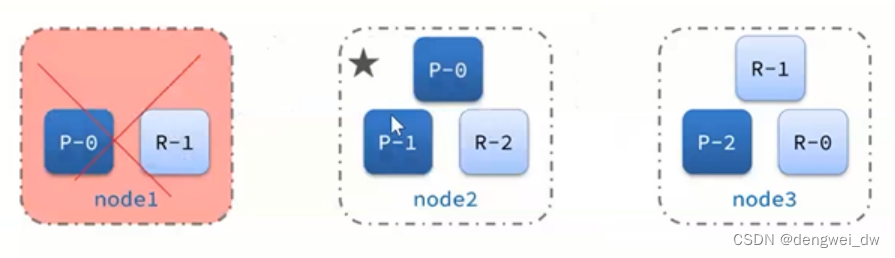

数据迁移

node2成为主节点后,会检测集群监控状态,发现:shard-1、shard-0没有副本节点,因此需要将node1上的数据迁移到node2、node3

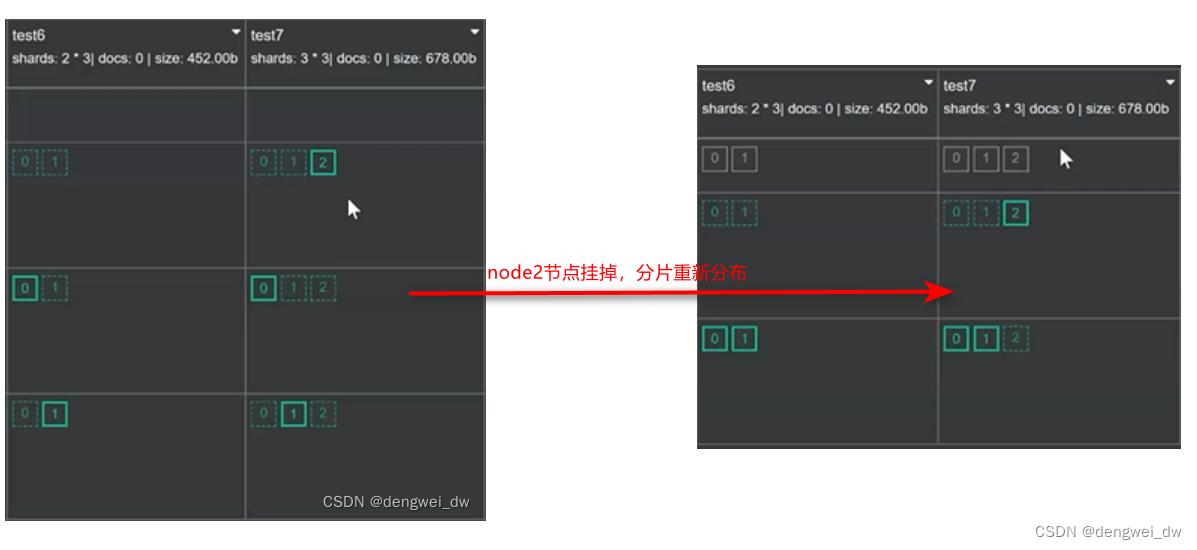

节点恢复

当节点1进行恢复后,则数据分布的状态从上图进行反转。

扩缩容

扩容节点

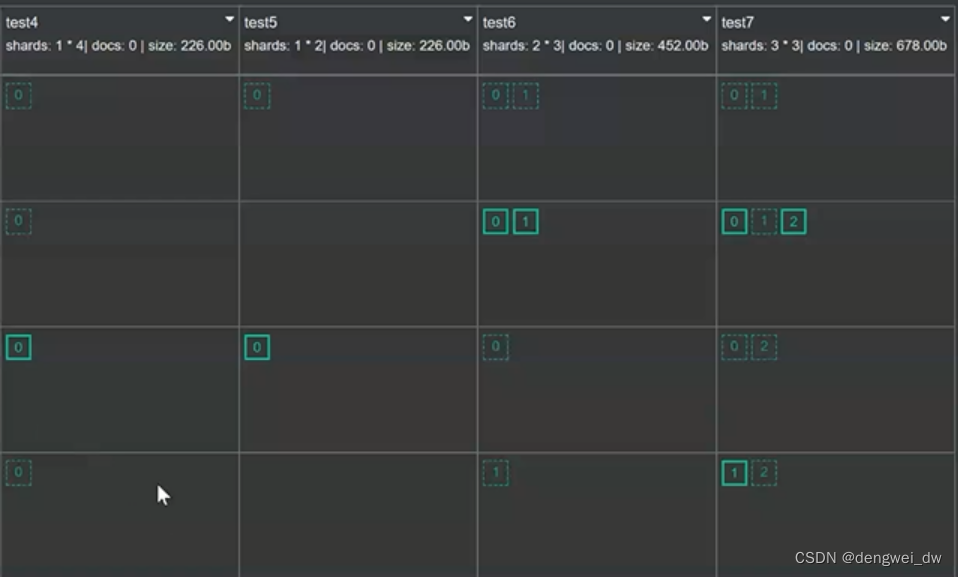

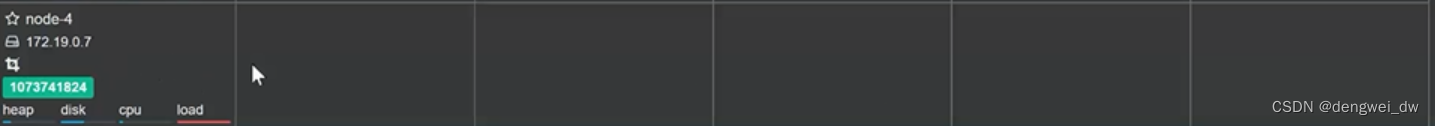

其中node4节点为需要扩容的节点

创建节点目录

# 以下为演示,请根据实际情况建立es的目录

mkdir -p /tmp/elasticsearch/node-4/{config,plugins,data,1og}#进行授权

chmod 777 /tmp/elasticsearch/node-4/{config,plugins,data,1og}添加ik分词器

cp-r /tmp/elasticsearch/node-1/plugins/ik/ /tmp/elasticsearch/node-4/plugins/编写配置文件

vi /tmp/elasticsearch/node-4/config/elasticsearch.ym1

#集群名称

cluster.name: elast

#当前该节点的名称

node.name: node-4

#是不是有资格竞选主节点

node.master:true

#是否存储数据

node.data: true#最大集群节点数

node.max_1oca1_storage_nodes:3#给当前节点自定义属性(可以省略)

#node.attr.rack:rl

#数据存档位置

path.data:/usr/share/elasticsearch/data#日志存放位置

path.logs:/usr/share/elasticsearch/1og#是否开启时锁定内存(默认为是)

#bootstrap.memory_lock:true

#设置网关地址,我是被这个坑死了,这个地址我原先填写了自己的实际物理ip地址,

#然后启动一直报无效的ip地址,无法注入9300口,这里只需要填写0.0.0.0

network.host:0.0.0.0

#设置映射端口

http.port:9200

#内部节点之间沟通端口

transport.tcp.port:9300

#集群发现默认值为127.0.0.1:9300,如果要在其他主机上形成包含节点的群集,如果搭建集群则需要填写

#es7.x 之后新增的配置,写入候选主节点的设备地址,在开启服务后可以被选为主节点,也就是说把所有的节点都写上

discovery.seed hosts:["node-1","node-2","node-3"]

#当你在搭建集群的时候,选出合格的节点集群,有些人说的太官方了,

#其实就是,让你选择比较好的几个节点,在你节点启动时,在这些节点中选一个做领导者,

#如果你不设置呢,elasticsearch就会自己选举,这里我们把三个节点都写上cluster.initial_master_nodes:["node-1","node-2","node-3"]

#在群集完全重新启动后阻止初始恢复,直到启动n个节点

#简单点说在集群启动后,至少复活多少个节点以上,那么这个服务才可以被使用,否则不可以被使用,gateway.recover after nodes:2

#删除索引是是否需要显示其名称,默认为显示

#action.destructive_requires_name: true

#禁用安全配置,否则查询的时候会提示警告

xpack.security.enabled:false编写部署文档

vi docker-compose.yml以下是之前的node1-node3的部署的yml

version: "3"

services:

node-1:

image: elasticsearch:7.17.5

container_name: node-1

environment:

- "es_java_opts=-xms1024m -xmx1024m"

- "tz=asia/shanghai"

ulimits:

memlock:

soft: -1

hard: -1

nofile:

soft: 65536

hard: 65536

ports:

- "9200:9200"

logging:

driver: "json-file"

options:

max-size: "50m"

volumes:

- /tmp/data/elasticsearch/node-1/config/elasticsearch.yml:/usr/share/elasticsearch/config/elasticsearch.yml

- /tmp/data/elasticsearch/node-1/plugins:/usr/share/elasticsearch/plugins

- /tmp/data/elasticsearch/node-1/data:/usr/share/elasticsearch/data

- /tmp/data/elasticsearch/node-1/log:/usr/share/elasticsearch/log

networks:

- elastic

node-2:

image: elasticsearch:7.17.5

container_name: node-2

environment:

- "es_java_opts=-xms1024m -xmx1024m"

- "tz=asia/shanghai"

ulimits:

memlock:

soft: -1

hard: -1

nofile:

soft: 65536

hard: 65536

ports:

- "9201:9200"

logging:

driver: "json-file"

options:

max-size: "50m"

volumes:

- /tmp/data/elasticsearch/node-2/config/elasticsearch.yml:/usr/share/elasticsearch/config/elasticsearch.yml

- /tmp/data/elasticsearch/node-2/plugins:/usr/share/elasticsearch/plugins

- /tmp/data/elasticsearch/node-2/data:/usr/share/elasticsearch/data

- /tmp/data/elasticsearch/node-2/log:/usr/share/elasticsearch/log

networks:

- elastic

node-3:

image: elasticsearch:7.17.5

container_name: node-3

environment:

- "es_java_opts=-xms1024m -xmx1024m"

- "tz=asia/shanghai"

ulimits:

memlock:

soft: -1

hard: -1

nofile:

soft: 65536

hard: 65536

ports:

- "9202:9200"

logging:

driver: "json-file"

options:

max-size: "50m"

volumes:

- /tmp/data/elasticsearch/node-3/config/elasticsearch.yml:/usr/share/elasticsearch/config/elasticsearch.yml

- /tmp/data/elasticsearch/node-3/plugins:/usr/share/elasticsearch/plugins

- /tmp/data/elasticsearch/node-3/data:/usr/share/elasticsearch/data

- /tmp/data/elasticsearch/node-3/log:/usr/share/elasticsearch/log

networks:

- elastic

kibana:

container_name: kibana

image: kibana:7.17.5

volumes:

- /tmp/data/kibana/config/kibana.yml:/usr/share/kibana/config/kibana.yml

ports:

- 5601:5601

networks:

- elastic

cerebro:

image: lmenezes/cerebro:0.9.4

container_name: cerebro

environment:

tz: 'asia/shanghai'

ports:

- '9000:9000'

networks:

- elastic

networks:

elastic:

driver: bridge在以上的配置中加入node4,执行一下命令

docker-compose up -dput /_cluster/settings

{

"persistent":

{"cluster.routing.allocation.exclude._name": null}

}可以观察到数据有迁移到新加入的node4节点中

节点缩容

禁止数据分配

put /_cluster/settings

{

"persistent":

{"cluster.routing.allocation.exclude._name": node-4}

}

关闭节点node-4

docker-compose stop node-4此时观察集群状态,发现节点4已经移除,并且整个集群正常运行。

发表评论