引言

随着语音交互技术的发展,如何高效地处理用户的语音输入成为许多应用的重要课题。本文将详细介绍如何在一个java项目中同时实现:

- 基于vosk的本地语音识别:无需调用云端api即可完成语音到文本的转换。

- 本地热点语音内容识别:对识别出的文本进行关键词匹配,快速响应特定指令或查询。

- 集成阿里云智能语音服务:利用阿里云提供的高级语音功能,如更准确的语音识别、情感分析等。

一、准备工作

1. 注册阿里云账号并开通 asr 服务

- 访问 阿里云官网

- 登录控制台,搜索“智能语音交互”

- 开通服务并创建 appkey 和 accesskey

2. 环境准备

- jdk 1.8+

- maven 或 gradle 构建工具

- 支持上传 .wav 或 .pcm 音频文件

- 下载 vosk sdk 及中文模型

3.maven 依赖

<dependencies>

<!-- vosk java sdk -->

<dependency>

<groupid>org.vosk</groupid>

<artifactid>vosk-java</artifactid>

<version>0.3.34</version>

</dependency>

<!-- alibaba cloud sdk for java -->

<dependency>

<groupid>com.alibaba.nls</groupid>

<artifactid>nls-sdk-java</artifactid>

<version>3.0.5</version>

</dependency>

</dependencies>

二、核心代码实现

1. 定义热点词汇库(本地关键词)

import java.util.hashset;

import java.util.set;

public class hotspotwords {

public static final set<string> hot_words = new hashset<>(set.of(

"你好", "退出", "播放音乐", "打开设置", "天气怎么样", "帮我查一下"

));

}

2. 使用 vosk 进行本地语音识别 + 热点检测

import org.vosk.model;

import org.vosk.recognizer;

import org.vosk.libvosk;

import javax.sound.sampled.*;

import java.io.file;

import java.io.ioexception;

public class localasrwithhotspot {

// 检测是否为热点语音

private static boolean ishotspot(string text) {

return hotspotwords.hot_words.stream().anymatch(text::contains);

}

public static void main(string[] args) throws exception {

// 初始化 vosk 库

libvosk.setloglevel(0); // 设置日志级别

// 加载本地模型(路径根据实际修改)

model model = new model("models/cn-small");

// 打开音频文件

file audiofile = new file("samples/audio.wav");

audioinputstream ais = audiosystem.getaudioinputstream(audiofile);

// 转换音频格式为 pcm 16bit 单声道 16khz

audioformat targetformat = new audioformat(16000, 16, 1, true, false);

audioinputstream convertedstream = audiosystem.getaudioinputstream(targetformat, ais);

// 创建识别器

recognizer recognizer = new recognizer(model, 16000);

byte[] buffer = new byte[4096];

int bytesread;

system.out.println("开始本地语音识别...");

while ((bytesread = convertedstream.read(buffer)) >= 0) {

if (bytesread > 0) {

recognizer.acceptwaveform(buffer, bytesread);

}

}

string result = recognizer.finalresult();

system.out.println("最终识别结果: " + result);

// 热点检测

if (ishotspot(result)) {

system.out.println("发现热点语音内容: " + result);

} else {

system.out.println("非热点语音内容");

}

// 关闭资源

recognizer.close();

convertedstream.close();

ais.close();

}

}

3. 集成阿里云智能语音服务

为了增强语音识别能力或使用更多高级功能,我们可以结合阿里云智能语音服务。以下是一个简单的示例:

import com.alibaba.nls.client.protocol.asr.asrpidcallback;

import com.alibaba.nls.client.protocol.asr.speechtranscriber;

import com.alibaba.nls.client.protocol.asr.speechtranscriberresponse;

import java.io.file;

import java.util.concurrent.countdownlatch;

public class aliyunasrintegration {

public static void main(string[] args) throws exception {

string accesskeyid = "<your-access-key-id>";

string accesskeysecret = "<your-access-key-secret>";

string appkey = "<your-appkey>";

string audiofilepath = "path/to/audio.wav"; // 支持 wav/pcm/amr

countdownlatch latch = new countdownlatch(1);

speechtranscriber asrclient = new speechtranscriber(accesskeyid, accesskeysecret, appkey, new asrpidcallback() {

@override

public void onrecognitionresultchange(speechtranscriberresponse response) {

string result = response.gettranscript();

system.out.println("实时识别结果:" + result);

}

@override

public void onrecognitioncompleted(speechtranscriberresponse response) {

string finalresult = response.gettranscript();

system.out.println("最终识别结果:" + finalresult);

latch.countdown();

}

@override

public void ontaskfailed(speechtranscriberresponse response) {

system.err.println("识别失败: " + response.geterrormsg());

latch.countdown();

}

});

// 设置语言模型、采样率等参数(根据音频格式调整)

asrclient.setformat("pcm"); // 可改为 wav/amr

asrclient.setsamplerate(16000); // 根据音频采样率调整

// 启动识别任务

file audiofile = new file(audiofilepath);

asrclient.start(audiofile);

latch.await(); // 等待识别完成

asrclient.stop(); // 停止客户端

}

}

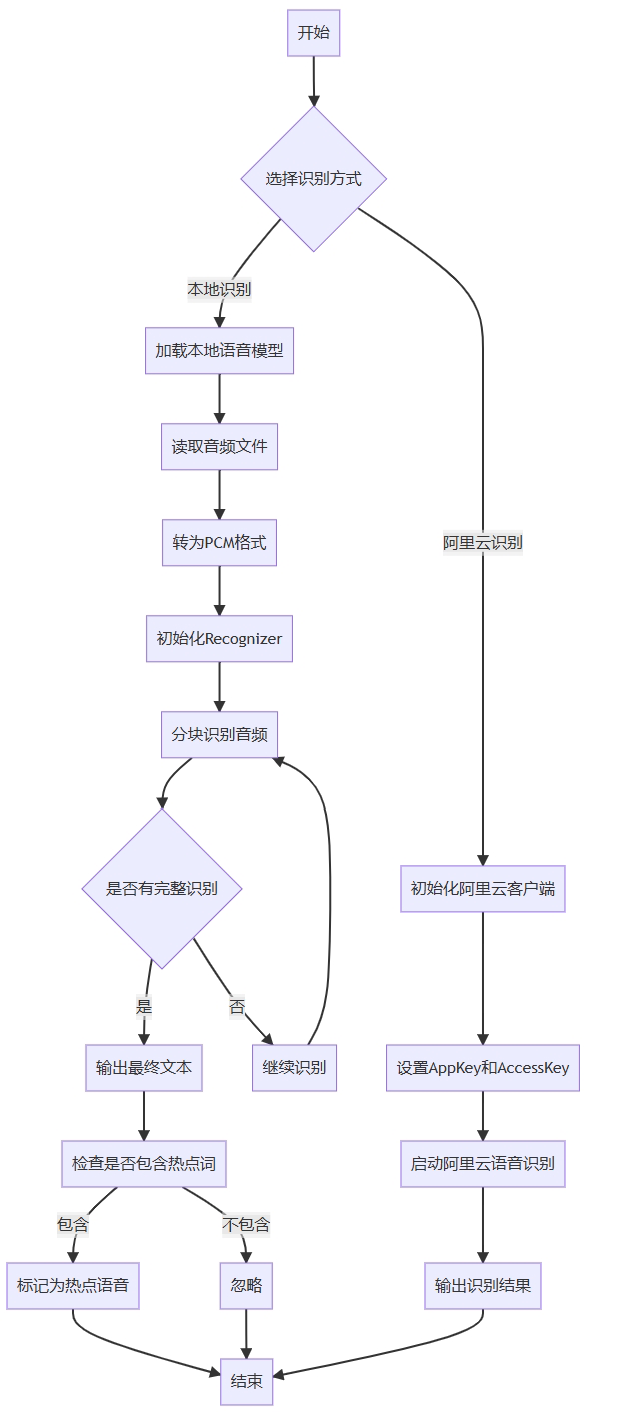

三、流程图说明

四、总结与展望

通过本文,你现在可以在一个java项目中实现:

- 本地语音识别:使用vosk引擎,在没有网络连接的情况下也能完成语音到文本的转换。

- 本地热点语音内容识别:对识别出的文本进行关键词匹配,快速响应特定指令或查询。

- 集成阿里云智能语音服务:当需要更高的准确性或更多的高级功能时,可以轻松切换到阿里云的服务。

这种方法不仅提高了系统的灵活性和隐私保护水平,还能根据具体需求灵活调整策略。

以上就是java实现本地语音识别与热点检测详解的详细内容,更多关于java语音识别与热点检测的资料请关注代码网其它相关文章!

发表评论