spark,一个数据处理框架和计算引擎。

下载

local模式即本地模式,就是不需要任何其他节点资源就可以在本地执行spark代码的环境。用于练习演示。

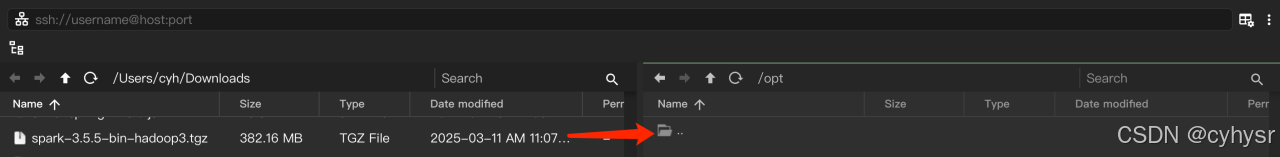

上传解压

使用portx将文件上传至/opt

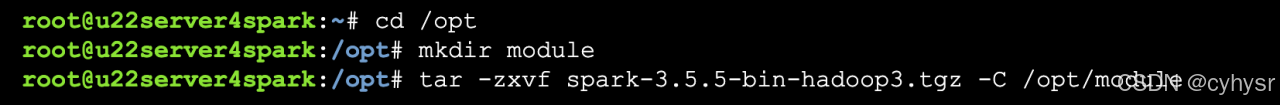

进入/opt目录,创建目录module,解压文件至/opt/module

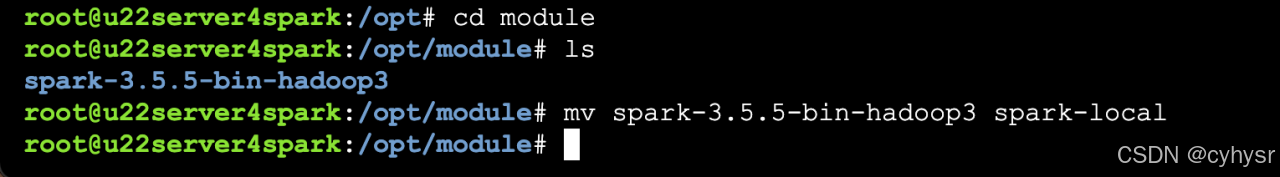

进入module,并修改名称

配置jdk

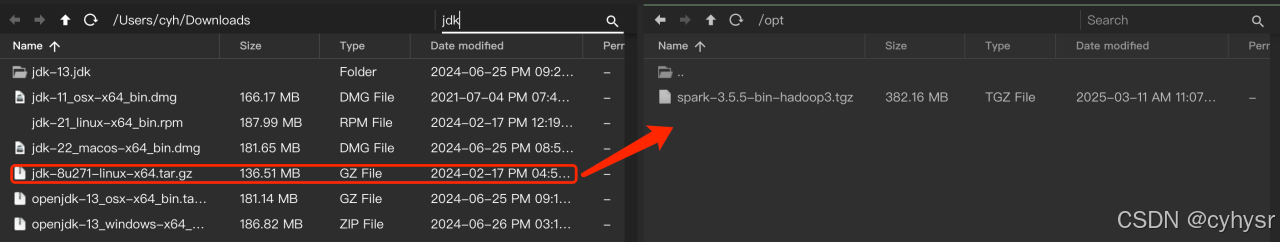

启动spark前要安装jdk,上传jdk文件

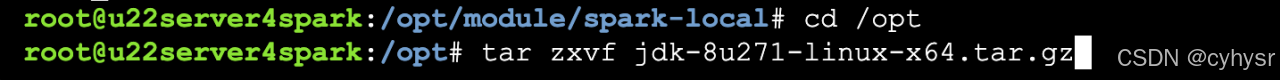

解压

tar zxvf jdk-8u271-linux-x64.tar.gz

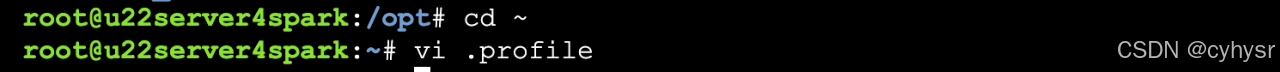

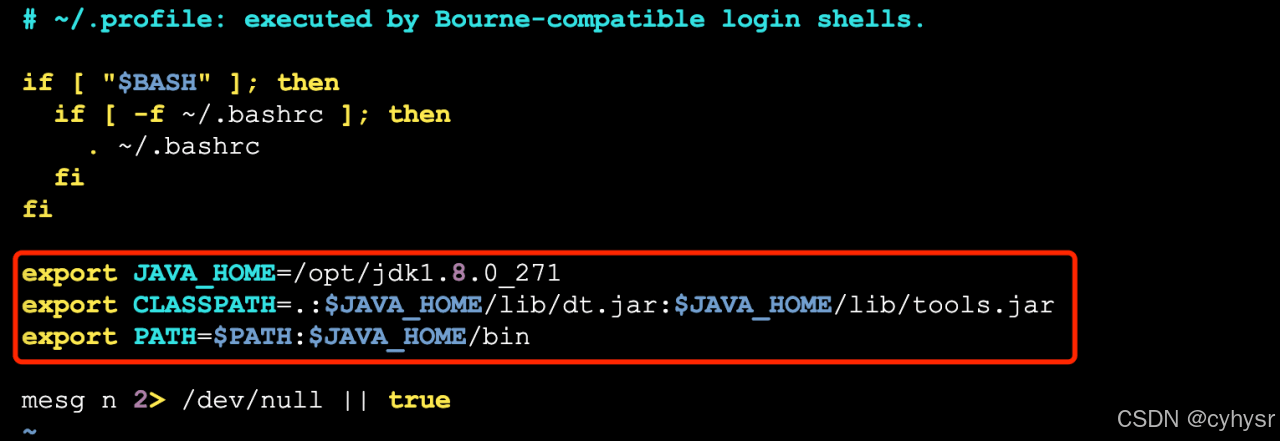

配置环境变量

以root用户配置环境变量

cd ~

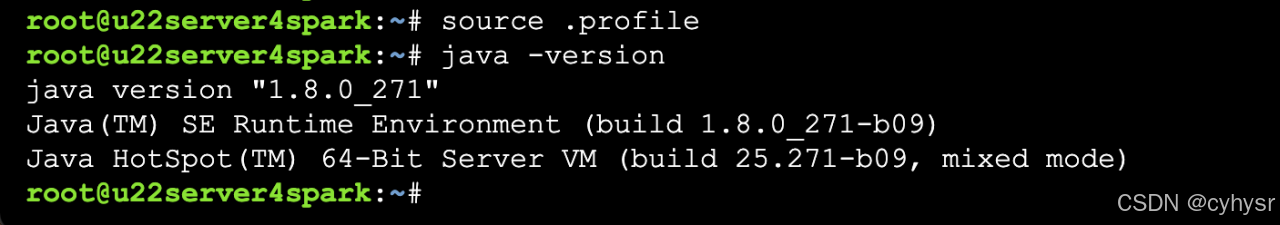

保存后,以root用户,执行source .profle,使更改生效,并验证。

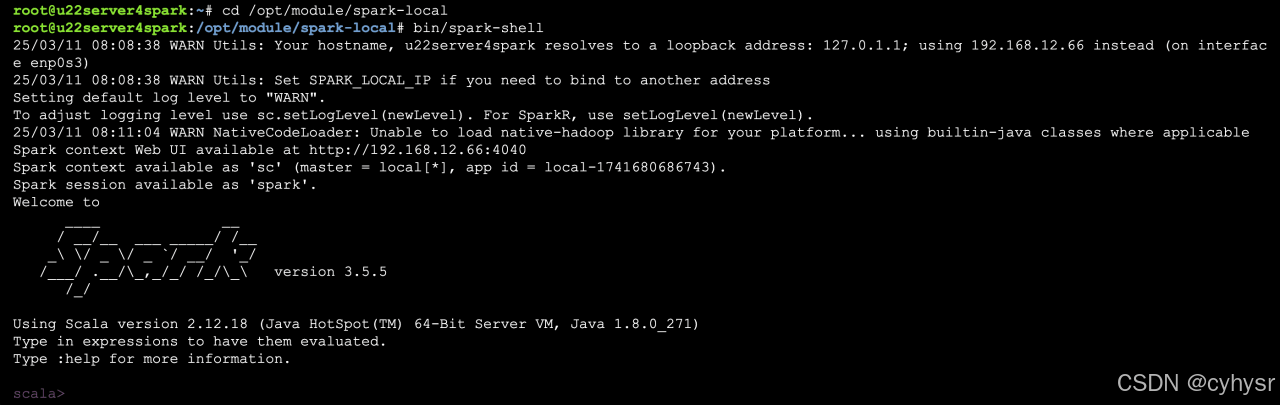

启动查看

进入spark-local,执行命令bin/spark-shell 启动spark,如下所示则成功启动

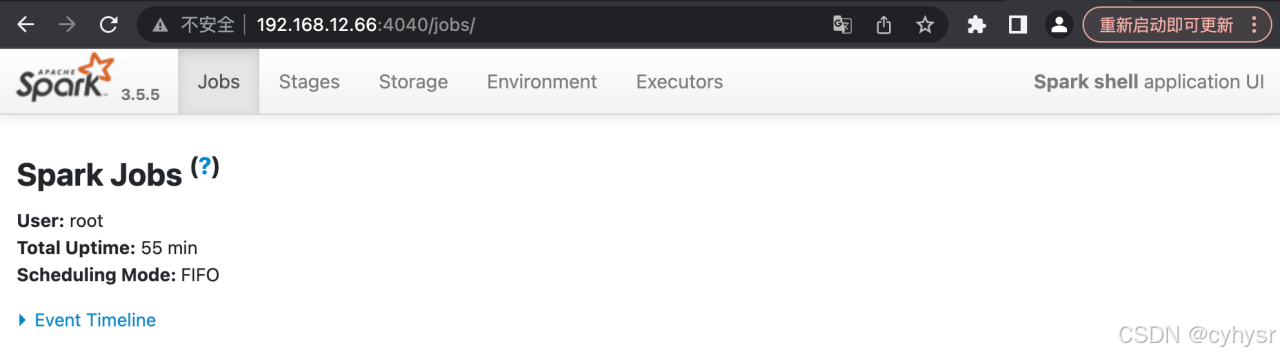

启动成功后,可以通过浏览器访问webui监控页面

http://ip:4040

交互操作

使用命令行或者提交作业的方式,与spark进行交互。

命令行

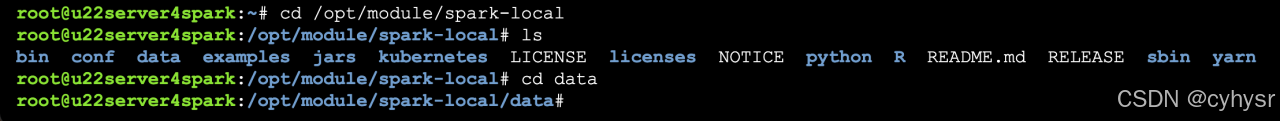

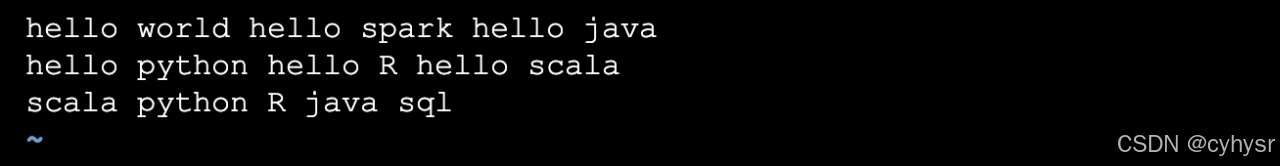

进入spark目录中的data文件夹,添加test.txt文件

vi test.txt

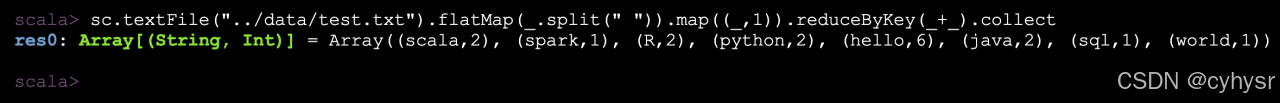

进入spark-standalone/bin目录,执行./spark-shell,启动命令行,执行以下内容

sc.textfile("../data/test.txt").flatmap(_.split(" ")).map((_,1)).reducebykey(_+_).collect

退出ctrl+c或者输入:quit后回车

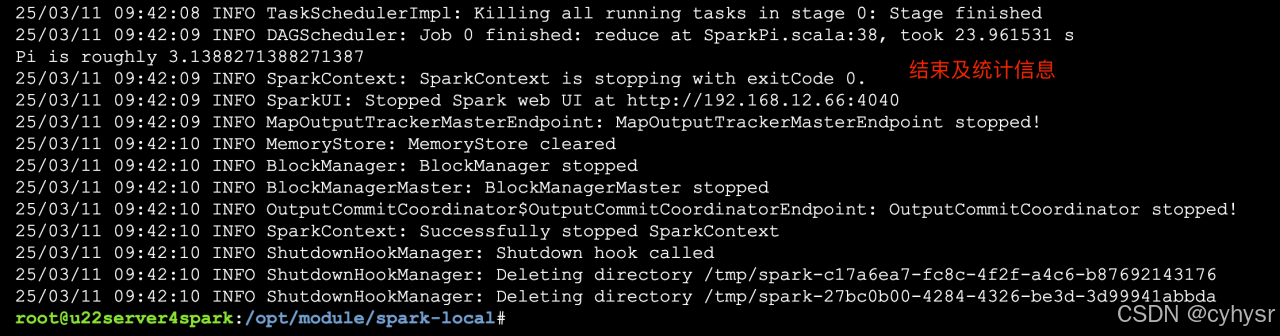

提交应用

对于公司大数据的批量处理或周期性数据分析/处理任务,通常采用编写好的spark程序,并通过spark-submit指令的方式提交给spark集群进行具体的任务计算。

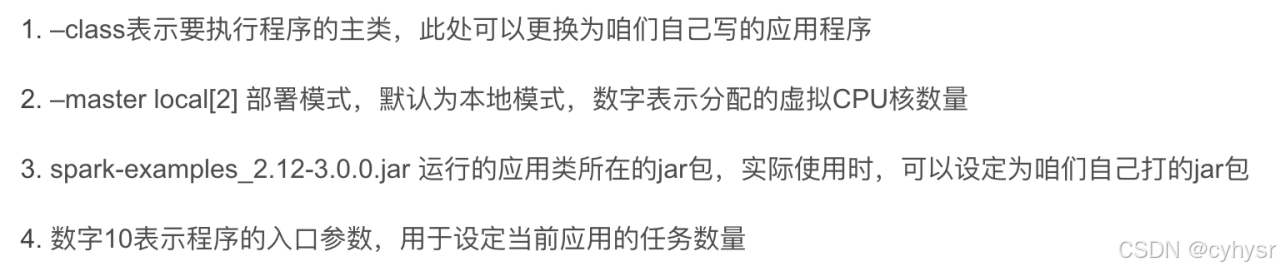

bin/spark-submit \

--class org.apache.spark.examples.sparkpi \

--master local[2] \

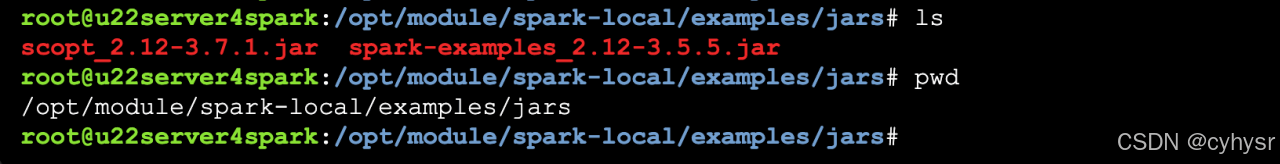

./examples/jars/spark-examples_2.12-3.5.5.jar \

10

备注:路径等信息如下,示例代码都位于spark目录中。

到此这篇关于大数据spark3.5安装部署之local模式详解的文章就介绍到这了,更多相关spark安装部署内容请搜索代码网以前的文章或继续浏览下面的相关文章希望大家以后多多支持代码网!

发表评论