第一步:安装ollama

打开官网,选择对应版本

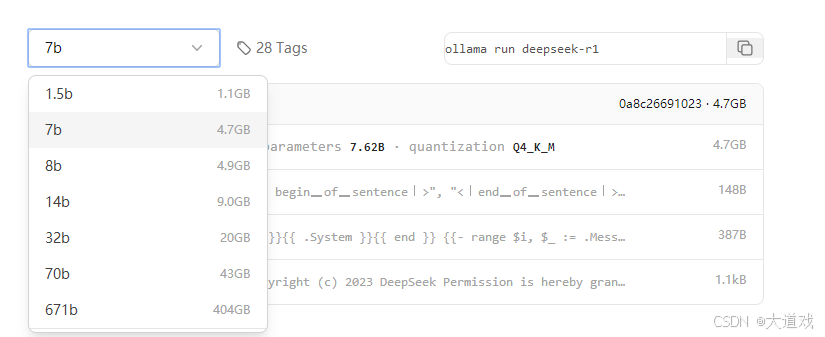

第二步:选择合适的模型

模型名称中的 1.5b、7b、8b 等数字代表模型的参数量(parameters),其中 b 是英文 billion(十亿) 的缩写。参数越多,模型通常更“聪明”(能处理更复杂的任务),但对硬件资源(显存、内存)的要求也更高。

个人用户可优先 7b(通用性最佳),若设备较弱则选 1.5b,开发者可选 8b。

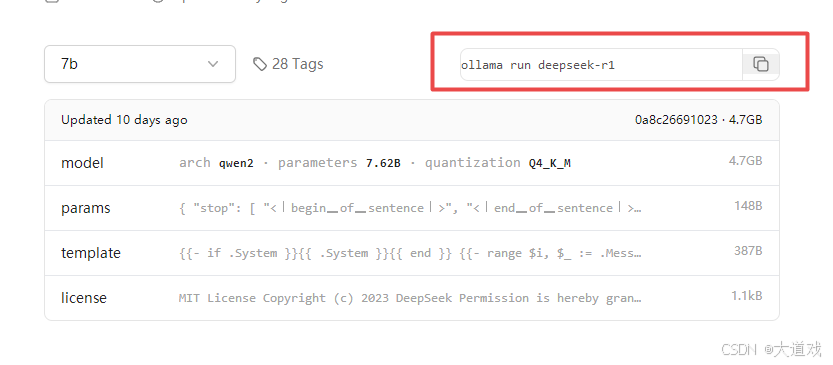

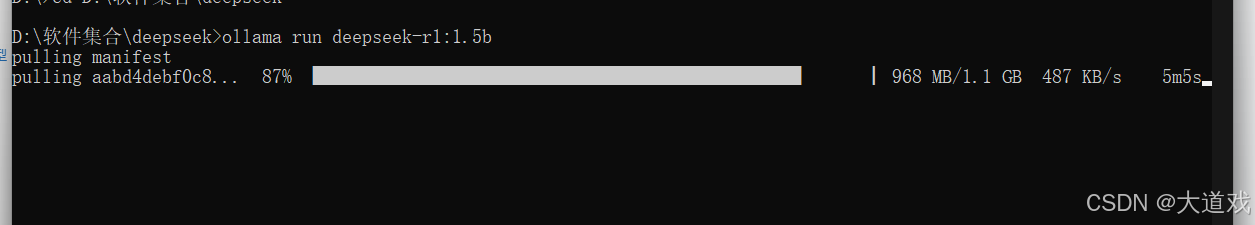

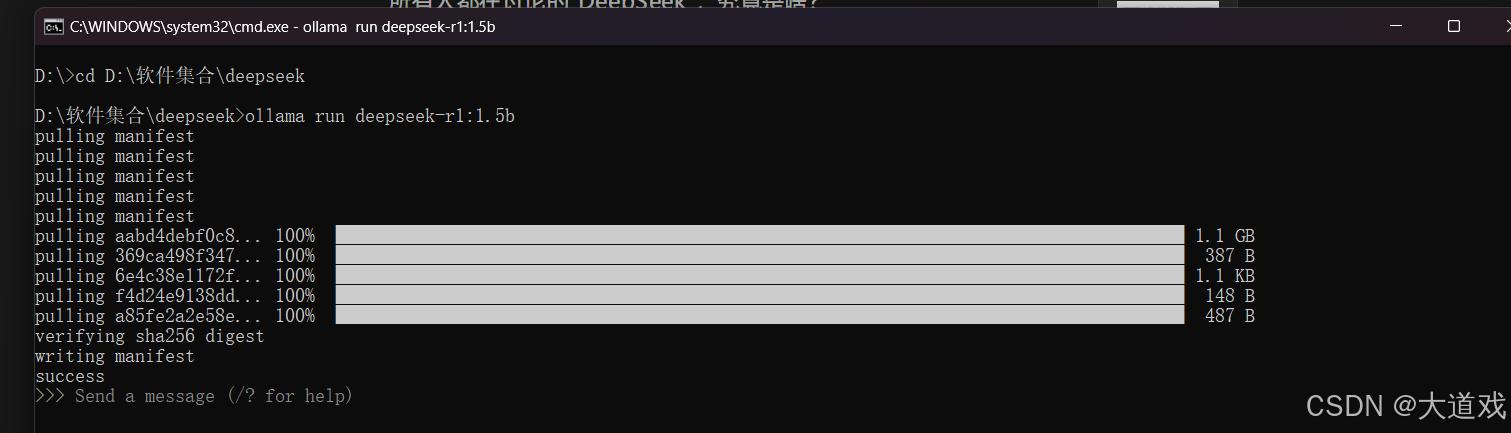

第三步:安装deepseek模型

ollama run deepseek-r1:1.5b

1、找到对应的命令,复制

2、cmd执行命令,等待安装

第四步:测试

基本命令

#退出模型 >>> /bye #查看模型 c:\users\chk>ollama list name id size modified deepseek-r1:1.5b a42b25d8c10a 1.1 gb 3 minutes ago #启动模型 ollama run deepseek-r1:1.5b >>> #查看帮助 c:\users\chk>ollama -h large language model runner usage: ollama [flags] ollama [command] available commands: serve start ollama create create a model from a modelfile show show information for a model run run a model stop stop a running model pull pull a model from a registry push push a model to a registry list list models ps list running models cp copy a model rm remove a model help help about any command flags: -h, --help help for ollama -v, --version show version information use "ollama [command] --help" for more information about a command.

到此这篇关于一文教你如何本地部署deepseek的文章就介绍到这了,更多相关本地部署deepseek内容请搜索代码网以前的文章或继续浏览下面的相关文章希望大家以后多多支持代码网!

发表评论