前言

本文将总结扩散模型ddpm的原理,首先介绍ddpm的基本流程,接着展开介绍流程里的细节,最后针对ddpm的优化函数进行推导,以让读者明白ddpm参数估计的原理。

本文不会对扩散模型的motivation进行讲解,作者有点鬼才,完全想不到他是怎么想出这种训练范式的

生成式模型的代表作为gan,然而,gan的训练十分困难,对抗训练稍有不慎便会陷入模式坍塌(model collapse)。在此背景下产生了diffusion model,其具备训练简单,生成图像多样化的特点,ddpm便是其中的代表作。

以下推导如有错误,欢迎指出

ddpm的基本流程

ddpm分为前向过程与逆向过程。

前向过程

前向过程发生在训练时:

- 从均匀分布uniform(1,2,3…,t)中采样一个样本 t t t。

- 对一张图像 x 0 x_0 x0添加 t t t次从标准正态分布 n ( 0 , i ) \mathcal n(0,\mathcal i) n(0,i)中采样到的高斯噪声( ϵ 1 \epsilon_1 ϵ1、 ϵ 2 \epsilon_2 ϵ2、…、 ϵ t \epsilon_t ϵt),得到噪声图像 x t x_t xt。

- x t x_t xt输入到u-net结构的网络,网络的输出将拟合添加到 x 0 x_0 x0中的噪声 ϵ \epsilon ϵ。

在ddpm中,神经网络扮演的角色为预测添加到图像 x 0 x_0 x0中的噪声(其实本质是预测马尔科夫状态链中 q ( x t − 1 ∣ x t ) q(x_{t-1}|x_t) q(xt−1∣xt)的均值)。当 t t t足够大时,即 t = t t=t t=t时, x t x_t xt为将服从标准正态分布。

反向过程

反向过程发生在推断时:

- 从标准正态分布 n ( 0 , i ) \mathcal n(0,\mathcal i) n(0,i)中采样一个"噪声图像" x t x_t xt。

- 将 x t x_t xt输入到u-net结构的网络中,网络输出高斯噪声 ϵ t \epsilon_t ϵt。

- 从标准正态分布 n ( 0 , i ) \mathcal n(0,\mathcal i) n(0,i)中采样得到 z z z

- 利用噪声图像 x t x_t xt 、 ϵ t \epsilon_t ϵt、 z z z,依据重参数化公式得到(采样)图像 x t − 1 x_{t-1} xt−1,重参数化公式可看下一章节中的sampling。

- 重复上述过程 t t t次,即可生成图像 x 0 x_0 x0。

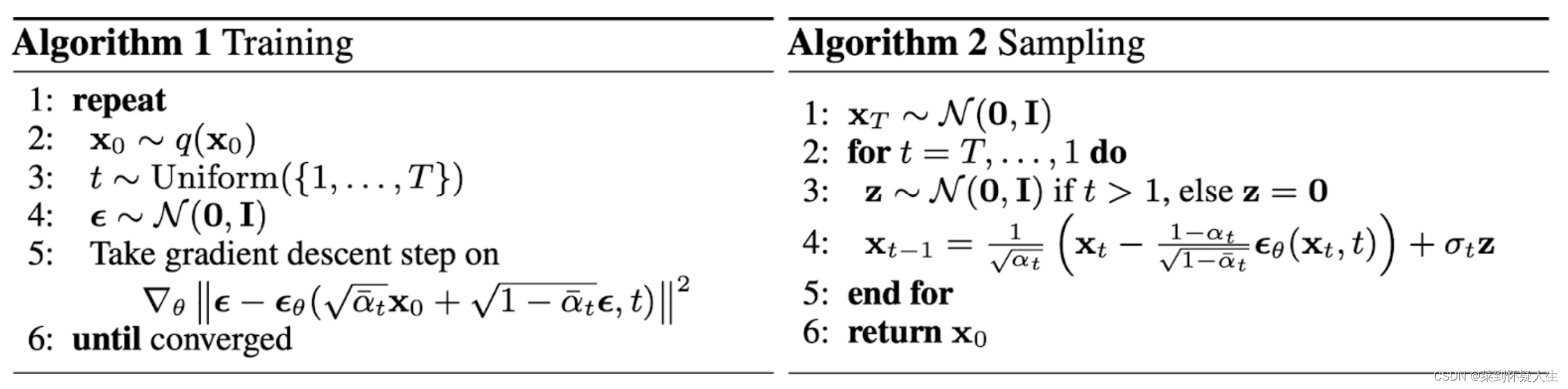

ddpm训练与测试伪代码

上图中的

ϵ

θ

\epsilon_\theta

ϵθ即神经网络。

从前向过程和反向过程可以看出ddpm的训练和推断过程都需要耗费大量的计算资源。后续的ddim有效降低了推断过程所需的计算资源,而stable diffsuion 则同时降低了训练和推断过程中所需的计算资源。后续的博客将对两者进行总结

后续内容将延续上述符号定义

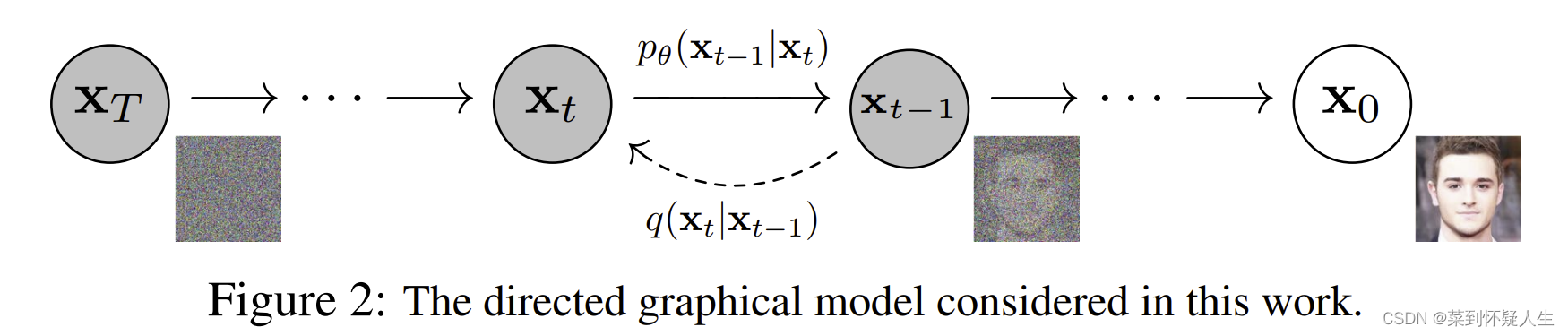

在详细介绍前向过程和反向过程前,我们需要知道ddpm将图像生成看成一种马尔科夫链,即

x

t

x_t

xt的生成仅依赖于

x

t

−

1

x_{t-1}

xt−1或

x

t

+

1

x_{t+1}

xt+1,则前向过程(虚线)和反向过(实线)程可以表示为下图

前向过程详解

依据马尔科夫链的特性,在前向过程中,定义

x

t

x_t

xt可从

x

t

−

1

x_{t-1}

xt−1中按下式得到:

x

t

=

1

−

β

t

x

t

−

1

+

β

t

ϵ

t

(1.0)

x_t=\sqrt{1-\beta_t} x_{t-1}+\sqrt{\beta_t} \epsilon_{t}\tag{1.0}

xt=1−βtxt−1+βtϵt(1.0)

β

t

\beta_t

βt是一个人为设定的常数,取值为(0,1)。其满足以下特性

β

1

<

β

2

<

.

.

.

<

β

t

\beta_1<\beta_2<...<\beta_t

β1<β2<...<βt

从式1.0可知 x t x_t xt的生成仅仅依赖 x t − 1 x_{t-1} xt−1,与 x 0 x_0 x0无关,因此有 x t ∼ q ( x t ∣ x t − 1 ) = n ( x t ; 1 − β t x t − 1 , β t i ) (1.1) x_t\sim q(x_t|x_{t-1})=\mathcal n(x_t;\sqrt{1-\beta_t} x_{t-1},\beta_t \mathcal i)\tag{1.1} xt∼q(xt∣xt−1)=n(xt;1−βtxt−1,βti)(1.1)

利用重参数化的技巧,从式1.0中的形式可以得出式1.1。

前向过程需要对式1.0重复t次,非常耗时,能否仅采样一次,就得到状态t时刻的样本呢?

为了实现上述想法,我们需要得到分布 q ( x t ∣ x 0 ) q(x_t|x_0) q(xt∣x0)的具体形式,

为了后续推导出的式子更加简洁,设

α

t

=

1

−

β

t

α

ˉ

t

=

α

t

α

t

−

1

.

.

.

α

0

\begin{aligned} \alpha_t&=1-\beta_t\\ \bar \alpha_t & = \alpha_t\alpha_{t-1}...\alpha_0 \end{aligned}

αtαˉt=1−βt=αtαt−1...α0对式1.0进行展开可得

x

t

=

1

−

β

t

x

t

−

1

+

β

t

ϵ

t

=

1

−

β

t

(

1

−

β

t

−

1

x

t

−

2

+

β

t

−

1

ϵ

t

−

1

)

+

β

t

ϵ

t

=

α

t

(

α

t

−

1

x

t

−

2

+

1

−

α

t

−

1

ϵ

t

−

1

)

+

1

−

α

t

ϵ

t

=

α

t

α

t

−

1

x

t

−

2

+

α

t

(

1

−

α

t

−

1

)

ϵ

t

−

1

+

1

−

α

t

ϵ

t

=

α

t

α

t

−

1

x

t

−

2

+

1

−

α

t

α

t

−

1

ϵ

t

=

α

ˉ

t

x

0

+

1

−

α

ˉ

t

ϵ

t

(1.2)

\begin{aligned} x_t&=\sqrt{1-\beta_t} x_{t-1}+\sqrt{\beta_t} \epsilon_{t}\\ &=\sqrt{1-\beta_t} (\sqrt{1-\beta_{t-1}}x_{t-2}+\sqrt{\beta_{t-1}}\epsilon_{t-1})+\sqrt{\beta_t} \epsilon_{t}\\ &=\sqrt{\alpha_t}(\sqrt{\alpha_{t-1}}x_{t-2}+\sqrt{1-\alpha_{t-1}}\epsilon_{t-1})+\sqrt{1-\alpha_t}\epsilon_t\\ &=\sqrt{\alpha_t\alpha_{t-1}}x_{t-2}+\sqrt{\alpha_t(1-\alpha_{t-1})}\epsilon_{t-1}+\sqrt{1-\alpha_t}\epsilon_t\\ &=\sqrt{\alpha_t\alpha_{t-1}}x_{t-2}+\sqrt{1-\alpha_t\alpha_{t-1}}\epsilon_{t}\\ &=\sqrt{\bar \alpha_t}x_0+\sqrt{1-\bar\alpha_t}\epsilon_t\tag{1.2} \end{aligned}

xt=1−βtxt−1+βtϵt=1−βt(1−βt−1xt−2+βt−1ϵt−1)+βtϵt=αt(αt−1xt−2+1−αt−1ϵt−1)+1−αtϵt=αtαt−1xt−2+αt(1−αt−1)ϵt−1+1−αtϵt=αtαt−1xt−2+1−αtαt−1ϵt=αˉtx0+1−αˉtϵt(1.2)

上述等式的倒数第二行推导逻辑如下,已知

ϵ

t

\epsilon_{t}

ϵt、

ϵ

t

−

1

\epsilon_{t-1}

ϵt−1服从标准正态分布,依据重参数化可知:

α

t

(

1

−

α

t

−

1

)

ϵ

t

−

1

∼

n

(

0

,

α

t

(

1

−

α

t

−

1

)

)

1

−

α

t

ϵ

t

∼

n

(

0

,

1

−

α

t

)

\begin{aligned} \sqrt{\alpha_t(1-\alpha_{t-1})}\epsilon_{t-1}&\sim \mathcal n(0,\alpha_t(1-\alpha_{t-1}))\\ \sqrt{1-\alpha_{t}}\epsilon_{t}&\sim \mathcal n(0,1-\alpha_{t}) \end{aligned}

αt(1−αt−1)ϵt−11−αtϵt∼n(0,αt(1−αt−1))∼n(0,1−αt)

两个均值为0的高斯分布相加具备以下性质

则有

α

t

(

1

−

α

t

−

1

)

ϵ

t

−

1

+

1

−

α

t

ϵ

t

∼

n

(

0

,

1

−

α

t

)

+

n

(

0

,

α

t

(

1

−

α

t

−

1

)

)

=

n

(

0

,

1

−

α

t

α

t

−

1

)

\sqrt{\alpha_t(1-\alpha_{t-1})}\epsilon_{t-1}+\sqrt{1-\alpha_t}\epsilon_t \sim \mathcal n(0,1-\alpha_{t})+ \mathcal n(0,\alpha_t(1-\alpha_{t-1}))=\mathcal n(0,1-\alpha_{t}\alpha_{t-1})

αt(1−αt−1)ϵt−1+1−αtϵt∼n(0,1−αt)+n(0,αt(1−αt−1))=n(0,1−αtαt−1)

因此我们可以利用分布

n

(

0

,

1

−

α

t

α

t

−

1

)

\mathcal n(0,1-\alpha_{t}\alpha_{t-1})

n(0,1−αtαt−1)中的随机变量来替代

α

t

(

1

−

α

t

−

1

)

ϵ

t

−

1

+

1

−

α

t

ϵ

t

\sqrt{\alpha_t(1-\alpha_{t-1})}\epsilon_{t-1}+\sqrt{1-\alpha_t}\epsilon_t

αt(1−αt−1)ϵt−1+1−αtϵt,利用重参数化技巧推出式1.3

q

(

x

t

∣

x

0

)

=

n

(

x

t

;

α

ˉ

t

x

0

,

(

1

−

α

ˉ

t

)

i

)

(1.3)

q(x_t|x_0)=\mathcal n(x_t;\sqrt{\bar \alpha_t}x_0,(1-\bar\alpha_t)\mathcal i)\tag{1.3}

q(xt∣x0)=n(xt;αˉtx0,(1−αˉt)i)(1.3)

利用式1.2,我们可以仅通过一次采样就能获得状态 t t t时刻的样本。

反向过程详解

依据马尔科夫链的性质,我们需要得到分布

q

(

x

t

−

1

∣

x

t

)

q(x_{t-1}|x_t)

q(xt−1∣xt)的具体形式,进而通过重参数化技巧进行采样。对其展开可得

q

(

x

t

−

1

∣

x

t

)

=

q

(

x

t

−

1

x

t

)

q

(

x

t

)

=

q

(

x

t

∣

x

t

−

1

)

q

(

x

t

−

1

)

q

(

x

t

)

\begin{aligned} q(x_{t-1}|x_{t})&=\frac{q(x_{t-1}x_t)}{q(x_t)}\\ &=\frac{q(x_t|x_{t-1})q(x_{t-1})}{q(x_t)} \end{aligned}

q(xt−1∣xt)=q(xt)q(xt−1xt)=q(xt)q(xt∣xt−1)q(xt−1)

我们无法知晓

q

(

x

t

−

1

)

q(x_{t-1})

q(xt−1)、

q

(

x

t

)

q(x_t)

q(xt)的具体分布形式,因此

q

(

x

t

−

1

∣

x

x

t

)

q(x_{t-1}|x_{x_t})

q(xt−1∣xxt)是intractable的。作者在此用了一个trick,在反向过程的马尔可夫链中,随机变量

x

t

−

1

x_{t-1}

xt−1仅仅依赖于

x

t

x_t

xt,不依赖于

x

0

x_0

x0,利用这个特性,我们有

q

(

x

t

−

1

∣

x

t

)

=

q

(

x

t

−

1

∣

x

t

,

x

0

)

=

q

(

x

t

−

1

,

x

t

,

x

0

)

q

(

x

t

,

x

0

)

=

q

(

x

t

∣

x

t

−

1

,

x

0

)

q

(

x

t

−

1

,

x

0

)

q

(

x

t

∣

x

0

)

q

(

x

0

)

=

q

(

x

t

∣

x

t

−

1

,

x

0

)

q

(

x

t

−

1

∣

x

0

)

q

(

x

0

)

q

(

x

t

∣

x

0

)

q

(

x

0

)

=

q

(

x

t

∣

x

t

−

1

,

x

0

)

q

(

x

t

−

1

∣

x

0

)

q

(

x

t

∣

x

0

)

=

q

(

x

t

∣

x

t

−

1

)

q

(

x

t

−

1

∣

x

0

)

q

(

x

t

∣

x

0

)

(2.0)

\begin{aligned} q(x_{t-1}|x_{t})&=q(x_{t-1}|x_{t},x_0)\\ &=\frac{q(x_{t-1},x_t,x_0)}{q(x_t,x_0)}\\ &=\frac{q(x_{t}|x_{t-1},x_0)q(x_{t-1},x_0)}{q(x_t|x_0)q(x_0)}\\ &=\frac{q(x_{t}|x_{t-1},x_0)q(x_{t-1}|x_0)q(x_0)}{q(x_t|x_0)q(x_0)}\\ &=\frac{q(x_{t}|x_{t-1},x_0)q(x_{t-1}|x_0)}{q(x_t|x_0)}\\ &=\frac{q(x_{t}|x_{t-1})q(x_{t-1}|x_0)}{q(x_t|x_0)}\tag{2.0} \end{aligned}

q(xt−1∣xt)=q(xt−1∣xt,x0)=q(xt,x0)q(xt−1,xt,x0)=q(xt∣x0)q(x0)q(xt∣xt−1,x0)q(xt−1,x0)=q(xt∣x0)q(x0)q(xt∣xt−1,x0)q(xt−1∣x0)q(x0)=q(xt∣x0)q(xt∣xt−1,x0)q(xt−1∣x0)=q(xt∣x0)q(xt∣xt−1)q(xt−1∣x0)(2.0)

结合式1.1、1.3,利用高斯分布的具体表达式,对式2.0(忽略高斯分布的系数)进行进一步推导有

q ( x t − 1 ∣ x t ) = exp ( − 1 2 ( ( x t − α t x t − 1 ) 2 β t + ( x t − 1 − α ˉ t − 1 x 0 ) 2 1 − α ˉ t − 1 − ( x t − α ˉ t x 0 ) 2 1 − α ˉ t ) ) = exp ( − 1 2 ( x t 2 − 2 α t x t x t − 1 + α t x t − 1 2 β t + x t − 1 2 − 2 α ˉ t − 1 x 0 x t − 1 + α ˉ t − 1 x 0 2 1 − α ˉ t − 1 − ( x t − α ˉ t x 0 ) 2 1 − α ˉ t ) ) = exp ( − 1 2 ( ( α t β t + 1 1 − α t − 1 ) x t − 1 2 − ( 2 α t β t x t + 2 α ˉ t − 1 1 − α ˉ t − 1 x 0 ) x t − 1 + c ( x t , x 0 ) ) ) (2.1) \begin{aligned} q(x_{t-1}|x_t)&=\exp(-\frac{1}{2}(\frac{(x_t-\sqrt{\alpha_t}x_{t-1})^2}{\beta_t}+\frac{(x_{t-1}-\sqrt{\bar\alpha_{t-1}}x_0)^2}{1-\bar\alpha_{t-1}}-\frac{(x_t-\sqrt{\bar\alpha_t}x_0)^2}{1-\bar \alpha_t}))\\ &=\exp(-\frac{1}{2}(\frac{x_t^2-2\sqrt{\alpha_t}x_tx_{t-1}+\alpha_tx_{t-1}^2}{\beta_t}+\frac{x_{t-1}^2-2\sqrt{\bar\alpha_{t-1}}x_0x_{t-1}+\bar\alpha_{t-1}x_0^2}{1-\bar\alpha_{t-1}}-\frac{(x_t-\sqrt{\bar\alpha_t}x_0)^2}{1-\bar \alpha_t}))\\ &=\exp(-\frac{1}{2}((\frac{\alpha_t}{\beta_t}+\frac{1}{1-\alpha_{t-1}})x_{t-1}^2-(\frac{2\sqrt{\alpha_t}}{\beta_t}x_t+\frac{2\sqrt{\bar\alpha_{t-1}}}{1-\bar\alpha_{t-1}}x_0)x_{t-1}+c(x_t,x_0)))\tag{2.1} \end{aligned} q(xt−1∣xt)=exp(−21(βt(xt−αtxt−1)2+1−αˉt−1(xt−1−αˉt−1x0)2−1−αˉt(xt−αˉtx0)2))=exp(−21(βtxt2−2αtxtxt−1+αtxt−12+1−αˉt−1xt−12−2αˉt−1x0xt−1+αˉt−1x02−1−αˉt(xt−αˉtx0)2))=exp(−21((βtαt+1−αt−11)xt−12−(βt2αtxt+1−αˉt−12αˉt−1x0)xt−1+c(xt,x0)))(2.1)

等式的最后一列就是合并同类项,不包含 x t − 1 x_{t-1} xt−1的项都合并到了 c ( x t , x 0 ) c(x_t,x_0) c(xt,x0)中,我们对高斯分布的展开形式做个回顾:

依据上述展开,以及

α

ˉ

t

=

α

t

α

t

−

1

.

.

.

α

0

\bar \alpha_t = \alpha_t\alpha_{t-1}...\alpha_0

αˉt=αtαt−1...α0、

α

t

=

1

−

β

t

\alpha_t=1-\beta_t

αt=1−βt,

x

t

=

α

ˉ

t

x

0

+

1

−

α

ˉ

t

ϵ

t

x_t=\sqrt{\bar \alpha_t}x_0+\sqrt{1-\bar\alpha_t}\epsilon_t

xt=αˉtx0+1−αˉtϵt,我们对式2.1进行补齐缺失项后可得

q

(

x

t

−

1

∣

x

t

)

q(x_{t-1}|x_t)

q(xt−1∣xt)的均值

μ

t

\mu_t

μt和方差

δ

t

2

\delta_t^2

δt2为

δ

t

2

=

1

α

t

β

t

+

1

1

−

α

t

−

1

=

1

α

t

−

α

ˉ

t

+

β

t

β

t

(

1

−

α

ˉ

t

−

1

)

=

1

−

α

ˉ

t

−

1

1

−

α

ˉ

t

β

t

μ

t

=

(

2

α

t

β

t

x

t

+

2

α

ˉ

t

−

1

1

−

α

ˉ

t

−

1

x

0

)

/

(

α

t

β

t

+

1

1

−

α

t

−

1

)

=

(

2

α

t

β

t

x

t

+

2

α

ˉ

t

−

1

1

−

α

ˉ

t

−

1

x

0

)

1

−

α

ˉ

t

−

1

1

−

α

ˉ

t

β

t

=

α

t

(

1

−

α

ˉ

t

−

1

)

1

−

α

ˉ

t

x

t

+

α

ˉ

t

−

1

β

t

1

−

α

ˉ

t

x

0

=

α

t

(

1

−

α

ˉ

t

−

1

)

1

−

α

ˉ

t

x

t

+

α

ˉ

t

−

1

β

t

1

−

α

ˉ

t

(

x

t

−

1

−

α

ˉ

t

ϵ

t

α

ˉ

t

)

=

1

α

t

(

x

t

−

1

−

α

t

1

−

α

ˉ

t

ϵ

t

)

(2.2)

\begin{aligned} \delta_t^2&=\frac{1}{\frac{\alpha_t}{\beta_t}+\frac{1}{1-\alpha_{t-1}}}=\frac{1}{\frac{\alpha_t-\bar\alpha_t+\beta_t}{\beta_t(1-\bar\alpha_{t-1})}}=\frac{1-\bar\alpha_{t-1}}{1-\bar\alpha_t}\beta_t\\ \mu_t&=(\frac{2\sqrt{\alpha_t}}{\beta_t}x_t+\frac{2\sqrt{\bar\alpha_{t-1}}}{1-\bar\alpha_{t-1}}x_0)/(\frac{\alpha_t}{\beta_t}+\frac{1}{1-\alpha_{t-1}})\\ &=(\frac{2\sqrt{\alpha_t}}{\beta_t}x_t+\frac{2\sqrt{\bar\alpha_{t-1}}}{1-\bar\alpha_{t-1}}x_0)\frac{1-\bar\alpha_{t-1}}{1-\bar\alpha_t}\beta_t\\ &=\frac{\sqrt{\alpha_t}(1-\bar\alpha_{t-1})}{1-\bar\alpha_t}x_t+\frac{\sqrt{\bar\alpha_{t-1}}\beta_t}{1-\bar\alpha_t}x_0\\ &=\frac{\sqrt{\alpha_t}(1-\bar\alpha_{t-1})}{1-\bar\alpha_t}x_t+\frac{\sqrt{\bar\alpha_{t-1}}\beta_t}{1-\bar\alpha_t}(\frac{x_t-\sqrt{1-\bar\alpha_t}\epsilon_t}{\sqrt{\bar\alpha_t}})\\ &=\frac{1}{\sqrt{\alpha_t}}(x_t-\frac{1-\alpha_t}{\sqrt{1-\bar\alpha_t}}\epsilon_t) \end{aligned}\tag{2.2}

δt2μt=βtαt+1−αt−111=βt(1−αˉt−1)αt−αˉt+βt1=1−αˉt1−αˉt−1βt=(βt2αtxt+1−αˉt−12αˉt−1x0)/(βtαt+1−αt−11)=(βt2αtxt+1−αˉt−12αˉt−1x0)1−αˉt1−αˉt−1βt=1−αˉtαt(1−αˉt−1)xt+1−αˉtαˉt−1βtx0=1−αˉtαt(1−αˉt−1)xt+1−αˉtαˉt−1βt(αˉtxt−1−αˉtϵt)=αt1(xt−1−αˉt1−αtϵt)(2.2)

上式中的

ϵ

t

\epsilon_t

ϵt可以由神经网络预测得到(可回顾“ddpm基本流程章节”)。依据式2.2,利用重参数化从样本

x

t

x_t

xt得到样本

x

t

−

1

x_{t-1}

xt−1的流程为

- 从 n ( 0 , i ) \mathcal n(0,\mathcal i) n(0,i)采样得到 z z z

- 将 x t x_t xt输入到网络中,由网络预测 ϵ t \epsilon_t ϵt

- x t − 1 x_{t-1} xt−1= 1 α t ( x t − 1 − α t 1 − α ˉ t ϵ t ) + δ t z \frac{1}{\sqrt{\alpha_t}}(x_t-\frac{1-\alpha_t}{\sqrt{1-\bar\alpha_t}}\epsilon_t)+\delta_tz αt1(xt−1−αˉt1−αtϵt)+δtz

ddpm损失函数推导

至此,我们已经对前向过程与反向过程进行了详细的介绍,也知晓神经网络在ddpm中扮演的角色为预测最后一次添加到图像中的噪声,自然也能推断出ddpm的损失函数类似于mse。在本章节中,博主将推导ddpm的损失函数。

深度学习领域的许多模型都通过极大化对数似然来进行参数估计,设网络为 p θ ( x 0 ) p_\theta(x_0) pθ(x0),则对数似然为 log p θ ( x 0 ) \log p_\theta(x_0) logpθ(x0),最大化对数似然等价于最小化 − log p θ ( x 0 ) -\log p_\theta(x_0) −logpθ(x0),ddpm通过优化其上界进行参数估计。已知kl散度取值大于等于0,则其上界为( q ( x 1 : t ∣ x 0 ) q(x_{1:t}|x_0) q(x1:t∣x0)表示真实的数据分布)

−

log

p

θ

(

x

0

)

≤

−

log

p

θ

(

x

0

)

+

d

k

l

(

q

(

x

1

:

t

∣

x

0

)

∣

∣

p

θ

(

x

1

:

t

∣

x

0

)

)

=

−

log

p

θ

(

x

0

)

+

e

q

(

x

1

:

t

∣

x

0

)

[

log

q

(

x

1

:

t

∣

x

0

)

p

θ

(

x

0

:

t

)

/

p

θ

(

x

0

)

]

=

−

log

p

θ

(

x

0

)

+

e

q

(

x

1

:

t

∣

x

0

)

[

log

q

(

x

1

:

t

∣

x

0

)

p

θ

(

x

0

:

t

)

+

log

p

θ

(

x

0

)

]

=

−

log

p

θ

(

x

0

)

+

e

q

(

x

1

:

t

∣

x

0

)

[

log

q

(

x

1

:

t

∣

x

0

)

p

θ

(

x

0

:

t

)

]

+

e

q

(

x

1

:

t

∣

x

0

)

[

log

p

θ

(

x

0

)

]

=

−

log

p

θ

(

x

0

)

+

e

q

(

x

1

:

t

∣

x

0

)

[

log

q

(

x

1

:

t

∣

x

0

)

p

θ

(

x

0

:

t

)

]

+

log

p

θ

(

x

0

)

=

e

q

(

x

1

:

t

∣

x

0

)

[

log

q

(

x

1

:

t

∣

x

0

)

p

θ

(

x

0

:

t

)

]

\begin{aligned} -\log p_\theta(x_0) &\leq -\log p_\theta(x_0)+d_{kl}(q(x_{1:t}|x_0)||p_{\theta}(x_{1:t}|x_0))\\ &=-\log p_\theta(x_0)+e_{q(x_{1:t}|x_0)}[\log\frac{q(x_{1:t}|x_0)}{p_{\theta}(x_{0:t})/p_{\theta}(x_0)}]\\ &=-\log p_\theta(x_0)+e_{q(x_{1:t}|x_0)}[\log\frac{q(x_{1:t}|x_0)}{p_\theta(x_{0:t})}+\log p_{\theta}(x_0)]\\ &=-\log p_\theta(x_0)+e_{q(x_{1:t}|x_0)}[\log\frac{q(x_{1:t}|x_0)}{p_\theta(x_{0:t})}]+e_{q(x_{1:t}|x_0)}[\log p_{\theta}(x_0)]\\ &=-\log p_\theta(x_0)+e_{q(x_{1:t}|x_0)}[\log\frac{q(x_{1:t}|x_0)}{p_\theta(x_{0:t})}]+\log p_{\theta}(x_0)\\ &=e_{q(x_{1:t}|x_0)}[\log\frac{q(x_{1:t}|x_0)}{p_\theta(x_{0:t})}] \end{aligned}

−logpθ(x0)≤−logpθ(x0)+dkl(q(x1:t∣x0)∣∣pθ(x1:t∣x0))=−logpθ(x0)+eq(x1:t∣x0)[logpθ(x0:t)/pθ(x0)q(x1:t∣x0)]=−logpθ(x0)+eq(x1:t∣x0)[logpθ(x0:t)q(x1:t∣x0)+logpθ(x0)]=−logpθ(x0)+eq(x1:t∣x0)[logpθ(x0:t)q(x1:t∣x0)]+eq(x1:t∣x0)[logpθ(x0)]=−logpθ(x0)+eq(x1:t∣x0)[logpθ(x0:t)q(x1:t∣x0)]+logpθ(x0)=eq(x1:t∣x0)[logpθ(x0:t)q(x1:t∣x0)]

对其展开则有

l

=

e

q

(

x

1

:

t

∣

x

0

)

[

log

q

(

x

1

:

t

∣

x

0

)

p

θ

(

x

0

:

t

)

]

=

e

q

[

∏

t

=

1

t

q

(

x

t

∣

x

t

−

1

)

p

θ

(

x

t

)

∏

t

=

1

t

p

θ

(

x

t

−

1

∣

x

t

)

]

=

e

q

[

−

log

p

θ

(

x

t

)

+

∑

t

=

1

t

log

q

(

x

t

∣

x

t

−

1

)

p

θ

(

x

t

−

1

∣

x

t

)

]

=

e

q

[

−

log

p

θ

(

x

t

)

+

∑

t

=

2

t

log

q

(

x

t

∣

x

t

−

1

)

p

θ

(

x

t

−

1

∣

x

t

)

+

log

q

(

x

1

∣

x

0

)

p

θ

(

x

0

∣

x

1

)

]

=

e

q

[

−

log

p

θ

(

x

t

)

+

∑

t

=

2

t

log

(

q

(

x

t

∣

x

t

−

1

,

x

0

)

p

θ

(

x

t

−

1

∣

x

t

)

.

q

(

x

t

∣

x

0

)

q

(

x

t

−

1

∣

x

0

)

)

+

log

q

(

x

1

∣

x

0

)

p

θ

(

x

0

∣

x

1

)

]

=

e

q

[

−

log

p

θ

(

x

t

)

+

∑

t

=

2

t

log

q

(

x

t

∣

x

t

−

1

,

x

0

)

p

θ

(

x

t

−

1

∣

x

t

)

+

∑

t

=

2

t

log

q

(

x

t

∣

x

0

)

q

(

x

t

−

1

∣

x

0

)

+

log

q

(

x

1

∣

x

0

)

p

θ

(

x

0

∣

x

1

)

]

=

e

q

[

−

log

p

θ

(

x

t

)

+

∑

t

=

2

t

log

q

(

x

t

∣

x

t

−

1

,

x

0

)

p

θ

(

x

t

−

1

∣

x

t

)

+

log

q

(

x

t

∣

x

0

)

q

(

x

1

∣

x

0

)

+

log

q

(

x

1

∣

x

0

)

p

θ

(

x

0

∣

x

1

)

]

=

e

q

[

−

log

p

θ

(

x

t

)

+

∑

t

=

2

t

log

q

(

x

t

∣

x

t

−

1

,

x

0

)

p

θ

(

x

t

−

1

∣

x

t

)

+

log

q

(

x

t

∣

x

0

)

p

θ

(

x

0

∣

x

1

)

)

]

=

e

q

[

log

q

(

x

t

∣

x

0

)

p

θ

(

x

t

)

+

∑

t

=

2

t

log

q

(

x

t

∣

x

t

−

1

,

x

0

)

p

θ

(

x

t

−

1

∣

x

t

)

−

log

p

θ

(

x

0

∣

x

1

)

)

]

=

e

q

[

d

k

l

(

q

(

x

t

∣

x

0

)

∣

∣

p

θ

(

x

t

)

)

q

(

x

t

∣

x

0

)

+

∑

t

=

2

t

d

k

l

(

q

(

x

t

−

1

∣

x

t

,

x

0

)

∣

∣

p

θ

(

x

t

−

1

∣

x

t

)

)

q

(

x

t

−

1

∣

x

t

,

x

0

)

−

log

p

θ

(

x

0

∣

x

1

)

)

]

\begin{aligned} l&=e_{q(x_{1:t}|x_0)}[\log\frac{q(x_{1:t}|x_0)}{p_\theta(x_{0:t})}]\\ &=e_q[\frac{\prod_{t=1}^tq(x_t|x_{t-1})}{p_{\theta}(x_t)\prod_{t=1}^tp_\theta(x_{t-1}|x_t)}]\\ &=e_q[-\log p_\theta(x_t)+\sum_{t=1}^t\log\frac{q(x_t|x_{t-1})}{p_\theta(x_{t-1}|x_t)}]\\ &=e_q[-\log p_\theta(x_t)+\sum_{t=2}^t\log\frac{q(x_t|x_{t-1})}{p_\theta(x_{t-1}|x_t)}+\log\frac{q(x_1|x_0)}{p_\theta(x_0|x_1)}]\\ &=e_q[-\log p_\theta(x_t)+\sum_{t=2}^t\log(\frac{q(x_t|x_{t-1},x_0)}{p_\theta(x_{t-1}|x_t)}.\frac{q(x_t|x_0)}{q(x_{t-1}|x_0)})+\log\frac{q(x_1|x_0)}{p_\theta(x_0|x_1)}]\\ &=e_q[-\log p_\theta(x_t)+\sum_{t=2}^t\log\frac{q(x_t|x_{t-1},x_0)}{p_\theta(x_{t-1}|x_t)}+\sum_{t=2}^t\log\frac{q(x_t|x_0)}{q(x_{t-1}|x_0)}+\log\frac{q(x_1|x_0)}{p_\theta(x_0|x_1)}]\\ &=e_q[-\log p_\theta(x_t)+\sum_{t=2}^t\log\frac{q(x_t|x_{t-1},x_0)}{p_\theta(x_{t-1}|x_t)}+\log\frac{q(x_t|x_0)}{q(x_{1}|x_0)}+\log\frac{q(x_1|x_0)}{p_\theta(x_0|x_1)}]\\ &=e_q[-\log p_\theta(x_t)+\sum_{t=2}^t\log\frac{q(x_t|x_{t-1},x_0)}{p_\theta(x_{t-1}|x_t)}+\log\frac{q(x_t|x_0)}{p_\theta(x_0|x_1))}]\\ &=e_q[\log \frac{q(x_t|x_0)}{p_\theta(x_t)}+\sum_{t=2}^t\log\frac{q(x_t|x_{t-1},x_0)}{p_\theta(x_{t-1}|x_t)}-\log{p_\theta(x_0|x_1))}]\\ &=e_q[\frac{d_{kl}(q(x_t|x_0)||p_\theta(x_t))}{q(x_t|x_0)}+\sum_{t=2}^t\frac{d_{kl}(q(x_{t-1}|x_t,x_0)||p_\theta(x_{t-1}|x_t))}{q(x_{t-1}|x_t,x_0)}-\log{p_\theta(x_0|x_1))}] \end{aligned}

l=eq(x1:t∣x0)[logpθ(x0:t)q(x1:t∣x0)]=eq[pθ(xt)∏t=1tpθ(xt−1∣xt)∏t=1tq(xt∣xt−1)]=eq[−logpθ(xt)+t=1∑tlogpθ(xt−1∣xt)q(xt∣xt−1)]=eq[−logpθ(xt)+t=2∑tlogpθ(xt−1∣xt)q(xt∣xt−1)+logpθ(x0∣x1)q(x1∣x0)]=eq[−logpθ(xt)+t=2∑tlog(pθ(xt−1∣xt)q(xt∣xt−1,x0).q(xt−1∣x0)q(xt∣x0))+logpθ(x0∣x1)q(x1∣x0)]=eq[−logpθ(xt)+t=2∑tlogpθ(xt−1∣xt)q(xt∣xt−1,x0)+t=2∑tlogq(xt−1∣x0)q(xt∣x0)+logpθ(x0∣x1)q(x1∣x0)]=eq[−logpθ(xt)+t=2∑tlogpθ(xt−1∣xt)q(xt∣xt−1,x0)+logq(x1∣x0)q(xt∣x0)+logpθ(x0∣x1)q(x1∣x0)]=eq[−logpθ(xt)+t=2∑tlogpθ(xt−1∣xt)q(xt∣xt−1,x0)+logpθ(x0∣x1))q(xt∣x0)]=eq[logpθ(xt)q(xt∣x0)+t=2∑tlogpθ(xt−1∣xt)q(xt∣xt−1,x0)−logpθ(x0∣x1))]=eq[q(xt∣x0)dkl(q(xt∣x0)∣∣pθ(xt))+t=2∑tq(xt−1∣xt,x0)dkl(q(xt−1∣xt,x0)∣∣pθ(xt−1∣xt))−logpθ(x0∣x1))]

因此需要优化的项有三个

l

0

=

d

k

l

(

q

(

x

t

∣

x

0

)

∣

∣

p

θ

(

x

t

)

)

l

1

=

∑

t

=

2

t

d

k

l

(

q

(

x

t

−

1

∣

x

t

,

x

0

)

∣

∣

p

θ

(

x

t

−

1

∣

x

t

)

)

l

2

=

log

p

θ

(

x

0

∣

x

1

)

\begin{aligned} l_0&=d_{kl}(q(x_t|x_0)||p_\theta(x_t))\\ l_1&=\sum_{t=2}^td_{kl}(q(x_{t-1}|x_t,x_0)||p_\theta(x_{t-1}|x_t))\\ l_2&=\log{p_\theta(x_0|x_1)} \end{aligned}

l0l1l2=dkl(q(xt∣x0)∣∣pθ(xt))=t=2∑tdkl(q(xt−1∣xt,x0)∣∣pθ(xt−1∣xt))=logpθ(x0∣x1)

对于 l 0 l_0 l0项,经过 t t t次( t t t一般很大)加噪后, q ( x t ∣ x 0 ) q(x_t|x_0) q(xt∣x0)与 p θ ( x t ) p_\theta(x_t) pθ(xt)基本等价于标准正态分布,因此 l 0 l_0 l0项取值接近于0。

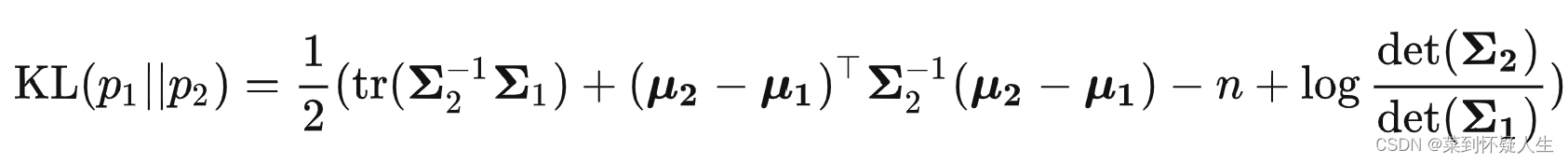

对于

l

2

l_2

l2,感兴趣的可以浏览原文的3.3章节(具体实现见链接),最终作者发现优化

l

1

l_1

l1项,模型的效果最佳,因此本章节只对

l

1

l_1

l1进行推导。已知高斯分布

n

(

x

;

μ

1

,

∑

1

)

\mathcal n(x;\mu_1,\sum_1)

n(x;μ1,∑1)、

n

(

x

;

μ

2

,

∑

2

)

\mathcal n(x;\mu_2,\sum_2)

n(x;μ2,∑2)的kl散度公式为(具体推导可浏览生成模型vae):

假设

p

θ

(

x

t

−

1

∣

x

t

)

p_\theta(x_{t-1}|x_t)

pθ(xt−1∣xt)服从

n

(

x

;

μ

θ

,

δ

t

i

)

\mathcal n(x;\mu_\theta,\delta_ti)

n(x;μθ,δti),已知

q

(

x

t

−

1

∣

x

t

,

x

0

)

q(x_{t-1}|x_t,x_0)

q(xt−1∣xt,x0)服从

n

(

x

;

μ

t

,

δ

t

i

)

\mathcal n(x;\mu_t,\delta_ti)

n(x;μt,δti)(均值和方差的式子见式2.2),则有

l

2

=

∑

t

=

2

t

d

k

l

(

q

(

x

t

−

1

∣

x

t

,

x

0

)

∣

∣

p

θ

(

x

t

−

1

∣

x

t

)

)

=

∑

t

=

2

t

(

1

2

(

n

+

1

δ

t

2

∣

∣

μ

t

−

μ

θ

∣

∣

2

−

n

+

l

o

g

1

)

=

∑

t

=

2

t

(

1

2

δ

t

2

∣

∣

μ

t

−

μ

θ

∣

∣

2

)

\begin{aligned} l_2&=\sum_{t=2}^td_{kl}(q(x_{t-1}|x_t,x_0)||p_\theta(x_{t-1}|x_t))\\ &=\sum_{t=2}^t(\frac{1}{2}(n+\frac{1}{\delta_t^2}||\mu_t-\mu_\theta||^2-n+log1)\\ &=\sum_{t=2}^t(\frac{1}{2\delta_t^2}||\mu_t-\mu_\theta||^2)\\ \end{aligned}

l2=t=2∑tdkl(q(xt−1∣xt,x0)∣∣pθ(xt−1∣xt))=t=2∑t(21(n+δt21∣∣μt−μθ∣∣2−n+log1)=t=2∑t(2δt21∣∣μt−μθ∣∣2)

则

μ

θ

\mu_\theta

μθ需要拟合

μ

t

\mu_t

μt,结合式2.2,

μ

θ

=

1

α

t

(

x

t

−

1

−

α

t

1

−

α

ˉ

t

ϵ

θ

(

x

t

)

)

\mu_\theta=\frac{1}{\sqrt{\alpha_t}}(x_t-\frac{1-\alpha_t}{\sqrt{1-\bar\alpha_t}}\epsilon_\theta(x_t))

μθ=αt1(xt−1−αˉt1−αtϵθ(xt)),可得

l

2

=

∑

t

=

2

t

(

(

1

−

α

t

)

2

2

δ

t

2

α

t

(

1

−

α

ˉ

t

)

∣

∣

ϵ

t

−

ϵ

θ

(

x

t

)

∣

∣

2

)

l_2=\sum_{t=2}^t(\frac{(1-\alpha_t)^2}{2\delta_t^2\alpha_t(1-\bar\alpha_t)}||\epsilon_t-\epsilon_\theta(x_t)||^2)

l2=t=2∑t(2δt2αt(1−αˉt)(1−αt)2∣∣ϵt−ϵθ(xt)∣∣2)

结合式子1.2以及坐标下降法,可得ddpm最终优化目标

l

l

l为

l

=

∣

∣

ϵ

t

−

ϵ

θ

(

α

ˉ

t

x

0

+

1

−

α

ˉ

t

ϵ

t

)

∣

∣

2

l=||\epsilon_t-\epsilon_\theta(\sqrt{\bar \alpha_t}x_0+\sqrt{1-\bar\alpha_t}\epsilon_t)||^2

l=∣∣ϵt−ϵθ(αˉtx0+1−αˉtϵt)∣∣2

结语

ddpm利用马尔科夫链建模图像生成的过程很巧妙,最终推导得到的式子也十分简单,确实是个很漂亮的工作

发表评论