文章目录

8.6 目标检测的常用数据集

8.6.1 pascal voc

voc数据集是目标检测经常用的一个数据集,自2005年起每年举办一次比赛,最开始只有4类,到2007年扩充为20个类,共有两个常用的版本:2007和2012。学术界常用的5k的train/val 2007和 16k 的train/val 2012作为训练集,test 2007 作为测试集,用10k 的train/val 2007+test 2007和 16k的train/val 2012作为训练集,test2012作为测试集,分别汇报结果。

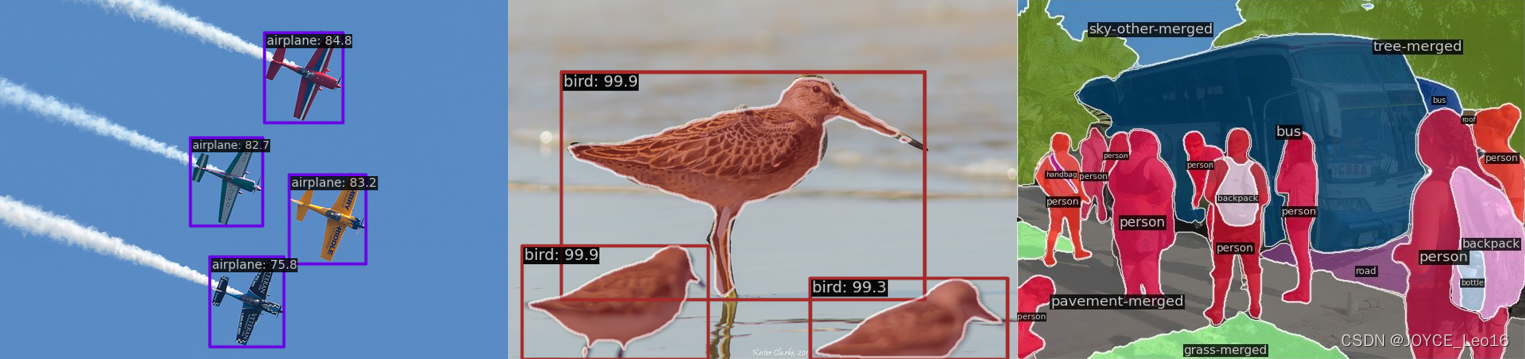

8.6.2 ms coco

coco数据集是微软团队发布的一个可以用来图像recognition + segmentation + captioning数据集,该数据集收集了大量包含常见物体的日常场景图片,并提供像素级的实例标注以更精确地评估检测和分割算法的效果,致力于推动场景理解的研究进展。依托这一数据集,每年举办一次比赛,现已涵盖检测、分割、关键点识别、注释等机器视觉的中心任务,是继imagenet chanllenge以来最有影响力的学术竞赛之一。

相比imagenet,coco更加偏好目标与其场景共同出现的图片,即non-iconic images。这样的图片能够反映视觉上的语义,更符合图像理解的任务要求。而相对的iconic images则更适合浅语义的图像分类等任务。

coco的检测任务共含有80个类,在2014年发布的数据规模分 train/val/test 分别为 80k/40k/40k,学术界较为通用的划分是使用train和35k的val子集作为训练集(trainval35k),使用剩余的val作为测试集(minival),同时向官方的evaluation server提交结果(test-dev)。除此之外,coco官方也保留一部分test数据作为比赛的评测集。

8.6.3 google open image

open image是谷歌团队发布的数据集。最新发布的open images v4包含190万图像、600个种类,1540万个bounding-box标注,是当前最大的带物体位置标注信息的数据集。这些边界框大部分都是由专业注释人员手动绘制的,确保了它们的准确性和一致性。另外,这些图像是非常多样化的,并且通常包含有多个对象的复杂场景(平均每个图像8个)。

8.6.4 imagenet

imagenet是一个计算机视觉系统识别项目,是目前世界上图像识别最大的数据库。imagenet是美国斯坦福的计算机科学家,模拟人类的识别系统建立的。能够从图片识别物体。imagenet数据集文档详细,有专门的团队维护,使用非常方便,在计算机视觉领域研究论文中应用非常广,几乎成为了目前深度学习图像领域算法性能检验的”标准“数据集。imagenet数据集有1400多万幅图片,涵盖2万多个类别;其中有超过百万的图片有明确的类别标注和图像中物体位置的标注。

8.6.5 dota

dota是遥感航空图像检测的常用数据集,包含2806张航空图像,尺寸大约为 4kx4k,包含15个类别共计188282个实例,其中14个主类,small vehicle 和 large vehicle都是vehicle的子类。其标注方式为四点确定的任意形状和方向的四边形。航空图像区别于传统数据集,有其自己的特点,如尺度变化性更大;密集的小物体检测;检测目标的不确定性。数据划分为 1/6 验证集。1/3 测试集,1/2 训练集。目前发布了训练集和验证集,图像尺寸从 800x800 到 4000x4000不等。

8.7 目标检测常用标注工具

8.7.1 labelimg

labelimg 是一款开源的图像标注工具,标签可用于分类和目标检测,它是用python编写的,并使用qt作为其图形界面,简单好用。注释以pascal voc格式保存为 xml文件,这是imagenet使用的格式。此外,它还支持coco数据集格式。

8.7.2 labelme

labelme 是一款开源的图像/视频标注工具,标签可用于目标检测、分割和分类。灵感是来自于mit开源的一款标注工具lebelme。labelme具有的特点是:

- 支持图像的标注的组件有:矩形框,多边形,圆,线,点(rectangle,polygons,circle,lines,points)

- 支持视频标注

- gui自定义

- 支持导出voc格式用于 semantic/instance segmentation

- 支持导出coco格式用于 instance segmentation

8.7.3 labelbox

labelbox 是一家为机器学习应用程序创建、管理和维护数据集的服务提供商,其中包含一款部分免费的数据标签工具,包含图像分类和分割,文本,音频和视频注释的接口,其中图像视频标注具有的功能如下:

- 可用于标注的组件有:矩形框,多边形,线,点,画笔,超像素等(bounding box,polygons,lines,points,brush,subpixels)

- 标签可用于分类,分割,目标检测等

- 以 json / csv / wkt / coco / pascal voc 等格式导出数据

- 支持 tiled imagery(maps)

- 支持视频标注(快要更新)

8.7.4 rectlabel

rectlabel 是一款在线免费图像标注工具,标签可用于目标检测、分割和分类。具有的功能或特点:

- 可用的组件:矩形框,多边形,三次贝塞尔曲线,直线和点,画笔,超像素

- 可只标记整张图像而不绘制

- 可使用画笔和超像素

- 导出为 yolo,kitti,coco json 和 csv格式

- 以 pascal voc xml 格式读写

- 使用 core ml模型自动标记图像

- 将视频转换为图像帧

8.7.5 cvat

cvat是一款开源的基于网络的交互式视频/图像标注工具,是对加州视频标注工具(video annotation tool)项目的重新设计和实现。

opencv团队正在使用该工具来标注不同属性的数百万个对象,许多 ui 和 ux 的决策都基于专业数据标注团队的反馈。具有的功能:

- 关键帧之间的边界框插值

- 自动标注(使用tensorflow od api 和 intel openvino ir格式的深度学习模型)

8.7.6 via

vgg image annotator(via)是一款简单独立的手动注释软件,适用于图像,音频和视频。via在web浏览器中运行,不需要任何安装或设置。页面可在大多数现代web浏览器中作为离线应用程序运行。

- 支持标注的区域组件有:矩形,圆形,椭圆形,多边形,点和折线。

8.7.7 其他标注工具

liblabel,一个用 matlab 写的轻量级 语义/示例(semantic/instance) 标注工具。 imagetagger:一个开源的图像标注平台。 anno-mage:一个利用深度学习模型半自动图像标注工具,预训练模型是基于ms coco数据集,用 retinanet 训练的。

当然还有一些数据标注公司,可能包含更多标注功能,例如对三维目标检测的标注(3d bounding box labelling),激光雷达点云的标注(lidar 3d point cloud labeling)等。

8.8 目标检测工具和框架

各种不同的算法虽然部分官方会有公布代码,或者github上有人复现,但是由于安装环境不一,实现的框架(pytorch、c++、caffee、tensorflow、mxnet等)不同,每次更换算法都需要重新安装环境,并且代码之间的迁移性差,十分不方便。所以为了方便将不同的算法统一在一个代码库中,不同的大厂都提出了自己的解决方案。如facebook的detectron、商汤科技的mmdetection、simpledet等。其中detectron最早,所以用户量最大,其次是国内近段时间崛起的mmdetection,下面介绍该目标检测工具箱。

1. introduction

mmdetection 特点:

- 模块化设计:将不同网络的部分进行切割,模块之间具有很高的复用性和独立性(十分便利,可以任意组合)

- 高效的内存使用

- sota

2. support frameworks

- 单阶段检测器

ssd、retinanet、fcos、fsaf

- 两阶段检测器

faster r-cnn、r-fcn、mask r-cnn、mask scoring r-cnn、grid r-cnn

- 多阶段检测器

cascade r-cnn、hybrid task cascade

- 通用模块和方法

soft-nms、dcn、ohen、train from scratch 、m2det 、gn 、hrnet 、libra r-cnn

3. architecture

模型表征:划分为以下几个模块:

backbone(resnet等)、neck(fpn)、densehead(anchorhead)、roiextractor、roihead(bboxhead/maskhead)

4. notice

- 1x代表12epoch的coco训练,2x类似推导

- 由于batch-size一般比较小(1/2这样的量级),所以大多数地方默认冻结bn层。可以使用gn代替。

5. 参考链接 mmdetection代码高度模块化,十分好用和便利,更详细的文档直接参见官方文档: github - open-mmlab/mmdetection: openmmlab detection toolbox and benchmark

注释版的mmdetection代码(更新至v1.0.0):github - ming71/mmdetection-annotated: mmdetection源码注释

使用方法简介: 安装记录(可能过时,以官方文档为准):https://ming71.github.io/mmdetection-memo.html 使用方法(截止更新日期,如果过时以官方为准):https://ming71.github.io/mmdetection-instruction.html

参考文献

object detection - handong1587

深度学习在 small object detection 有什么进展? - 知乎

rfbnet高精度检测算法笔记_rfb多尺度特征-csdn博客

[1] girshick r, donahue j, darrell t, et al. rich feature hierarchies for accurate object detection and semantic segmentation[c]//proceedings of the ieee conference on computer vision and pattern recognition. 2014: 580-587.

[2] girshick r. fast r-cnn[c]//proceedings of the ieee international conference on computer vision. 2015: 1440-1448.

[3] he k, zhang x, ren s, et al. spatial pyramid pooling in deep convolutional networks for visual recognition[j]. ieee transactions on pattern analysis and machine intelligence, 2015, 37(9): 1904-1916.

[4] ren s, he k, girshick r, et al. faster r-cnn: towards real-time object detection with region proposal networks[c]//advances in neural information processing systems. 2015: 91-99.

[5] lin t y, dollár p, girshick r, et al. feature pyramid networks for object detection[c]//proceedings of the ieee conference on computer vision and pattern recognition. 2017: 2117-2125.

[6] he k, gkioxari g, dollár p, et al. mask r-cnn[c]//proceedings of the ieee international conference on computer vision. 2017: 2961-2969.

[7] liu w, anguelov d, erhan d, et al. ssd: single shot multibox detector[c]//european conference on computer vision. springer, cham, 2016: 21-37.

[8] fu c y, liu w, ranga a, et al. dssd: deconvolutional single shot detector[j]. arxiv preprint arxiv:1701.06659, 2017.

[9] redmon j, divvala s, girshick r, et al. you only look once: unified, real-time object detection[c]//proceedings of the ieee conference on computer vision and pattern recognition. 2016: 779-788.

[10] redmon j, farhadi a. yolo9000: better, faster, stronger[c]//proceedings of the ieee conference on computer vision and pattern recognition. 2017: 7263-7271.

[11] redmon j, farhadi a. yolov3: an incremental improvement[j]. arxiv preprint arxiv:1804.02767, 2018.

[12] lin t y, goyal p, girshick r, et al. focal loss for dense object detection[c]//proceedings of the ieee international conference on computer vision. 2017: 2980-2988.

[13] liu s, huang d. receptive field block net for accurate and fast object detection[c]//proceedings of the european conference on computer vision (eccv). 2018: 385-400.

[14] zhao q, sheng t, wang y, et al. m2det: a single-shot object detector based on multi-level feature pyramid network[j]. arxiv preprint arxiv:1811.04533, 2018.

发表评论