主业写代码,副业做 ai

大家好,我是程序员晓晓

模型分类与使用

在 ai绘画stable diffusion 中,模型分为大模型、vae、lora、embedding、hypernetwork 等。

大模型

大模型又称基础模型、底模、主模型。英文名 checkpoint,简称 ckpt。模型文件通常以 .ckpt 或 .safetensors 结尾,文件大小在 2g~7g 之间。

在 stable diffusion webui 中,大模型的存放目录为:stable-diffusion-webui/models/stable-diffusion。只需将下载好的模型文件拷贝至该目录,即可在 webui 左上角切换使用,如果是在运行状态下进行的拷贝,则需点击右侧的刷新按钮重新加载模型。

大模型决定了 ai 绘画的主要风格,目前主要有三大类:真人写实、二次元、2.5d 等。

vae

vae,全称 variational autoencoder,中文叫变分自编码器,结合了自编码器(autoencoder)和概率推断的思想,主要用于无监督学习任务。模型文件通常以 .pt 或 .safetensors 结尾。在 sd 中的作用可以理解为“滤镜”。

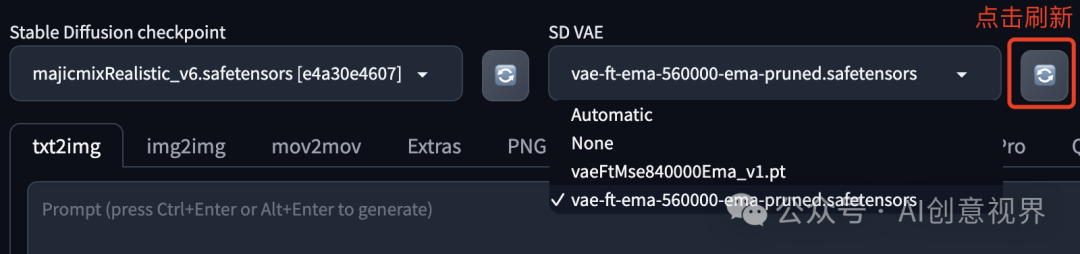

在 stable diffusion webui 中,需要提前设置才能在主界面上选择 vae 模型。设置步骤:点击 settings -> user interface -> 找到 [info] quicksettings list -> 添加 sd_vae -> apply settings -> reload ui。

vae 模型的存放目录为:stable-diffusion-webui/models/vae。只需将下载好的 vae 模型文件拷贝至该目录,即可在 webui 界面上切换使用。

vae 模型要搭配大模型一起使用。但不是所有大模型都需要 vae, 因为一些稳定的大模型本身就自带 vae,可以直接生成色彩正常的图像,再额外使用 vae 可能会适得其反。

常用的 vae 模型是 stability ai 推出的 ema(exponential moving average)和 mse(mean square error),对应 vae-ft-ema-560000-ema-pruned.safetensors 和 vae-ft-mse-840000-ema-pruned.safetensors,在实际出图效果上,ema 更锐利、而 mse 更平滑。

如果一个大模型生成的图片发灰,颜色暗淡,就需要使用 vae 模型。

lora

lora 模型是一种微调模型,用于生成特定的人物、物品或画风。全称 low-rank adaptation,中文叫低秩自适应模型。模型文件通常以 .ckpt、.safetensors 和 .pt 结尾,文件大小和训练时指定的网络纬度参数有关,通常是 36m, 72m, 144m 等。

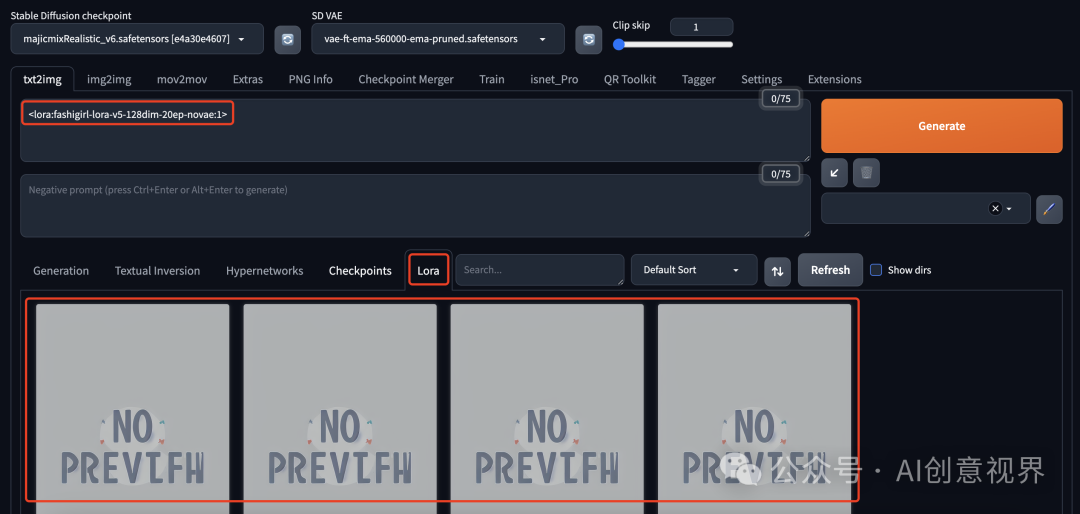

在 stable diffusion webui 中,lora 模型的存放目录为:stable-diffusion-webui/models/lora。需要将下载好的 lora 模型文件拷贝至该目录,然后在正向提示词中输入使用,提示词语法:

<lora:模型文件名:权重>

权重的取值范围是:0-1。权重越高则生成的图片越贴近模型提供的风格,通常建议设置在 0.5~0.8 之间。

也可点击 stable diffusion webui 界面中的 lora 选项卡,鼠标聚焦正向提示词输入框后,点击想要使用的 lora 模型,输入框内会自动填充提示词,然后修改权重即可。

部分 lora 模型会存在触发词,需要在正向提示词中进行添加,具体需查看模型使用说明。多个 lora 模型可同时使用,最终出图效果会综合每个 lora 的风格。

embedding

embedding 模型是一种微调模型。它是 textual inversion(文本反转)训练的结果。中文叫嵌入模型。它通过训练少量的图像,让大模型快速学会一个新的概念,可以简单的理解为提示词“打包”。模型文件通常以 .pt 结尾,文件大小通常只有几十 kb。

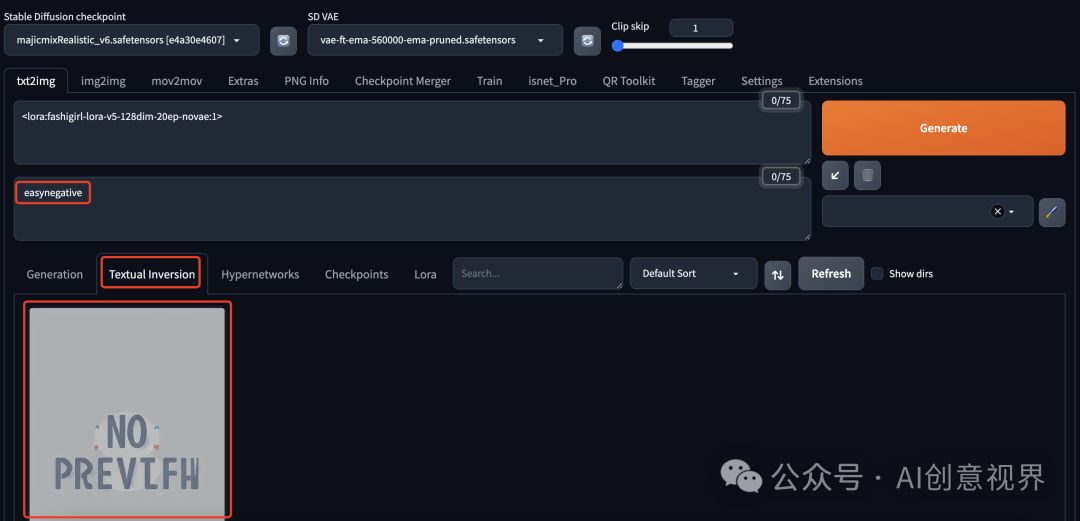

在 stable diffusion webui 中,embedding 模型的存放目录为:stable-diffusion-webui/embeddings。需要将下载好的 embedding 模型文件拷贝至该目录,然后在提示词中输入模型文件名即可使用。

在正向提示词场景下,embedding 模型可以通过很小的训练成本,快速获得特定的人物形象、画风、姿势动作等,但因为训练数据量小,精度有限,出图效果上不如 lora 模型,所以并不常用。

而在负向提示词场景下,由于每次出图都需要在负面提示词中输入一长串词语,例如“低分辨率、模糊、扭曲的五官、错误的手指、多余的数字,水印”等,使用 embeddings 模型可以将这一长串的负向提示词“打包”为一个提示词,并产生同等甚至更好的效果,所以 embedding 模型常用于负向提示词。

目前常用的负向提示词 embedding 模型是 easynegative,下载地址为 https://civitai.com/models/7808/easynegative。

在 webui 中,点击 textual inversion 选项卡即可看到 embedding 模型,鼠标聚焦负向提示词输入框后,点击想要使用的 embedding 模型,输入框内会自动填充提示词。

hypernetwork

hypernetwork(超网络)模型现在已经不常用了,逐渐被 lora 模型替代。模型文件通常以 .pt 结尾,文件大小在 100mb 左右。

在 stable diffusion webui 中,hypernetwork 模型的存放目录为:stable-diffusion-webui/models/hypernetworks。需要将下载好的 hypernetwork 模型文件拷贝至该目录,然后在正向提示词中输入使用,提示词语法:

<hypernet:模型文件名:权重>

部分 hypernetwork 模型会存在触发词,需要在正向提示词中进行添加,具体需查看模型使用说明。多个 hypernetwork 模型之间尽量不要混用。

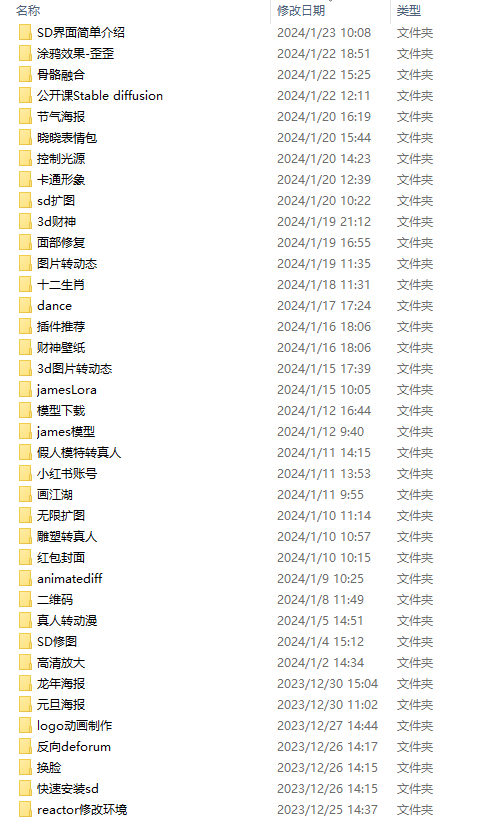

模型下载

c 站(https://civitai.com) 是全球最大的 stable diffusion 模型分享和下载网站。

hugging face(https://huggingface.co) 是全球最大的机器学习社区,包含模型、数据集和应用等。

写在最后

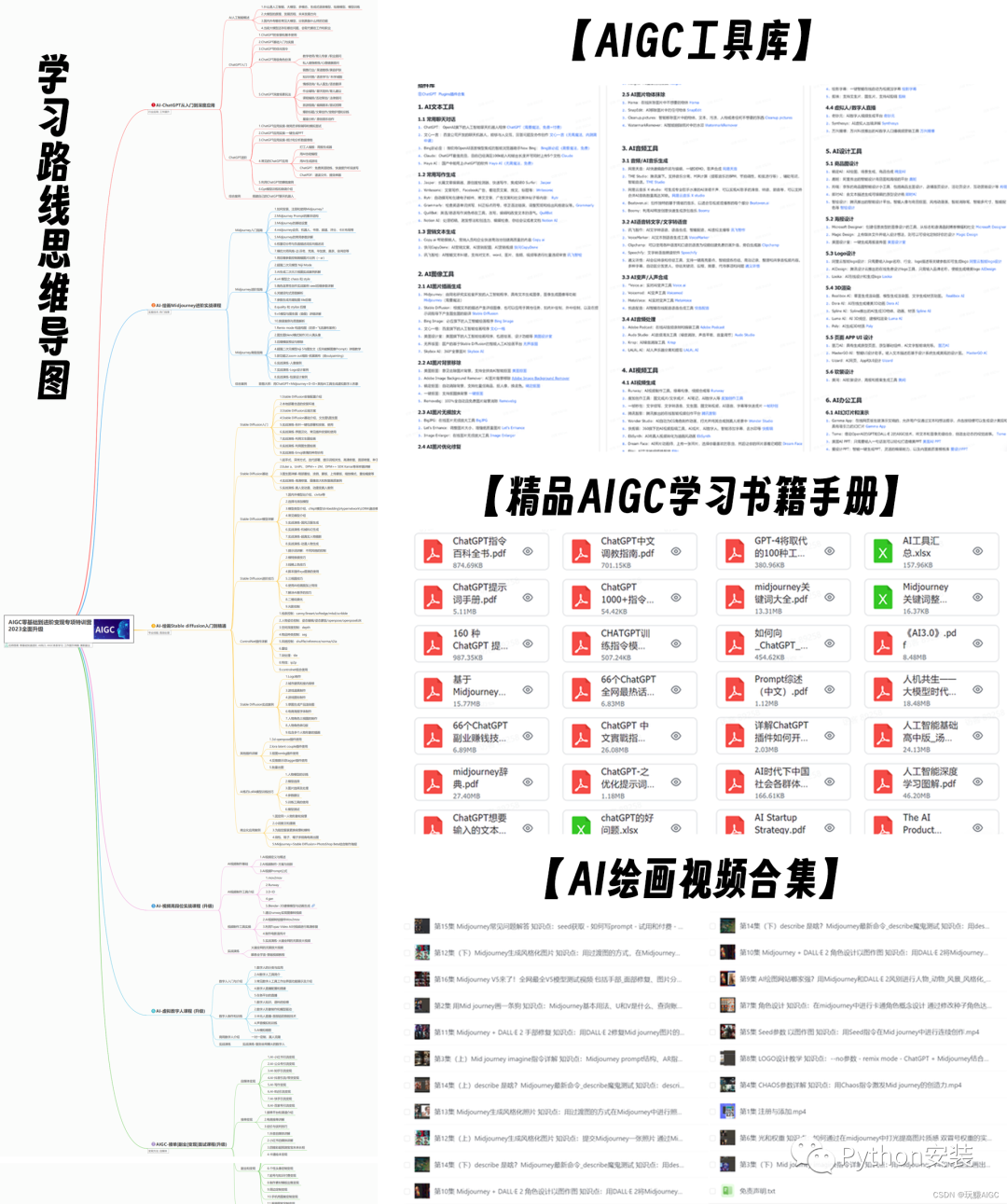

感兴趣的小伙伴,赠送全套aigc学习资料,包含ai绘画、ai人工智能等前沿科技教程和软件工具,具体看这里。

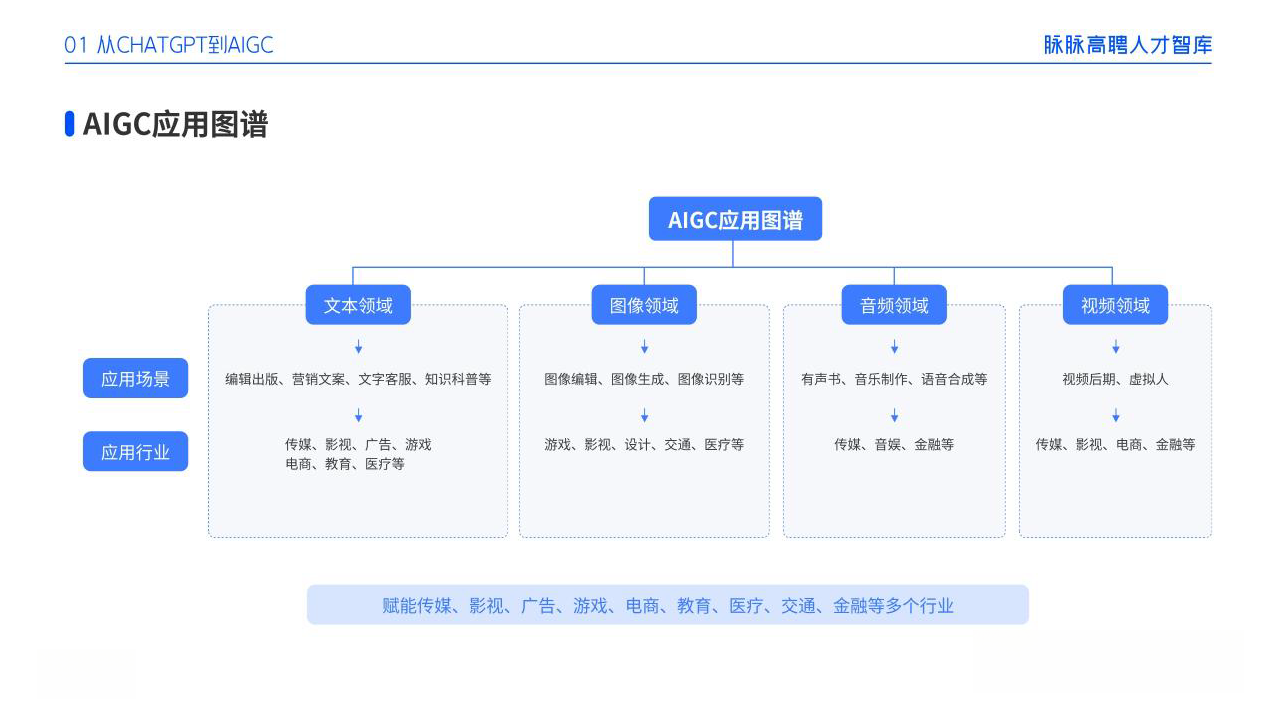

aigc技术的未来发展前景广阔,随着人工智能技术的不断发展,aigc技术也将不断提高。未来,aigc技术将在游戏和计算领域得到更广泛的应用,使游戏和计算系统具有更高效、更智能、更灵活的特性。同时,aigc技术也将与人工智能技术紧密结合,在更多的领域得到广泛应用,对程序员来说影响至关重要。未来,aigc技术将继续得到提高,同时也将与人工智能技术紧密结合,在更多的领域得到广泛应用。

一、aigc所有方向的学习路线

aigc所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

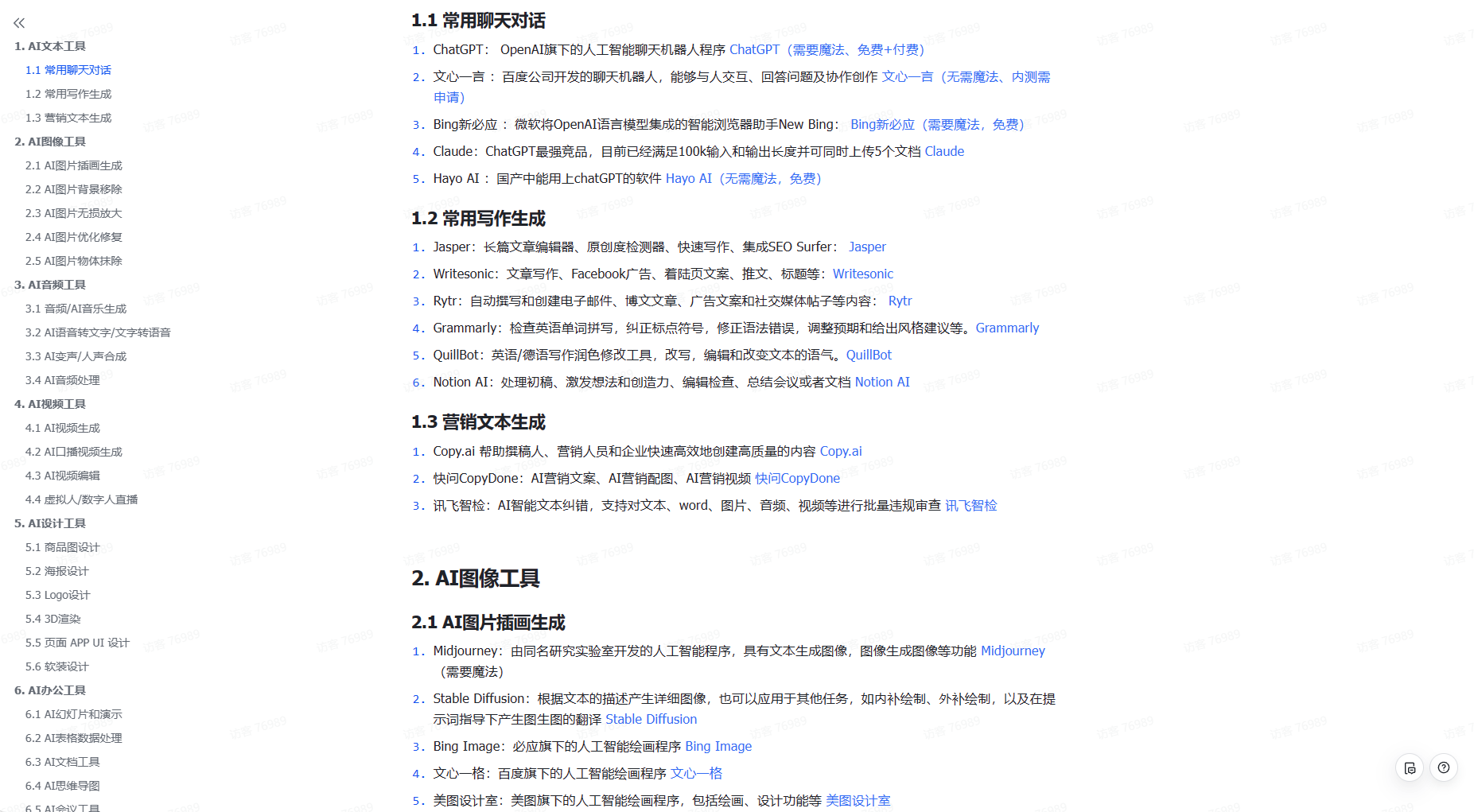

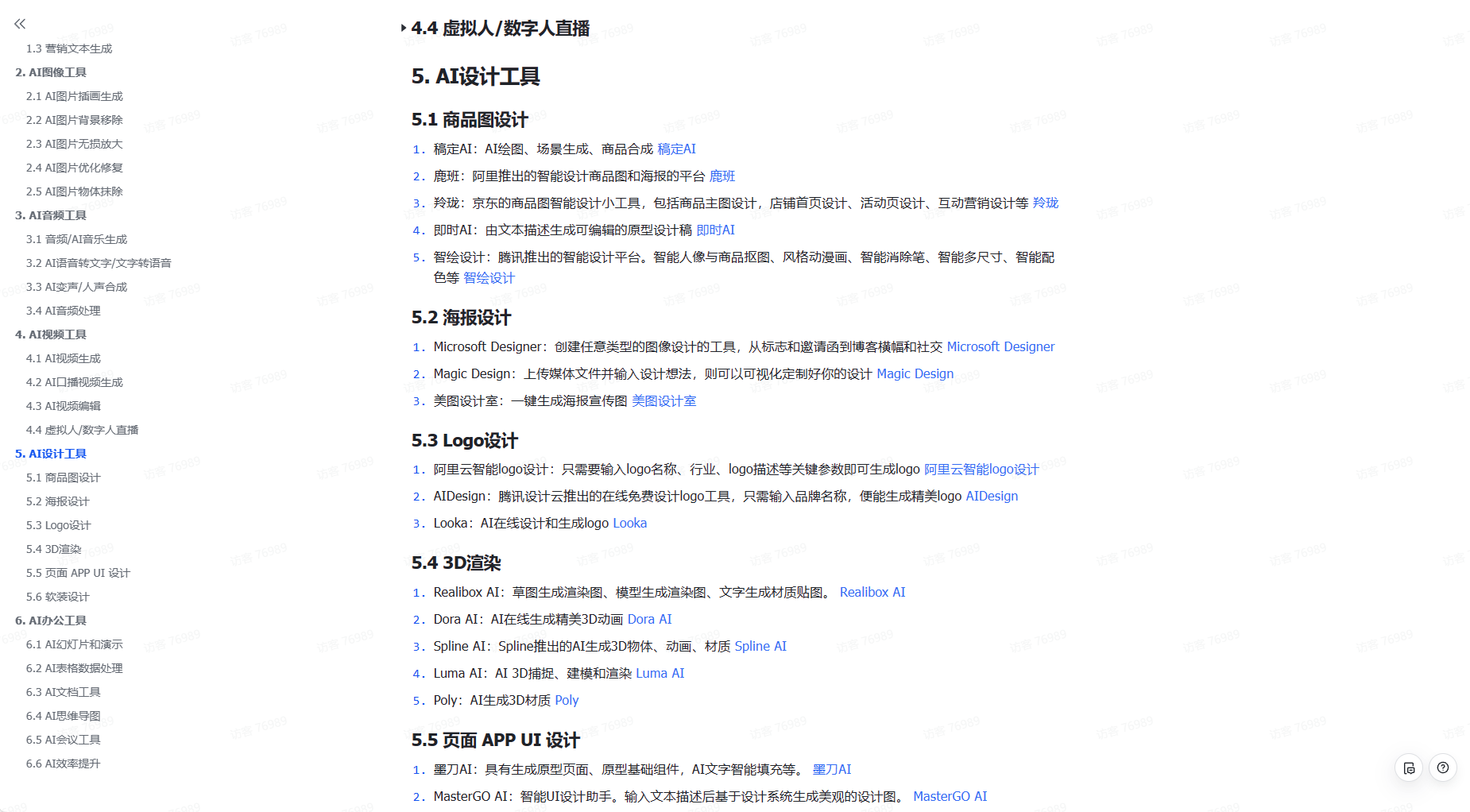

二、aigc必备工具

工具都帮大家整理好了,安装就可直接上手!

三、最新aigc学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、aigc视频教程合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

若有侵权,请联系删除

若有侵权,请联系删除

发表评论