torch.nn - pytorch中文文档 (pytorch-cn.readthedocs.io)

lstm — pytorch 2.3 documentation

lstm层的作用

lstm层:长短时记忆网络层,它的主要作用是对输入序列进行处理,对序列中的每个元素进行编码并保存它们的状态,以便后续的处理。

lstm 是一种特殊的 rnn,它通过引入门控机制来解决传统 rnn 的长期依赖问题。

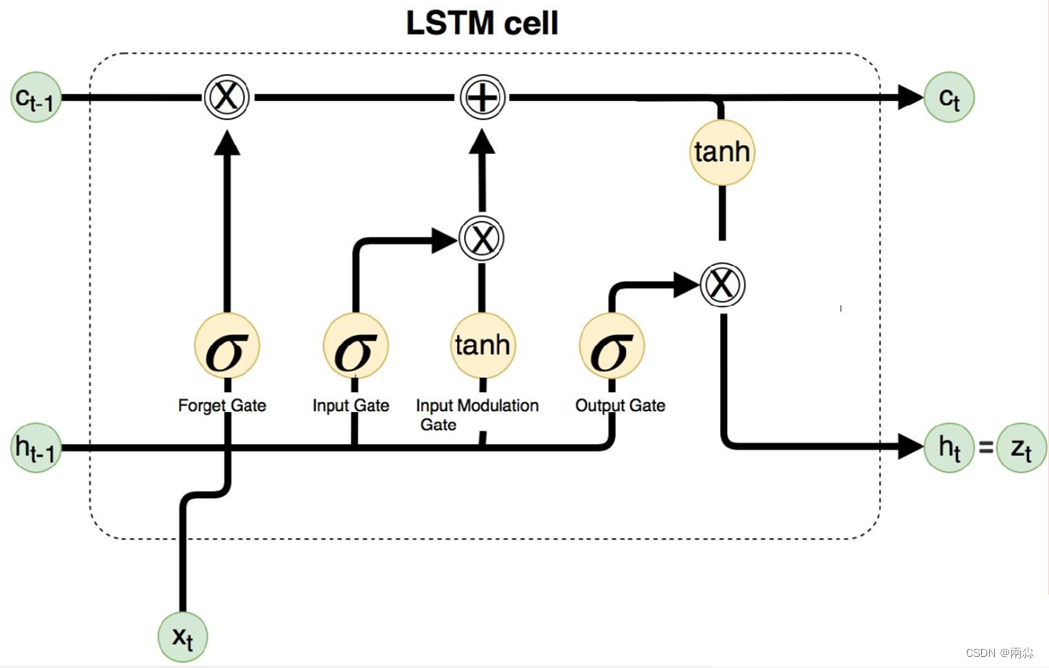

我们假设:h为lstm单元的隐藏层输出,c为lstm内存单元的值,x为输入数据。

lstm 的结构包含以下几个关键组件:

1、输入门(input gate):决定当前时间步的输入信息对细胞状态的影响程度。

2、遗忘门(forgetgate):决定上一个时间步的细胞状态对当前时间步的影响程度。

3、细胞状态(cell state):用于在不同时间步之间传递和存储信息。

4、输出门(output gate):决定细胞状态对当前时间步的输出影响程度。

5、隐藏状态(hiddenstate):当前时间步的输出,也是下一个时间步的输入。

nn.lstm

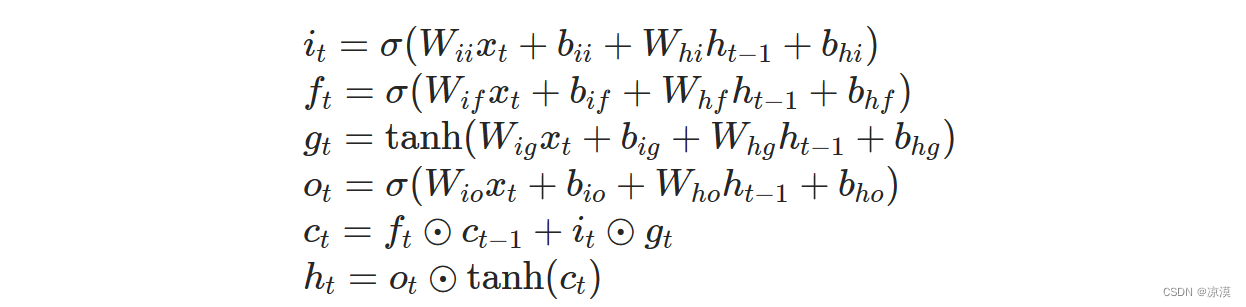

计算公式

对输入序列的每个元素,lstm的每层都会执行以下计算:

h_t是时刻t的隐状态,

c_t是时刻t的细胞状态,

x_t是上一层的在时刻t的隐状态或者是第一层在时刻t的输入。

i_t, f_t, g_t, o_t分别代表 输入门,遗忘门,细胞和输出门。

参数说明:

torch.nn.lstm(input_size, hidden_size, num_layers=1, bias=true, batch_first=false, dropout=0.0, bidirectional=false, proj_size=0, device=none, dtype=none)

- input_size – 输入

x的特征数量。 - hidden_size – 隐层的特征数量。

- num_layers – rnn的层数。

- nonlinearity – 激活函数。指定非线性函数使用

tanh还是relu。默认是tanh。 - bias – 是否使用偏置。

- batch_first – 如果true的话,那么输入

tensor的shape应该是[batch_size, time_step, feature],输出也是这样。默认是 false,就是这样形式,(seq(num_step), batch, input_dim),也就是将序列长度放在第一位,batch 放在第二位 - dropout – 默认不使用,如若使用将其设置成一个0-1的数字即可。如果值非零,那么除了最后一层外,其它层的输出都会套上一个

dropout层。 - bidirectional是否使用双向的 rnn,默认是 false

输入:input, (h_0, c_0)

- input_shape = [时间步数, 批量大小, 特征维度] = [num_steps(seq_length), batch_size, input_dim]=input (seq_len, batch, input_size)保存输入序列特征的

tensor。 - h_0是shape=(num_layers*num_directions,batch_size,hidden_size)的张量,保存着

batch中每个元素的初始化隐状态的tensor。其中num_layers就是lstm的层数。如果bidirectional=true,num_directions=2,否则就是1,表示只有一个方向。 -

c_0 是shape=(num_layers*num_directions,batch_size,hidden_size)的张量, 保存着batch中每个元素的初始化细胞状态的tensor。h_0,c_0如果不提供,那么默认是0。

输出:output, (h_n, c_n)

- output的shape=(seq_length,batch_size,num_directions*hidden_size),(时间步数, 批量大小, 隐藏单元个数)。保存最后一层的输出的

tensor。 - h_n (num_layers * num_directions, batch, hidden_size):

tensor,保存着lstm最后一个时间步的隐状态。 - c_n (num_layers * num_directions, batch, hidden_size):

tensor,保存着lstm最后一个时间步的细胞状态。

lstm模型参数:

lstm — pytorch 2.3 documentation

lstm的结构解释:

matlab神经网络---lstmlayer(lstm 长短期记忆神经网络)-csdn博客

发表评论