llms之dify:dify的简介、安装和使用方法、案例应用之详细攻略

目录

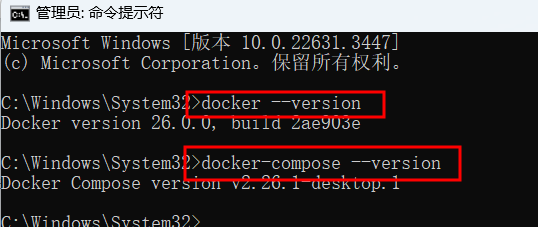

安装docker和docker compose,参考a3、windows11系统安装→交互式安装即可,一次性安装docker和docker compose

llms之rag:基于ollama后端框架(配置phi3/llama-3模型)结合dify前端框架(设置知识库文件+向量化存储+应用发布)创建包括实现本地知识库问答/翻译助手等多个应用

dify的简介

2023年5月,dify正式发布,这是一个开源的llm应用程序开发平台。它直观的界面结合了人工智能工作流程、rag管道、代理能力、模型管理、可观察性特性等等,让您能够快速从原型到生产。

github地址:https://github.com/langgenius/dify

1、核心功能列表

>> 工作流:在可视化画布上构建和测试强大的人工智能工作流程,利用以下所有功能以及更多功能。

>> 全面的模型支持:与数百个专有/开源llm(language model)以及数十个推理提供商和自托管解决方案实现无缝集成,涵盖了gpt、mistral、llama3以及任何与openai api兼容的模型。支持的模型提供商完整列表可以在这里找到。

>> 提示ide:为制作提示、比较模型性能以及为基于聊天的应用程序添加其他功能(如文本转语音)提供直观的界面。

>> rag管道:广泛的rag功能,涵盖了从文档摄取到检索的所有内容,支持从pdf、ppt等常见文档格式中提取文本。

>> 代理能力:您可以基于llm函数调用或react定义代理,并为代理添加预构建或自定义工具。dify提供了50多个用于ai代理的内置工具,如google搜索、dell·e、稳定扩散和wolframalpha。

>> llmops:随着时间的推移监视和分析应用程序日志和性能。您可以根据生产数据和注释持续改进提示、数据集和模型。

>> 作为后端服务:dify的所有功能都配备了相应的api,因此您可以轻松地将dify集成到自己的业务逻辑中。

2、特性比较

| feature | dify.ai | langchain | flowise | openai assistants api |

|---|---|---|---|---|

| programming approach | api + app-oriented | python code | app-oriented | api-oriented |

| supported llms | rich variety | rich variety | rich variety | openai-only |

| rag engine | ✅ | ✅ | ✅ | ✅ |

| agent | ✅ | ✅ | ✅ | ✅ |

| workflow | ✅ | ❌ | ✅ | ❌ |

| observability | ✅ | ✅ | ❌ | ❌ |

| enterprise feature (sso/access control) | ✅ | ❌ | ❌ | ❌ |

| local deployment | ✅ | ✅ | ✅ | ❌ |

dify的安装和使用方法

1、dify的安装和启动

| 硬件 | 在安装dify之前,请确保您的计算机满足以下最低系统要求: cpu >= 2核 ram >= 4gb |

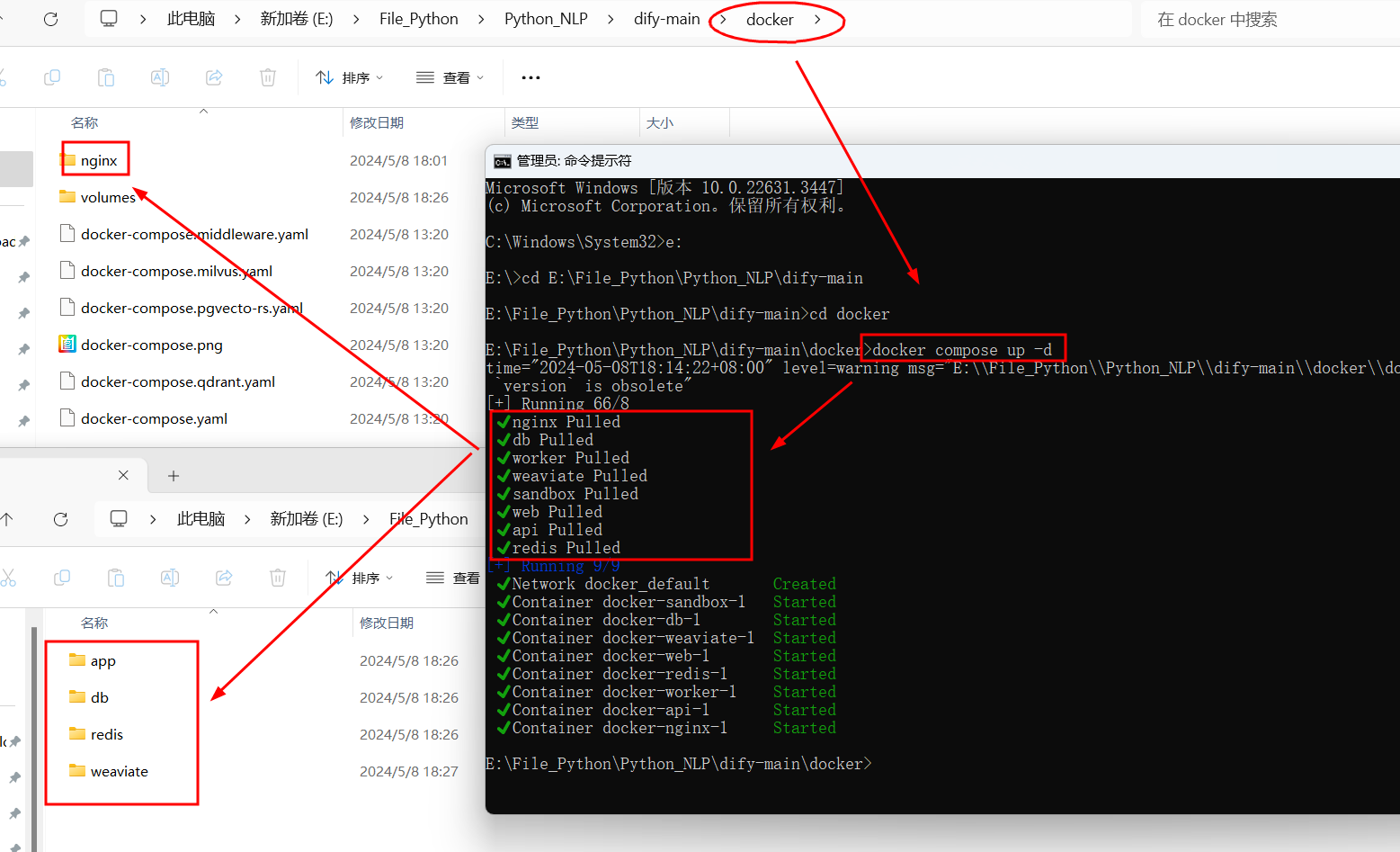

| 启动 | 启动dify服务器的最简单方法是运行我们的docker-compose.yml文件。在运行安装命令之前,请确保docker和docker compose已安装在您的计算机上: docker --version docker-compose --version cd docker docker compose up -d # 这个命令会根据 docker-compose.yml 文件中的配置,创建并启动所有的服务容器,并且在启动后让这些容器在后台运行。 运行后,您可以在浏览器中访问http://localhost/install并开始初始化过程。 如果您想要为dify做出贡献或进行额外的开发,请参考我们的部署指南 |

| 自定义 | 如果您需要自定义配置,请参考我们docker-compose.yml文件中的注释并手动设置环境配置。在进行更改后,请再次运行docker-compose up -d。您可以在此处查看完整的环境变量列表。 如果您想要配置高可用性设置,社区贡献的helm charts可以让dify部署在kubernetes上。 |

安装docker和docker compose,参考a3、windows11系统安装→交互式安装即可,一次性安装docker和docker compose

docker:docker的简介、安装、使用方法之详细攻略_docker 知乎-csdn博客

2、使用dify:

t1、云端

我们为任何人提供了一个无需设置即可尝试的dify云服务。它提供了自部署版本的所有功能,并包括沙箱计划中的200次免费gpt-4调用。

t2、自托管dify社区版:

使用这个入门指南快速在您的环境中运行dify。使用我们的文档以获取进一步的参考和更详细的说明。

t3、面向企业/组织的dify:

我们提供额外的面向企业的功能。与我们安排会议或发送电子邮件讨论企业需求。

对于使用aws的初创企业和小型企业,请查看aws marketplace上的dify premium,并使用一键部署到您自己的aws vpc。这是一个价格实惠的ami套餐,可选择使用自定义标志和品牌创建应用程序。

dify的案例应用

持续更新中……

llms之rag:基于ollama后端框架(配置phi3/llama-3模型)结合dify前端框架(设置知识库文件+向量化存储+应用发布)创建包括实现本地知识库问答/翻译助手等多个应用

发表评论