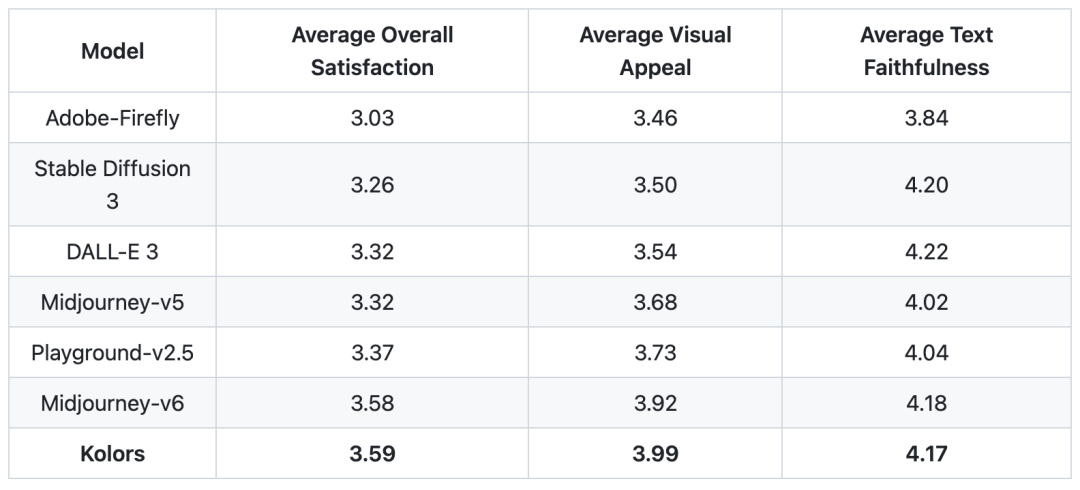

比肩midjourney-v6,快手的文生图开源模型可图kolors一发布,开源社区就炸开了锅。短短几天,可图在github上收获2k star,huggingface模型下载热榜第一。

7月6日,快手宣布开源数十亿参数的文生图模型可图kolors,可图支持中英文双语,支持长达256 token的上下文长度,最重要的是可以渲染中文,生成效果上实现了质的飞跃。

值得一提的是,可图采用了智谱的开源大模型chatglm3作为文本编码器,对中文的理解能力远超很多竞品。

国产文生图模型的强势崛起让人振奋,不过,由于硬件等客观条件限制,大多数跃跃欲试的用户却很难在本地部署并体验可图。

首先,可图模型完整下载有28g,下载模型、存放模型比较不方便;其次,可图采用的chatglm3代替了传统的clip模型做文本提示词嵌入,语义能力增强的同时显存消耗也从原来的几百mb变成十几g,这样,本地显存少于20g的用户,需要用有损量化或者损失推理速度的办法运行可图。

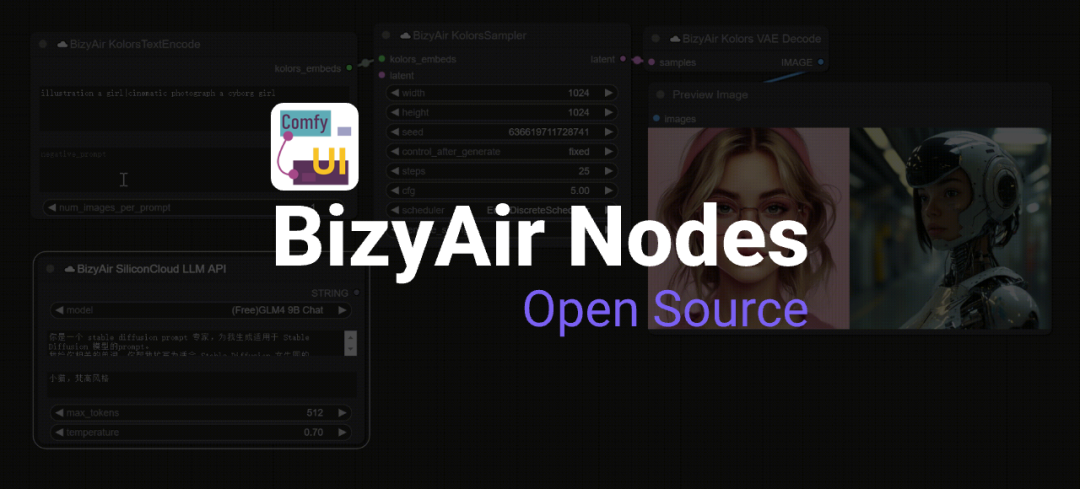

为了让用户无痛使用可图,硅基流动团队开源了bizyair节点,这是一个专用于comfyui的节点仓库,首批节点就有可图kolors。

现在,没有显卡,不用下载模型,你也能用可图极速生成图片。

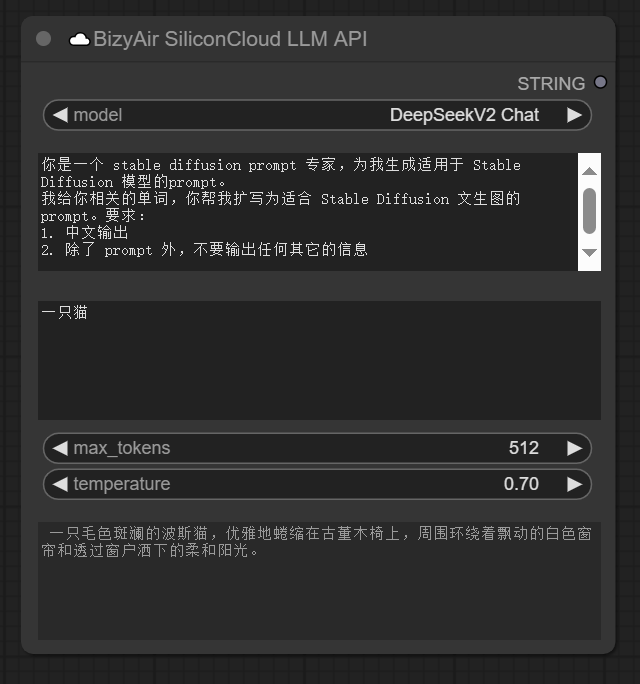

bizyair还同步上线了一个小惊喜。考虑到写提示词的环节也很费劲,我们开源了siliconcloud llm节点,让glm4、deepseek v2 chat这类顶尖大语言模型接入comfyui,帮助你在工作流中生成、提炼提示词。

以deepseek v2 chat为例,如果用它提炼提示词,需要500g左右的硬盘空间和8张a100以上的显卡才能部署这个模型,而siliconcloud llm节点直接提供了这个能力。

除了免去了用户搭配环境、模型下载与模型部署的门槛与烦恼。硅基流动还对kolors节点提供基于专用的图片生成推理引擎onediff优化,节约图片生成时间与成本。

当然,你也可以一键无缝接入已有comfyui工作流,并可自由与本地节点做平替或组合。

一键直达传送门:

代码:github.com/siliconflow/bizyair

那么,如何在comfyui中使用可图kolors?

只需两大步。

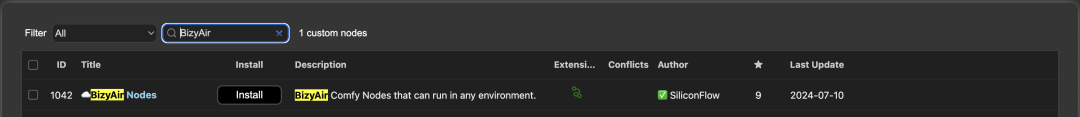

一、安装bizyair

在comfyui manager中搜索“bizyair”即可完成安装。

此外,你还可以通过源码、comfy-cli安装。windows新手可以下载独立的压缩包,具体可见:siliconflow.github.io/bizyair/getting-started/

二、快速开始

-

设置api密钥

首次使用,你需要通过“set siliconcloud api key(设置siliconcloud api密钥)”来生成api密钥(https://cloud.siliconflow.cn/account/ak)。之后,这个节点就可以删除了。之后重启程序,也不需要重新输入。

-

使用bizyair节点

所有bizyair节点都在“☁️bizyair”目录下。其中“☁️bizyair siliconcloud llm api”节点可以利用大型语言模型帮你精炼提示词、翻译或执行任何其他任务。

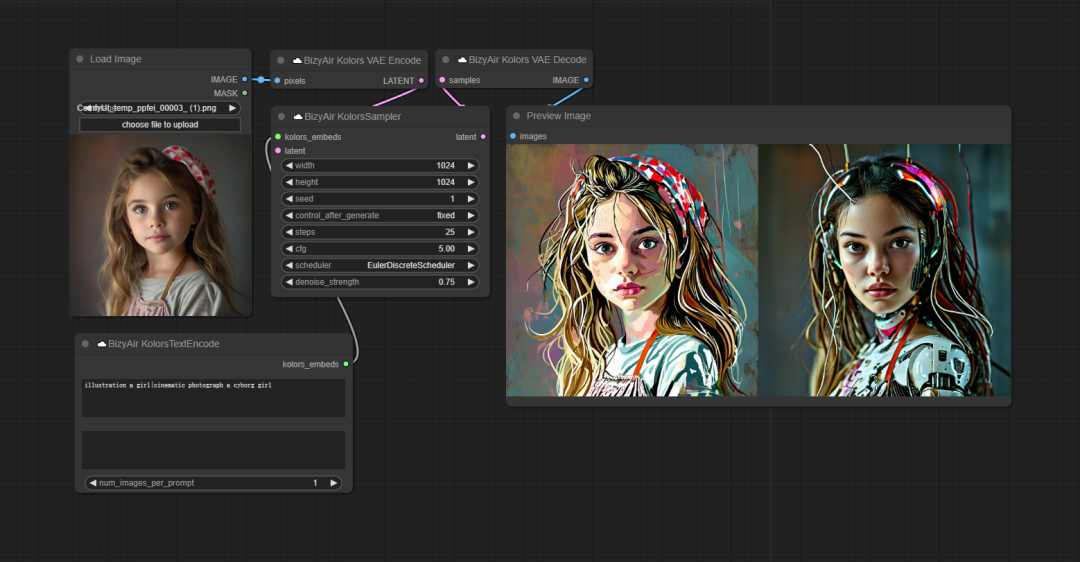

现在,你也可以添加“kolors”节点快速进行文生图了。目前,bizyair提供了与kolors相关的节点,包括kolors sampler、text encoding、vae decoding、vae encoding。

当然,图生图也不在话下。

快试试吧:

github.com/siliconflow/bizyair

其他人都在看

开发生成式ai应用,减少响应时间

就用siliconcloud

发表评论