万众瞩目的stable diffusion 3终于正式开源了!

目前开源的是20亿参数的版本,据悉之后还会开源40亿和80亿的“大杯”与“超大杯”。

最近母公司stability ai的坏消息连连,据传账面现金都不够支付算力服务器的租赁费。

欠债一亿美金的ai独角兽,为何仍坚持做「开源英雄」?

今年4月,stable diffusion 3首次对外公开,但那会只开放了api。很快在“人类偏好评估”中力压dall·e 3和midjourney v6,一举成为该领域的sota(现阶段最好的解决方案)。

因为攻克了ai图像生成领域极其困难的「文本生成准确性」,sd3一时名声大噪,引发了极大热度。

可以在图上的指定对象精准生成文字,be like。

在鼎盛时期,stability ai收获过不少的橄榄枝,却断然拒绝被收购。

现如今,欠债累累的公司依然毅然决然走上开源之路。

——强大的架构、更好的明暗对比度、提示遵循、训练结果、模型合并、图像分辨率……sd3的开源给我们带来的贡献可太多了!

所有ai绘图圈的玩家都在翘首以盼。

sd3:源神,启动!

stable diffusion 3的开源,为何意义如此重大?

一位reddit社区的老哥从技术视角帮助我们理解sd3的重要性,以及对ai开源社区的重大影响。

作者表示,stable diffusion 3是如此的重要,它改变了游戏规则。

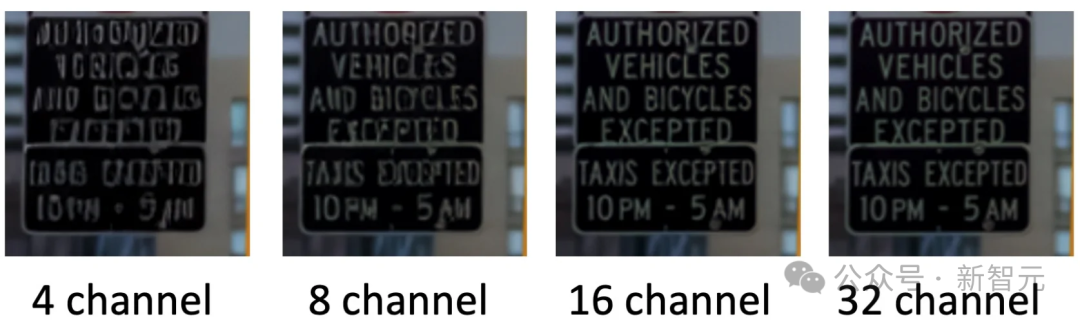

stability ai发明了一种vae(变分自编码器)非常特殊,因为它提供了16个通道的特征和颜色数据采集器供我们使用,而之前的文生图模型只有4个通道。

下面的四张图对比可以看到通道数的影响有多大。

通道越多,意味着图像模型在训练时会捕获更多细节,也就更容易还原我们想要的高清文字,而不是「鬼画符」。

不仅模型的出图质量会更好,而且可以带来更好的训练效率。

与旧的模型相比,新一代的16通道vae在512x512如此小的分辨率下依然可以捕捉到很好的细节。

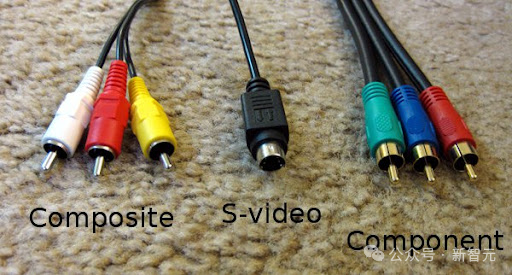

为了更容易理解画质的进步,我们用一个示例类比——

如果你是骨灰级游戏玩家肯定见过这几种视频线。

●左:红黄白视频线(composite cables)= sd 1.x vae

●中:s-video视频线 = sdxl vae

●右:红绿蓝视频线(component cables)= sd3 vae

因此,将vae应用到如今我们的ai工作流程中,一切都将变得更加高效。

sd3实战出图

接下来,让我们引用@数字生命卡兹克的出片感受一下。

此前版本的stable diffusio很烦的是,你必须要加一些画质提示词作为提示词后缀,比如best quality, high resolution, 8k之类。

那sd3呢,我不给它添加任何的画质提示词就已经可以实现高质量出图。

咱们直接来看效果——

①长提示语义理解测试

●sd1.5:emmm,怎么裂开两张了,小猫咪看起来不太高兴啊,挎着个脸

●sd2.0:不是,怎么船里长猫了~~

●sdxl:整体还行,但画面有点昏暗,配色不是很舒服。

●sd3:王炸!语义理解能力极强,阳光明媚,美丽的海滩,鲜花等等关键细节什么处理得很好,画面构图也和谐。

②测一下相对位置关系理解,着重考察模型构图能力

●sd1.5:热狗起飞了……

●sd2.0:你以为将热狗放到地上就挑不出毛病了是吧,但是不符合画面表述

●sdxl:基本符合语义,但是狗狗的舌头崩坏了

●sd3:王炸!光效衔接都非常自然,小狗很可爱,热狗也很有食欲

③二次元人物

●sd1.5:脸模过于抽象,细节丢了,学画3月的功力?

●sd2.0:变成了千手观音?

●sdxl:有点感觉了,但是手柄的透视不对

●sd3:从头发到眼镜,从整体画质到细节都是最好的

我们再测一组——

并不意外,sd3依然是最稳定的那个。

④科幻风格

●sd1.5:没有识别出五颜六色

●sd2.0:右边这哥们你的手臂咋掉了

●sdxl:机器人形象模仿了星球大战r2-d2,但是三条腿不对称

●sd3:好家伙,无头机器人,大黄蜂+刑天合体

⑤写实图像,要求在水下

●sd1.5:对人数的认知不对

●sd2.0:好可怕,像泡发的奥特曼

●sdxl:像鬼故事里边的小孩

●sd3:奶思!

再测另一组真人写实成像——

sd3妥妥的完胜!

⑥来一组风景图生成

●sd1.5:还行

●sd2.0:凑合,但是恒星跑到星云外,偏离现实

●sdxl:这个模型版本真的很容易出卡通图

●sd3:兼具艺术感与科幻

⑦最后测试一个sd3的拿手好戏,文字嵌入

在图像上生成准确的文字,目前sd3是独一份的卓越。

经过一番对比,相信家人们已经能够直观感受sd3的威力。也能感知stable diffusion系列迭代的进化史。

我都不敢想象加以高质量的辅助描述提示词,配合ai绘图开源社区的微调模型等强大的应用生态,sd3文生图模型可以变得多强。

最关键的是,它开源的。

所以,免费。现在它可以直接在你的电脑里自由跑了。

sd3对于模型的训练放宽了硬件要求,并针对英伟达与amd的最新gpu、apu进行了专门的推理优化。

本次发布开源的stable diffusion 3 medium版本,这是一个20亿参数的小参数模型,体积小巧,可以在用户的桌面pc消费级显卡、笔记本显卡以及企业级gpu服务器上运行。

乃至经过蒸馏后缩小直接在手机上运行,目前stability ai正在与高通公司开展相关合作。

家人可以通过hugging face在线试玩:

https://huggingface.co/stabilityai/stable-diffusion-3-medium

写在最后

感兴趣的小伙伴,赠送全套aigc学习资料,包含ai绘画、ai人工智能等前沿科技教程和软件工具,具体看这里。

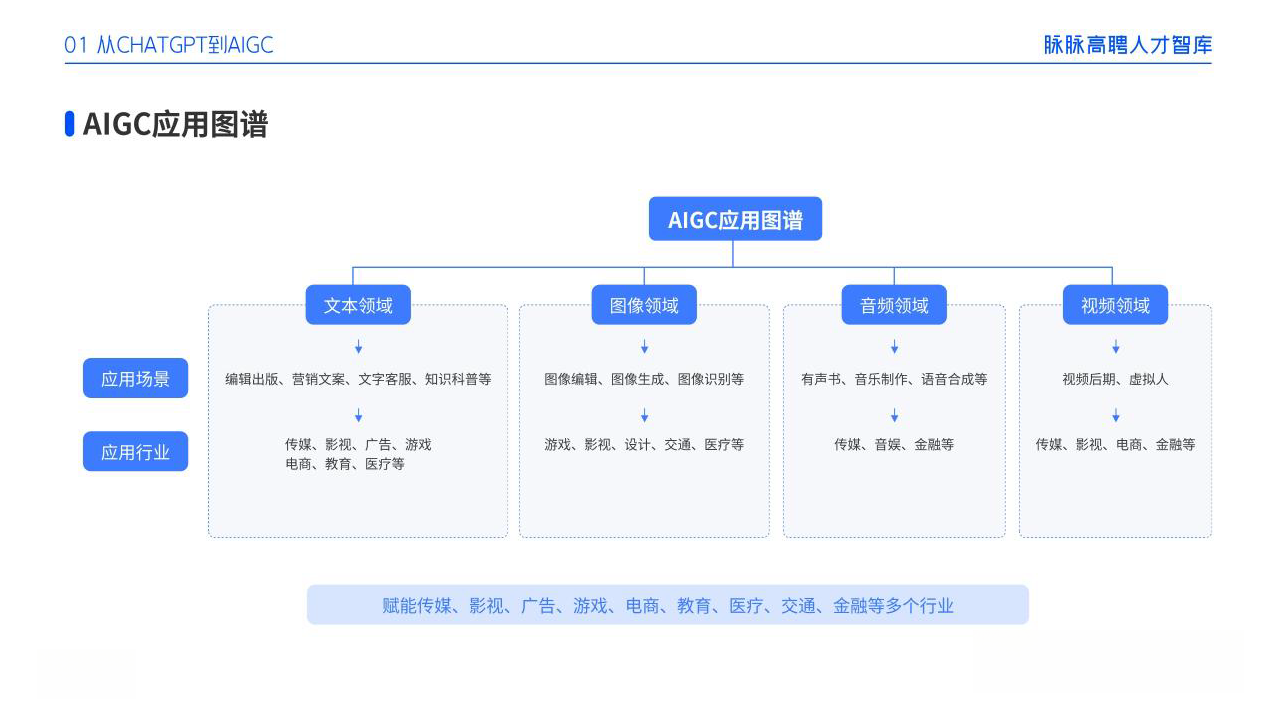

aigc技术的未来发展前景广阔,随着人工智能技术的不断发展,aigc技术也将不断提高。未来,aigc技术将在游戏和计算领域得到更广泛的应用,使游戏和计算系统具有更高效、更智能、更灵活的特性。同时,aigc技术也将与人工智能技术紧密结合,在更多的领域得到广泛应用,对程序员来说影响至关重要。未来,aigc技术将继续得到提高,同时也将与人工智能技术紧密结合,在更多的领域得到广泛应用。

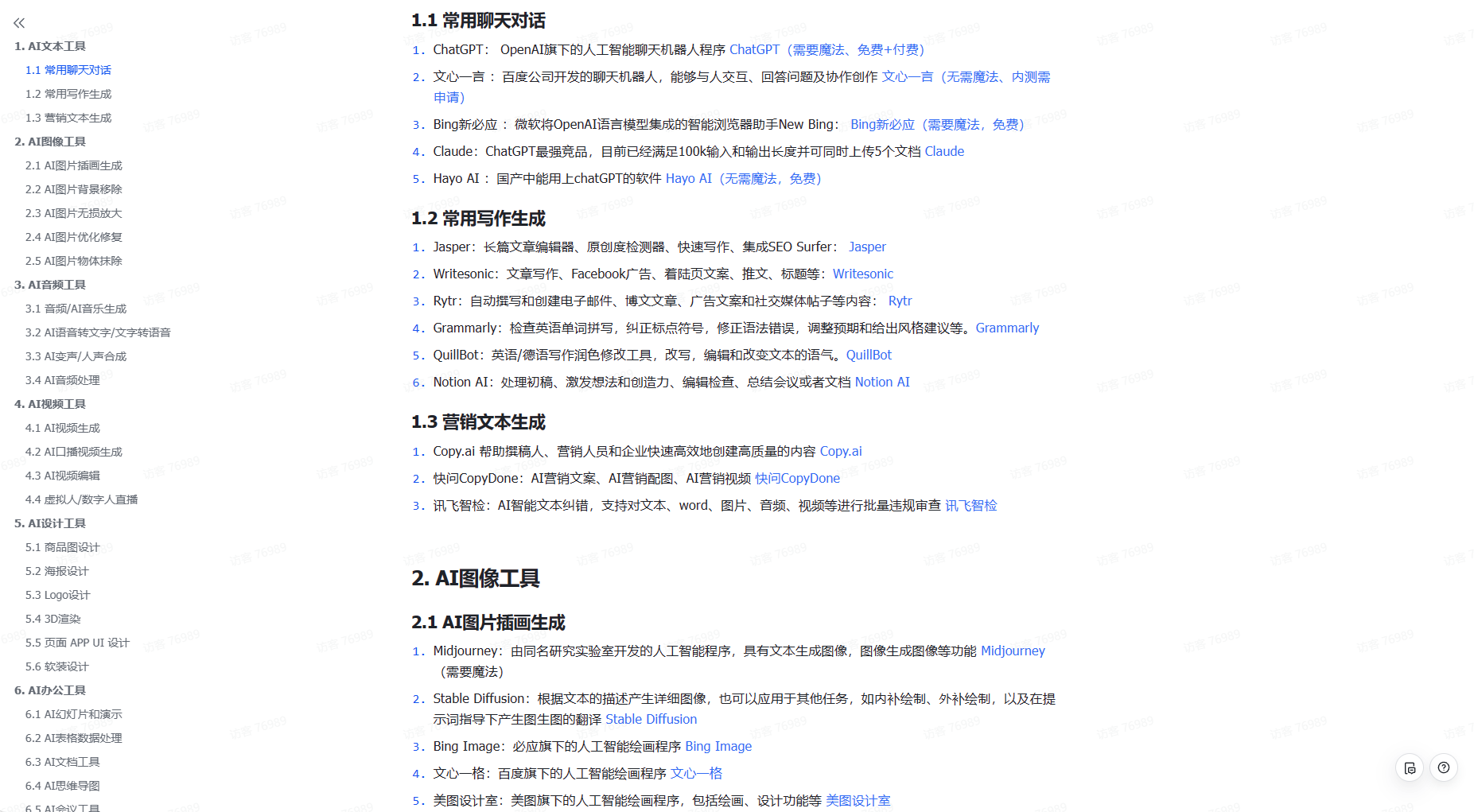

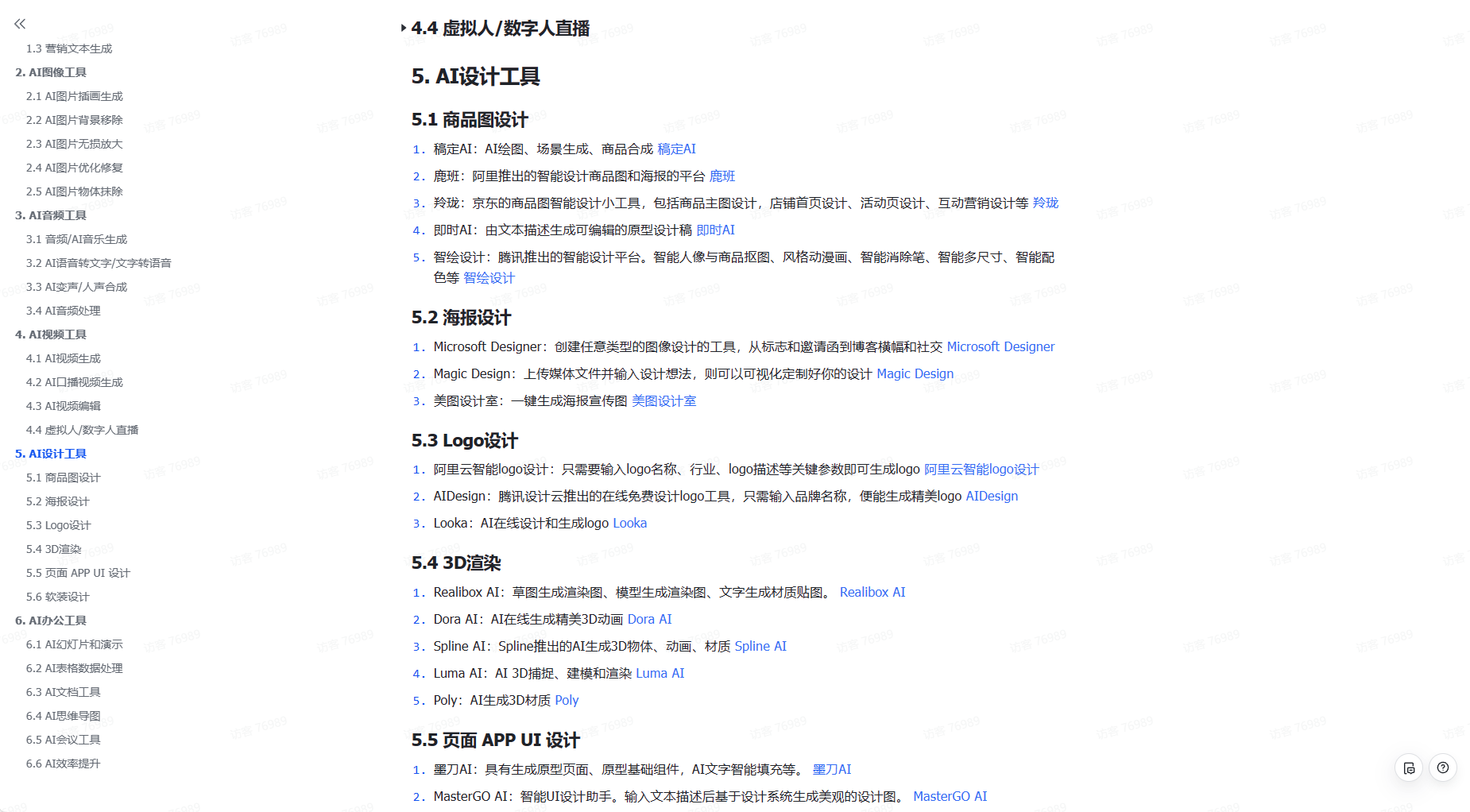

一、aigc所有方向的学习路线

aigc所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

二、aigc必备工具

工具都帮大家整理好了,安装就可直接上手!

三、最新aigc学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、aigc视频教程合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

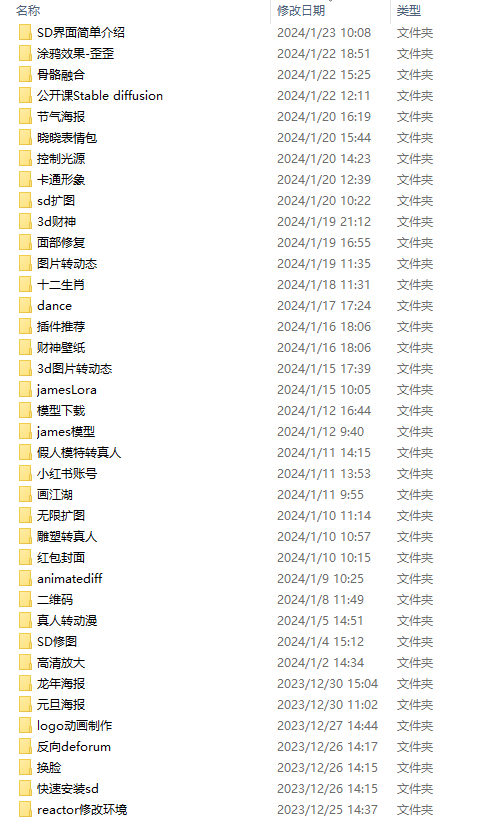

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

若有侵权,请联系删除

若有侵权,请联系删除

发表评论