python依然是ai开发的第一语言,但框架生态已经发生了翻天覆地的变化。本文精选10个2026年最值得投入学习的python ai框架,无论你是刚入门还是资深工程师,这份清单都值得收藏。

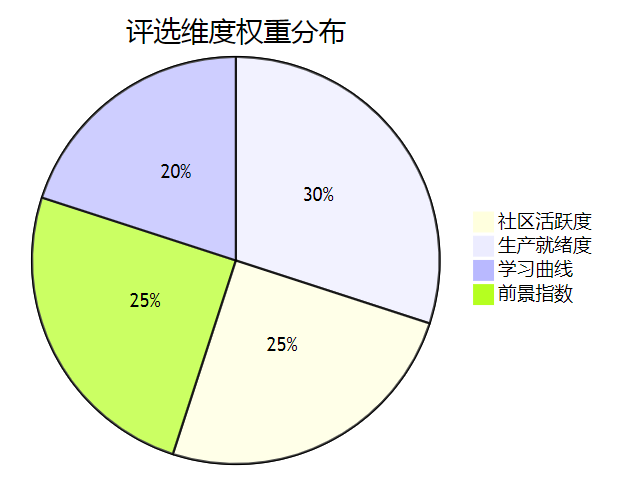

评选标准

我们从以下四个维度对框架进行综合评分:

| 维度 | 权重 | 说明 |

|---|---|---|

| 社区活跃度 | 25% | github star、contributor数量、issue响应速度 |

| 生产就绪度 | 30% | 是否有大规模生产验证、文档完善度 |

| 学习曲线 | 20% | 上手难度、教程丰富度 |

| 前景指数 | 25% | 技术趋势、企业需求增长 |

第10名:autogen — 多agent协作框架

github star:42k+ | 微软出品

autogen 是微软开源的多agent对话框架,专注于让多个ai agent协同完成任务。

import autogen

# 配置llm

config_list = [

{

"model": "gpt-4o",

"api_key": "your-api-key",

}

]

# 创建助手agent

assistant = autogen.assistantagent(

name="assistant",

llm_config={"config_list": config_list},

)

# 创建用户代理

user_proxy = autogen.userproxyagent(

name="user_proxy",

human_input_mode="terminate",

code_execution_config={

"work_dir": "coding",

"use_docker": false,

},

)

# 发起对话

user_proxy.initiate_chat(

assistant,

message="请用python写一个爬虫,抓取天气数据并生成可视化图表",

)推荐理由: 多agent协作是2026年最火的ai范式之一,autogen提供了最简洁的实现方式。

适合人群: 需要构建复杂ai工作流的开发者

第9名:hugging face transformers — 模型生态之王

github star:145k+ | 行业标准

transformers 早已不只是nlp库,它现在是跨模态模型的事实标准接口。

from transformers import pipeline

# 文本情感分析

classifier = pipeline("sentiment-analysis", model="distilbert-base-uncased-finetuned-sst-2-english")

result = classifier("python is the best language for ai development!")

print(result)

# [{'label': 'positive', 'score': 0.9998}]

# 自动语音识别

transcriber = pipeline("automatic-speech-recognition", model="openai/whisper-large-v3")

text = transcriber("meeting_recording.mp3")

print(text["text"])

# 图像分类

image_classifier = pipeline("image-classification", model="google/vit-base-patch16-224")

result = image_classifier("https://huggingface.co/datasets/huggingface/documentation-images/resolve/main/pipeline-cat-chonkie.jpeg")

print(result)

推荐理由: 拥有最大的预训练模型生态,一条命令就能调用最前沿的模型。

适合人群: 所有ai开发者

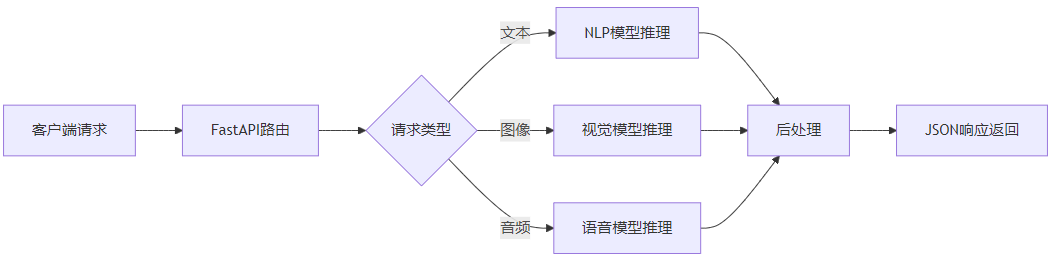

第8名:fastapi — ai模型部署首选

github star:82k+ | 生产级web框架

虽然fastapi本身不是ai框架,但它是将ai模型部署为api服务的最佳选择。

from fastapi import fastapi, file, uploadfile

from pydantic import basemodel

import uvicorn

app = fastapi(title="ai model serving api")

class textrequest(basemodel):

text: str

max_length: int = 512

class predictionresponse(basemodel):

label: str

confidence: float

@app.post("/predict", response_model=predictionresponse)

async def predict(request: textrequest):

"""文本分类预测接口"""

# 这里接入你的模型推理逻辑

result = your_model.predict(request.text)

return predictionresponse(

label=result.label,

confidence=result.score,

)

@app.post("/predict/image")

async def predict_image(file: uploadfile = file(...)):

"""图像分类预测接口"""

contents = await file.read()

result = your_vision_model.predict(contents)

return {"label": result.label, "confidence": result.score}

if __name__ == "__main__":

uvicorn.run(app, host="0.0.0.0", port=8000)

推荐理由: 异步高性能、自动生成api文档、类型安全,部署ai模型的不二之选。

第7名:spacy 4.0 — 工业级nlp流水线

github star:31k+ | nlp工程化标杆

spacy 4.0 全面拥抱了大模型时代,在保持高性能的同时增加了llm集成能力。

import spacy

# 加载中文模型

nlp = spacy.load("zh_core_web_trf")

text = "苹果公司在2026年发布了全新的m5芯片,性能提升了50%"

doc = nlp(text)

# 命名实体识别

for ent in doc.ents:

print(f"实体: {ent.text:<15} 标签: {ent.label_}")

# 实体: 苹果公司 标签: org

# 实体: 2026年 标签: date

# 实体: m5芯片 标签: product

# 实体: 50% 标签: percent

# 依存句法分析

for token in doc:

print(f"{token.text:<8} {token.pos_:<10} {token.dep_:<12} {token.head.text}")

推荐理由: 生产环境中处理nlp任务的首选,速度比transformers快100倍。

第6名:crewai — 企业级agent编排

github star:28k+ | agent框架新星

crewai 用"团队协作"的隐喻来编排ai agent,特别适合企业场景。

from crewai import agent, task, crew, process

from crewai.llm import llm

llm = llm(model="gpt-4o", api_key="your-api-key")

# 定义研究员agent

researcher = agent(

role="高级市场研究员",

goal="深入分析ai行业趋势,发现投资机会",

backstory="你是一位拥有10年经验的科技行业分析师",

llm=llm,

verbose=true,

)

# 定义撰稿人agent

writer = agent(

role="技术撰稿人",

goal="将研究结果转化为易懂的分析报告",

backstory="你擅长将复杂技术概念转化为商业语言",

llm=llm,

verbose=true,

)

# 定义任务

research_task = task(

description="分析2026年ai行业最热门的5个投资方向",

expected_output="一份详细的行业分析报告,包含数据支撑",

agent=researcher,

)

write_task = task(

description="基于研究结果撰写一篇面向投资人的分析简报",

expected_output="结构清晰的html格式报告",

agent=writer,

)

# 组建团队并执行

crew = crew(

agents=[researcher, writer],

tasks=[research_task, write_task],

process=process.sequential,

)

result = crew.kickoff()

print(result)

推荐理由: agent编排的天花板级框架,概念直观,适合构建复杂业务流程。

第5名:pytorch 3.0 — 深度学习基础设施

github star:88k+ | 研究与生产的统一

pytorch 3.0 进一步简化了从研究到生产的全链路,编译器优化让训练速度大幅提升。

import torch

import torch.nn as nn

from torch.compile import compile

# 定义一个简单的transformer模型

class simpletransformer(nn.module):

def __init__(self, vocab_size, d_model=256, nhead=8, num_layers=4):

super().__init__()

self.embedding = nn.embedding(vocab_size, d_model)

encoder_layer = nn.transformerencoderlayer(

d_model=d_model, nhead=nhead, batch_first=true,

)

self.transformer = nn.transformerencoder(encoder_layer, num_layers)

self.fc = nn.linear(d_model, vocab_size)

def forward(self, x):

x = self.embedding(x)

x = self.transformer(x)

return self.fc(x)

# 使用 torch.compile 加速(pytorch 3.0核心特性)

model = simpletransformer(vocab_size=50000)

compiled_model = torch.compile(model)

# 模拟训练

optimizer = torch.optim.adamw(compiled_model.parameters(), lr=3e-4)

loss_fn = nn.crossentropyloss()

for step in range(100):

inputs = torch.randint(0, 50000, (32, 128)) # batch=32, seq_len=128

targets = torch.randint(0, 50000, (32, 128))

outputs = compiled_model(inputs)

loss = loss_fn(outputs.view(-1, 50000), targets.view(-1))

loss.backward()

optimizer.step()

optimizer.zero_grad()

if step % 20 == 0:

print(f"step {step}: loss = {loss.item():.4f}")

推荐理由: 深度学习的基石,pytorch 3.0的编译优化让训练效率提升显著。

第4名:scikit-learn 2.0 — 传统ml依然强大

github star:62k+ | 机器学习瑞士军刀

别以为大模型时代传统ml就过时了。scikit-learn 2.0 带来了更好的pipeline和集成学习能力。

from sklearn.datasets import fetch_california_housing

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import standardscaler

from sklearn.ensemble import gradientboostingregressor

from sklearn.pipeline import pipeline

from sklearn.metrics import mean_squared_error, r2_score

import numpy as np

# 加载数据

x, y = fetch_california_housing(return_x_y=true)

x_train, x_test, y_train, y_test = train_test_split(

x, y, test_size=0.2, random_state=42,

)

# 构建pipeline

pipeline = pipeline([

("scaler", standardscaler()),

("model", gradientboostingregressor(

n_estimators=300,

max_depth=6,

learning_rate=0.05,

random_state=42,

)),

])

# 训练与评估

pipeline.fit(x_train, y_train)

y_pred = pipeline.predict(x_test)

rmse = np.sqrt(mean_squared_error(y_test, y_pred))

r2 = r2_score(y_test, y_pred)

print(f"rmse: {rmse:.4f}")

print(f"r² score: {r2:.4f}")

推荐理由: 结构化数据的王者,80%的企业ai场景仍然靠它。

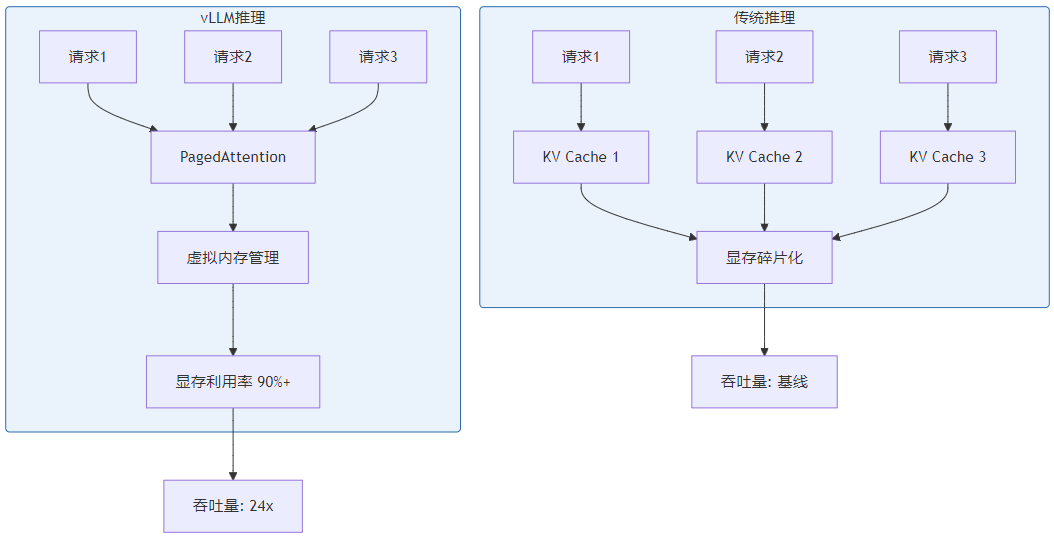

第3名:vllm — 高性能模型推理引擎

github star:38k+ | 推理部署之王

vllm 是目前最流行的llm推理加速框架,pagedattention技术让吞吐量提升24倍。

from vllm import llm, samplingparams

# 加载模型

llm = llm(

model="qwen/qwen2.5-72b-instruct",

tensor_parallel_size=4, # 4卡并行

gpu_memory_utilization=0.90, # gpu显存利用率

max_model_len=8192,

)

# 配置采样参数

sampling_params = samplingparams(

temperature=0.7,

top_p=0.9,

max_tokens=2048,

)

# 批量推理(vllm的核心优势)

prompts = [

"请用python实现一个高效的lru缓存",

"解释transformer中多头注意力机制的工作原理",

"对比rag和微调两种方案,给出选择建议",

]

outputs = llm.generate(prompts, sampling_params)

for output in outputs:

prompt = output.prompt

generated = output.outputs[0].text

print(f"prompt: {prompt[:30]}...")

print(f"response: {generated[:200]}...\n")

推荐理由: 生产环境部署大模型的标配,性能遥遥领先。

第2名:langchain — ai应用开发框架

github star:105k+ | ai应用开发的事实标准

langchain 在2026年已经进化为一个成熟的ai应用开发平台,lcel表达式让链式调用优雅且可观测。

from langchain_openai import chatopenai

from langchain_core.prompts import chatprompttemplate

from langchain_core.output_parsers import stroutputparser

from langchain_community.tools import duckduckgosearchrun

from langchain_core.runnables import runnablepassthrough

# 初始化模型和工具

llm = chatopenai(model="gpt-4o", temperature=0)

search = duckduckgosearchrun()

# 使用lcel构建链

prompt = chatprompttemplate.from_messages([

("system", "你是一个专业的技术顾问,基于搜索结果回答问题。"),

("human", "{query}\n\n搜索结果:{search_result}"),

])

chain = (

{

"query": runnablepassthrough(),

"search_result": lambda x: search.invoke(x),

}

| prompt

| llm

| stroutputparser()

)

# 执行链

answer = chain.invoke("2026年python有哪些新的ai框架值得学习?")

print(answer)

推荐理由: 生态最完整的ai应用框架,从原型到生产的全链路支持。

第1名:出乎意料 — numpy 3.0

github star:29k+ | 万物之源

没错,第一名是numpy!2026年,numpy 3.0 带来了革命性的更新,它不再只是"那个做数组运算的库"。

为什么是numpy?

numpy 3.0 的三大杀手锏:

1. 原生gpu加速

import numpy as np

# numpy 3.0: 无需修改代码即可gpu加速

a = np.array([1.0, 2.0, 3.0, 4.0] * 1_000_000, device="cuda")

b = np.array([5.0, 6.0, 7.0, 8.0] * 1_000_000, device="cuda")

# 自动在gpu上执行

c = np.dot(a.reshape(-1, 4), b.reshape(4, -1))

print(f"device: {c.device}") # cuda:0

2. 自动微分支持

import numpy as np

# numpy 3.0: 内置自动微分

def loss_fn(w, x, y):

pred = np.dot(x, w)

return np.mean((pred - y) ** 2)

# 前向传播

x = np.random.randn(100, 10)

y = np.random.randn(100)

w = np.zeros(10)

# 自动求导

grad = np.grad(loss_fn)(w, x, y)

w -= 0.01 * grad

3. 与ml生态深度集成

import numpy as np # numpy 3.0: 直接转换为pytorch tensor / jax array(零拷贝) arr = np.ones((3, 3)) import torch tensor = torch.from_numpy(arr) # 零拷贝共享内存 # 支持新的dtype: bfloat16, float8 bf16_array = np.array([1.0, 2.0], dtype=np.bfloat16) fp8_array = np.array([1.0, 2.0], dtype=np.float8_e4m3fn)

为什么出乎意料但实至名归?

每一个ai框架的底层都离不开numpy。2026年,numpy 3.0 通过gpu加速、自动微分、零拷贝互操作三大更新,让这个"最基础的库"重新成为焦点。它不需要你额外学习——因为你本来就在用。

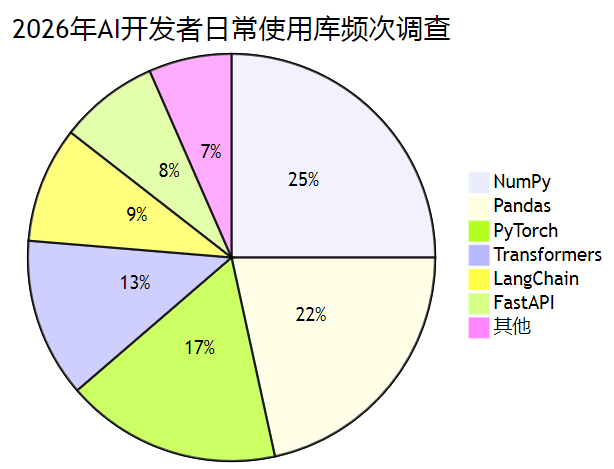

总结对比

| 排名 | 框架 | 核心场景 | 学习建议 |

|---|---|---|---|

| 1 | numpy 3.0 | 数值计算基础 | 必学,其他框架的基石 |

| 2 | langchain | ai应用开发 | 想做ai产品必学 |

| 3 | vllm | 模型推理部署 | 后端/devops工程师重点学 |

| 4 | scikit-learn 2.0 | 传统ml任务 | 数据分析师/机器学习入门 |

| 5 | pytorch 3.0 | 深度学习训练 | 算法工程师/研究员必学 |

| 6 | crewai | agent编排 | 企业ai应用开发者 |

| 7 | spacy 4.0 | 工业级nlp | nlp工程师 |

| 8 | fastapi | 模型服务部署 | 全栈ai工程师 |

| 9 | transformers | 模型调用 | 所有ai开发者 |

| 10 | autogen | 多agent协作 | ai工作流开发者 |

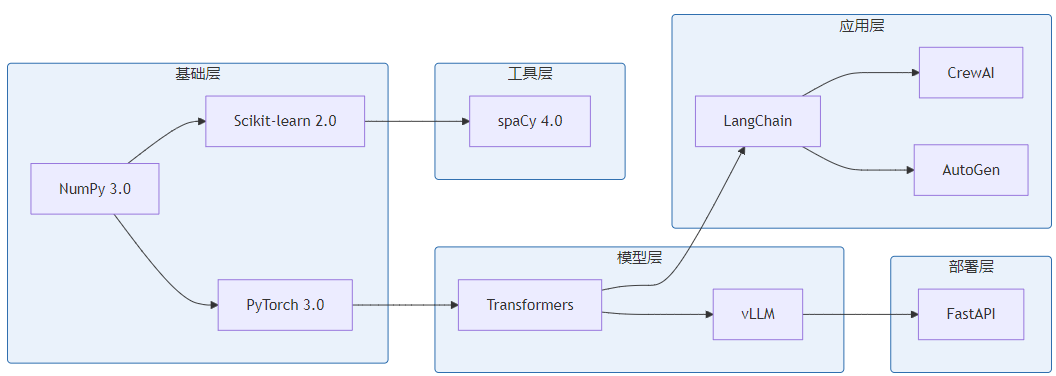

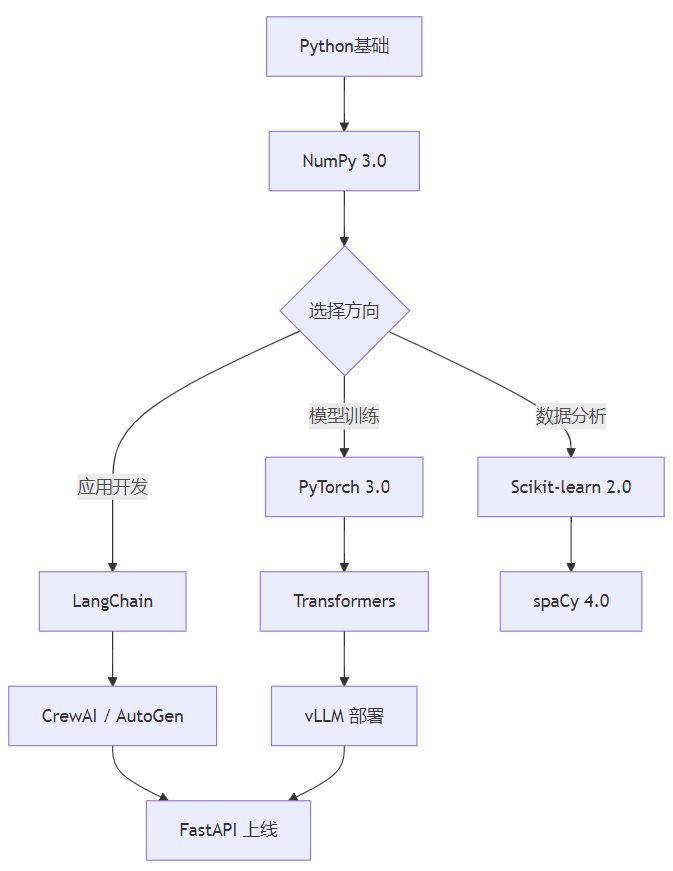

学习路线建议

以上就是2026年最值得学习的10个python ai框架。记住:工具在变,但扎实的基础永远不会过时。先学好numpy和pytorch,再根据方向深入上层框架,这是最高效的学习路径。

到此这篇关于2026年最值得投入学习的pythonai框架top10排行榜的文章就介绍到这了,更多相关2026年排名前十的pythonai框架内容请搜索代码网以前的文章或继续浏览下面的相关文章希望大家以后多多支持代码网!

发表评论