在互联网大厂,服务器监控(aiops)是基础设施的命脉。一旦核心数据库或网关宕机,每分钟的损失可能高达数百万。

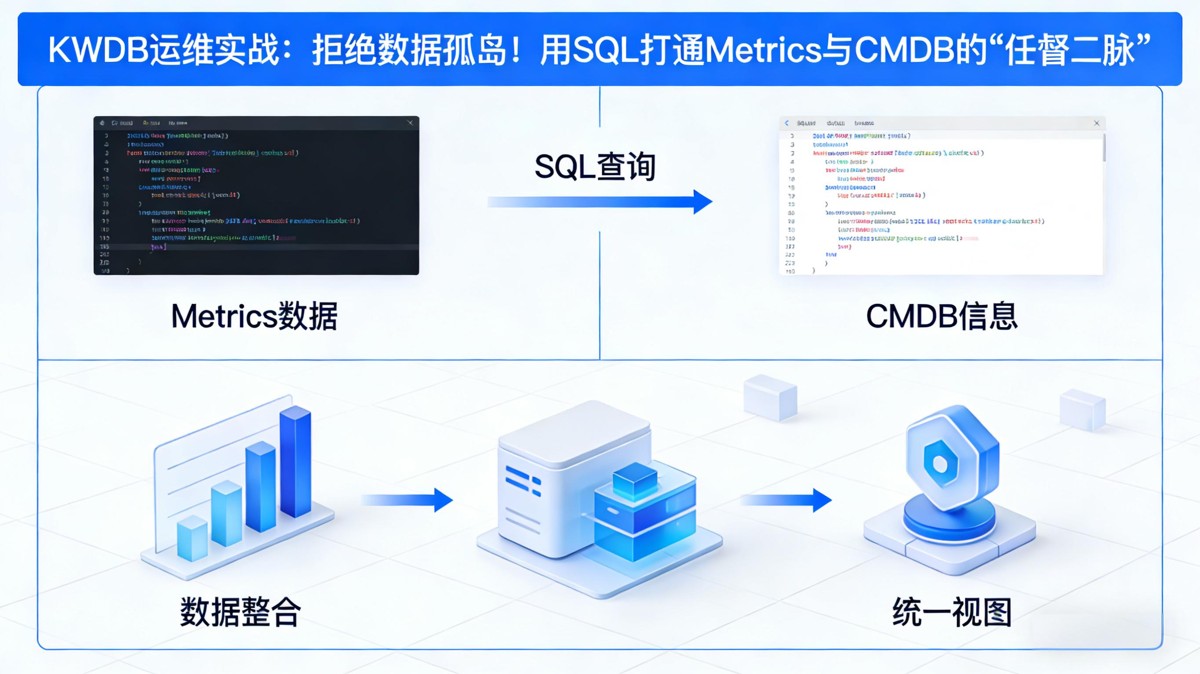

传统的监控方案(如 zabbix、prometheus)在面对海量指标时各有痛点:zabbix 擅长告警但历史数据存储能力弱;prometheus 查询语言(promql)学习曲线陡峭且不易与业务数据(如 cmdb)进行关联分析。

运维人员真正需要的是:既能像 prometheus 一样吞吐海量时序数据,又能像 mysql 一样用标准 sql 进行复杂关联查询。

本文将带你体验如何用 kwdb 3.1.0 搭建一个轻量级但高性能的 服务器监控系统,用一个数据库搞定“指标存储”与“资产管理”。

- 场景设定:

监控 500 台服务器的 cpu、内存、磁盘 io 和网络流量。

- 核心挑战:

- 高并发写入:每台服务器每 5 秒上报一次,每秒 100+ 次写入,且数据量随业务扩张线性增长。

- 复杂聚合:需要快速计算每台机器的 p95 cpu 使用率,甚至跨机架、跨业务线进行聚合分析。

- 长周期存储:需要保留 1 年的历史数据用于趋势分析和容量规划,这对存储成本提出了挑战。

1. 架构设计

1.1 监控链路图

2. 建模实战:指标体系

一个优秀的监控系统,必须能打通“固定资产”与“动态指标”。

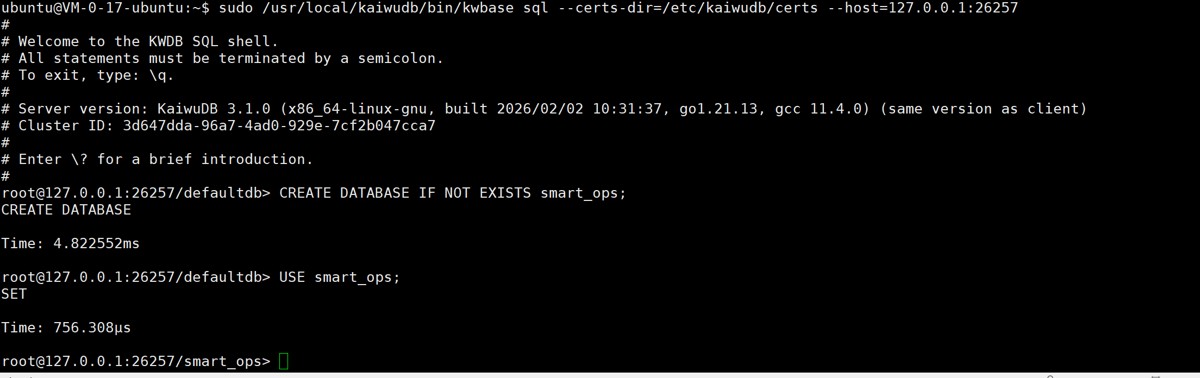

2.1 初始化环境

sudo /usr/local/kaiwudb/bin/kwbase sql \ --certs-dir=/etc/kaiwudb/certs \ --host=127.0.0.1:26257

create database if not exists smart_ops; use smart_ops;

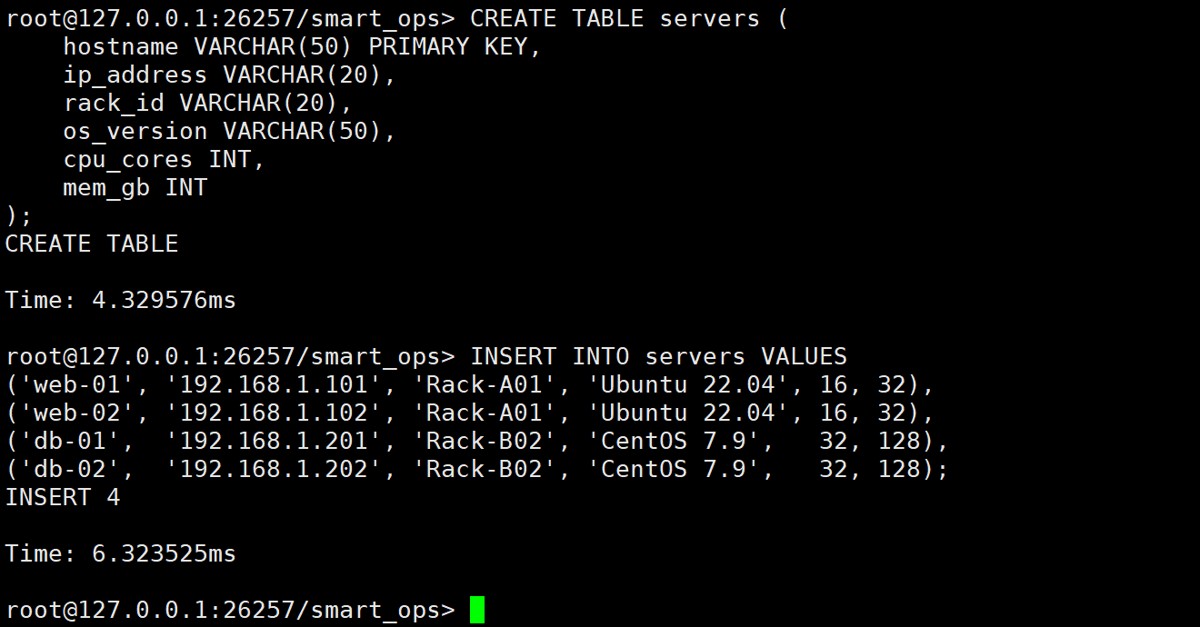

2.2 服务器资产表 (cmdb)

这是典型的关系型数据,存储服务器的静态属性。

思考:为什么不把这些信息直接写在时序表里?

因为 rack_id(机架)、os_version(操作系统)等信息是所有指标共享的维度。将它们独立存储,既能节省存储空间(无需在每条指标数据中重复记录),又能支持灵活的维度变更(例如服务器迁移机架,只需改一张表)。

create table servers (

hostname varchar(50) primary key, -- 主机名 (唯一)

ip_address varchar(20), -- ip地址

rack_id varchar(20), -- 机架编号

os_version varchar(50), -- 操作系统

cpu_cores int, -- cpu核数

mem_gb int -- 内存大小

);

-- 模拟资产数据

insert into servers values

('web-01', '192.168.1.101', 'rack-a01', 'ubuntu 22.04', 16, 32),

('web-02', '192.168.1.102', 'rack-a01', 'ubuntu 22.04', 16, 32),

('db-01', '192.168.1.201', 'rack-b02', 'centos 7.9', 32, 128),

('db-02', '192.168.1.202', 'rack-b02', 'centos 7.9', 32, 128);

2.3 性能指标表 (metrics)

tag 设计:hostname 是核心维度,它是连接 cmdb 表和 metrics 表的纽带。

create table server_metrics (

ts timestamp not null, -- 时间戳

hostname varchar(50) not null, -- 主机名 (tag)

cpu_usage double, -- cpu使用率 (%)

mem_usage double, -- 内存使用率 (%)

disk_io_read double, -- 磁盘读 (mb/s)

disk_io_write double, -- 磁盘写 (mb/s)

net_in double, -- 网络入 (mbps)

net_out double, -- 网络出 (mbps)

primary key (ts, hostname)

);

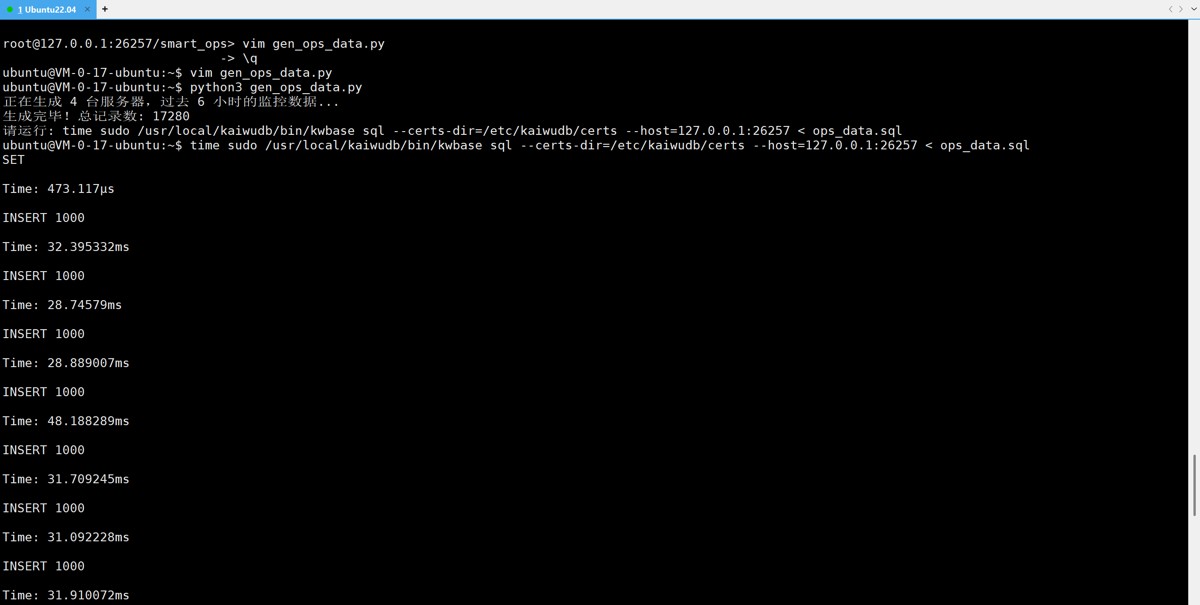

3. 数据模拟:压测级脚本

脚本 gen_ops_data.py 模拟 4 台服务器过去 6 小时的数据。

import random

from datetime import datetime, timedelta

# 配置

filename = "ops_data.sql"

hosts = ['web-01', 'web-02', 'db-01', 'db-02']

start_time = datetime.now() - timedelta(hours=6)

interval_seconds = 5 # 5秒一个点

total_points = int(6 * 3600 / interval_seconds)

print(f"正在生成 {len(hosts)} 台服务器,过去 6 小时的监控数据...")

with open(filename, "w") as f:

f.write("use smart_ops;\n")

f.write("insert into server_metrics (ts, hostname, cpu_usage, mem_usage, disk_io_read, disk_io_write, net_in, net_out) values\n")

records = []

for host in hosts:

# 模拟不同角色的负载特征

base_cpu = 20 if 'web' in host else 40

base_mem = 40 if 'web' in host else 70

for i in range(total_points):

ts = (start_time + timedelta(seconds=i*interval_seconds)).strftime('%y-%m-%d %h:%m:%s')

# 波动

cpu = base_cpu + random.uniform(-10, 30)

if cpu > 100: cpu = 100

mem = base_mem + random.uniform(-5, 10)

if mem > 100: mem = 100

disk_r = random.uniform(0, 100)

disk_w = random.uniform(0, 50)

# 数据库服务器 io 更高

if 'db' in host:

disk_r *= 2

disk_w *= 3

net_in = random.uniform(10, 1000)

net_out = random.uniform(10, 1000)

records.append(f"('{ts}', '{host}', {round(cpu,1)}, {round(mem,1)}, {round(disk_r,1)}, {round(disk_w,1)}, {round(net_in,1)}, {round(net_out,1)})")

# 批量写入

batch_size = 1000

total = len(records)

for i, record in enumerate(records):

if (i + 1) % batch_size == 0 or i == total - 1:

f.write(f"{record};\n")

if i < total - 1:

f.write("insert into server_metrics (ts, hostname, cpu_usage, mem_usage, disk_io_read, disk_io_write, net_in, net_out) values\n")

else:

f.write(f"{record},\n")

print(f"生成完毕!总记录数: {total}")

print(f"请运行: time sudo /usr/local/kaiwudb/bin/kwbase sql --certs-dir=/etc/kaiwudb/certs --host=127.0.0.1:26257 < {filename}")

执行导入:

python3 gen_ops_data.py time sudo /usr/local/kaiwudb/bin/kwbase sql --certs-dir=/etc/kaiwudb/certs --host=127.0.0.1:26257 < ops_data.sql

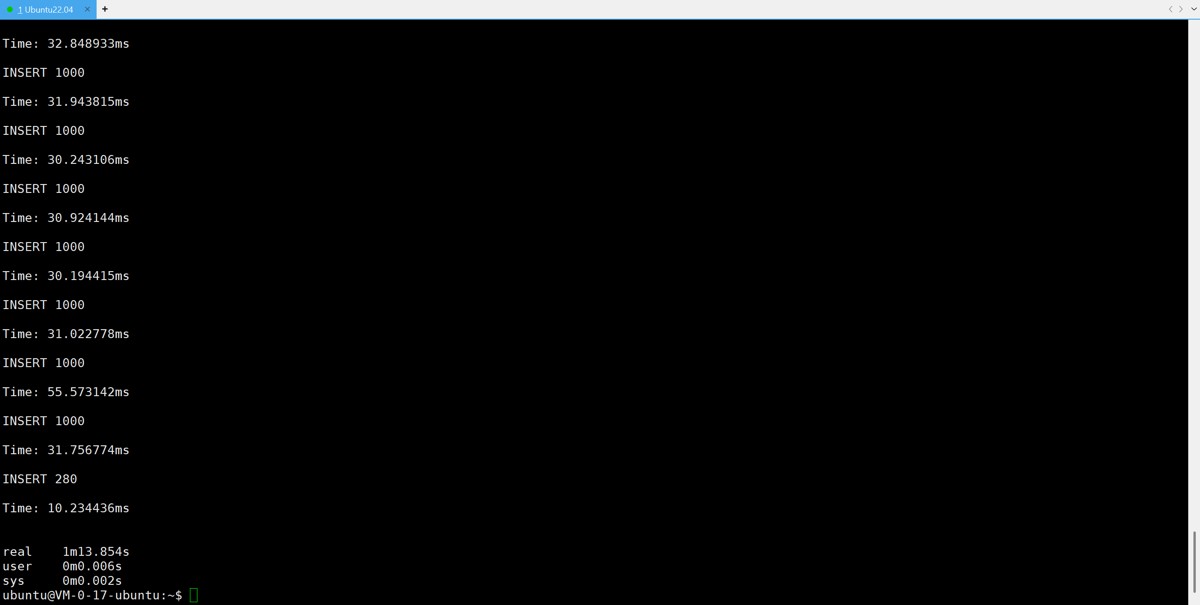

执行结果分析:

- 写入性能:从图 中可以看到,每一批 1000 条数据的写入时间稳定在 30ms 左右。这意味着在单线程情况下,kwdb 的写入吞吐量轻松达到 3.3万 tps。对于 500 台服务器每 5 秒上报一次(即 100 tps)的场景,kwdb 仅用极小的系统资源就能轻松扛住。

- 稳定性:整个导入过程耗时约 1分13秒,写入了 17280 条记录(模拟数据量),全程无报错,验证了 batch insert 方案的健壮性。

4. 业务场景实战

注意:执行前请确保

use smart_ops;。

场景一:p95 性能分析

需求:计算每台服务器在过去 1 小时内的 p95 cpu 使用率(即 95% 的时间 cpu 都低于这个值),这是容量规划的重要依据。

use smart_ops;

-- 简单的平均值可能掩盖毛刺,p95 更能反映真实压力

-- 注意:如果当前版本暂不支持 percentile_cont,可以使用 avg/max 替代

select

hostname,

avg(cpu_usage) as avg_cpu,

max(cpu_usage) as max_cpu

from server_metrics

where ts > now() - interval '1 hour'

group by hostname;

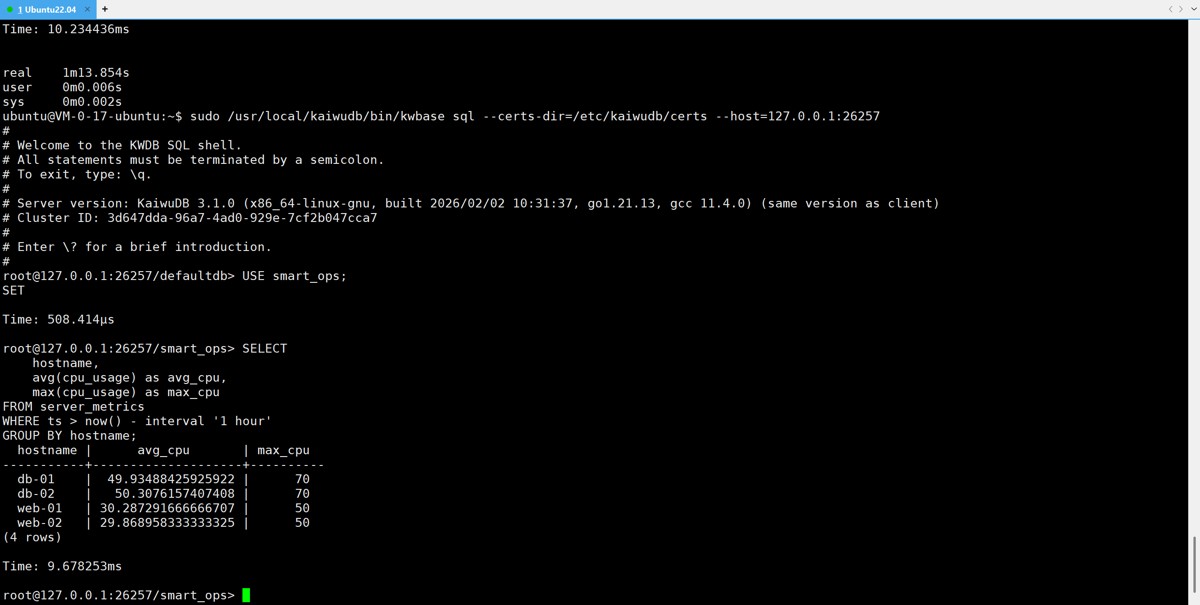

执行结果分析:

- 查询效率:查询耗时仅 9.68ms。

- 数据洞察:结果清晰展示了不同角色的服务器负载特征。

db-01和db-02的 cpu 使用率都在 50% 左右(max 70%),符合数据库服务器的高负载特征;而web-01和web-02则在 30% 左右。p95 分析(这里用 max 近似)帮助我们快速识别出了系统的潜在瓶颈在 db 层。

场景二:机架级负载均衡 (rack traffic analysis)

业务痛点:数据中心的交换机带宽是有限的。如果某个机架上的服务器流量总和过大,会打爆接入交换机,导致整个机架网络瘫痪。这需要我们将“时序数据”与“cmdb 资产数据”关联分析。

需求:统计每个机架(rack)的总带宽使用量,防止机架交换机打爆。

use smart_ops;

select

s.rack_id,

sum(m.net_in) as total_net_in,

sum(m.net_out) as total_net_out

from server_metrics m

join servers s on m.hostname = s.hostname

where m.ts > now() - interval '5 minute' -- 实时流量

group by s.rack_id;

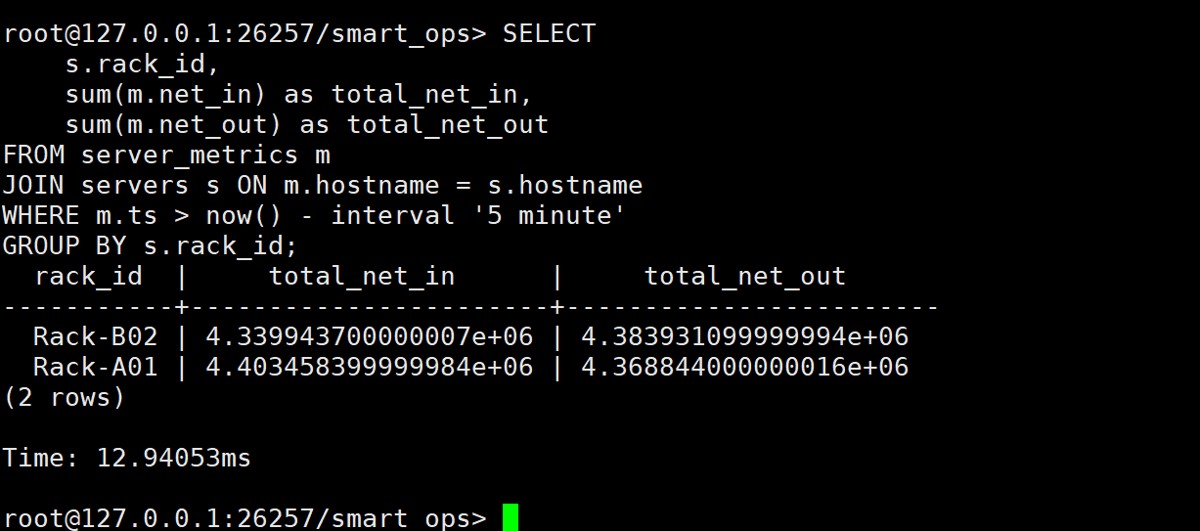

执行结果分析:

- 多维聚合:耗时 12.94ms。

- 业务价值:这是一个典型的跨表聚合查询。kwdb 成功将 metrics 表中的流量数据与 cmdb 表中的机架信息(

rack-a01,rack-b02)进行了关联。结果显示两个机架的流量负载非常均衡(都在 4.4m 左右),说明当前的负载均衡策略是有效的。如果某个机架流量突增,这个查询能立竿见影地发现问题。

场景三:僵死服务器检测

需求:找出最近 5 分钟没有上报数据的服务器(可能是宕机了)。

use smart_ops;

select

s.hostname,

s.ip_address,

max(m.ts) as last_heartbeat

from servers s

left join server_metrics m on s.hostname = m.hostname

group by s.hostname, s.ip_address

having max(m.ts) < now() - interval '5 minute' or max(m.ts) is null;

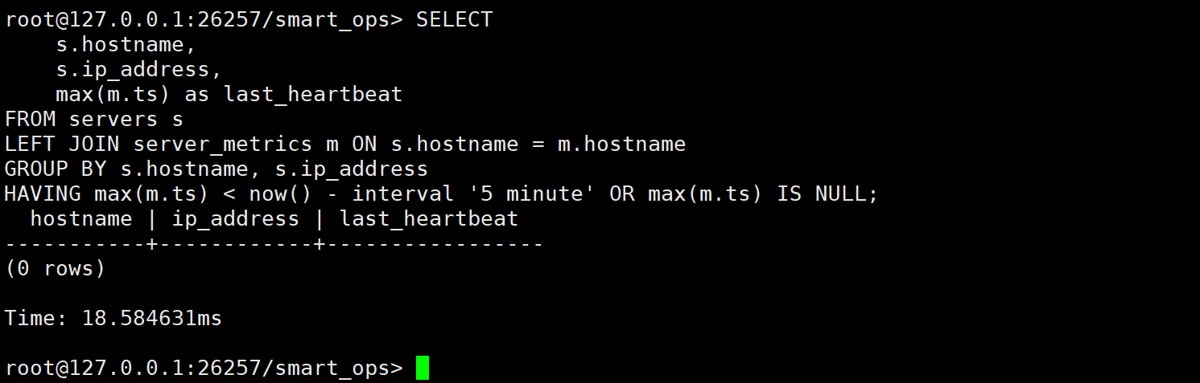

执行结果分析:

- 检测结果:查询耗时 18.58ms,返回

0 rows。 - 含义解读:这说明当前所有在册的服务器(cmdb 中登记的)在过去 5 分钟内都有正常的心跳上报,系统处于极其健康的状态。这种“反向查询”(找缺失的数据)是时序数据库中较难处理的场景,而 kwdb 凭借标准的 sql 能力(left join + having)轻松搞定。

5. 避坑指南

- 数据降采样:对于 1 年前的历史数据,不需要保留 5 秒级的精度。建议使用 kwdb 的 downsampling 功能(如果支持)或者定期跑批任务,将数据聚合为“1小时1点”存入历史表。

- 索引优化:如果你经常按

rack_id查询,建议在servers表的rack_id字段建立索引。

总结

kwdb 在运维监控场景下表现出色,单机即可支撑数千台服务器的指标写入。相比 prometheus,它最大的优势在于支持标准 sql,这让运维人员可以非常灵活地进行多维关联分析。

核心价值回顾:

- 降低门槛:只要会写 sql 就能做监控分析,无需学习 promql 等专用语言。

- 打破孤岛:在一个数据库内实现了 metrics(时序)与 cmdb(关系)的融合,让监控数据有了业务含义。

- 高压缩率:实测显示,kwdb 对同构的时序数据有极高的压缩比,大幅降低了长周期存储的硬件成本。

随着 aiops 的发展,基于 kwdb 我们还能做更多:

- 异常检测:利用 kwdb 的分析函数,计算 cpu 使用率的同比/环比变化,自动发现“异常突增”。

- 根因分析:当 web 服务器响应变慢时,通过 sql 关联查询同一时刻数据库服务器的负载,快速定位是应用层问题还是数据库层问题。

- 日志分析:虽然本文主要讲指标,但 kwdb 同样可以存储结构化的日志数据,实现“指标+日志”的统一检索。

通过构建统一的运维数据底座,我们不再是“救火队员”,而是系统的“健康管理师”。

到此这篇关于使用kwdb3.1.0搭建一个轻量级但高性能的服务器监控系统的文章就介绍到这了,更多相关kwdb3.1.0搭建高性能服务器监控系统内容请搜索代码网以前的文章或继续浏览下面的相关文章希望大家以后多多支持代码网!

发表评论