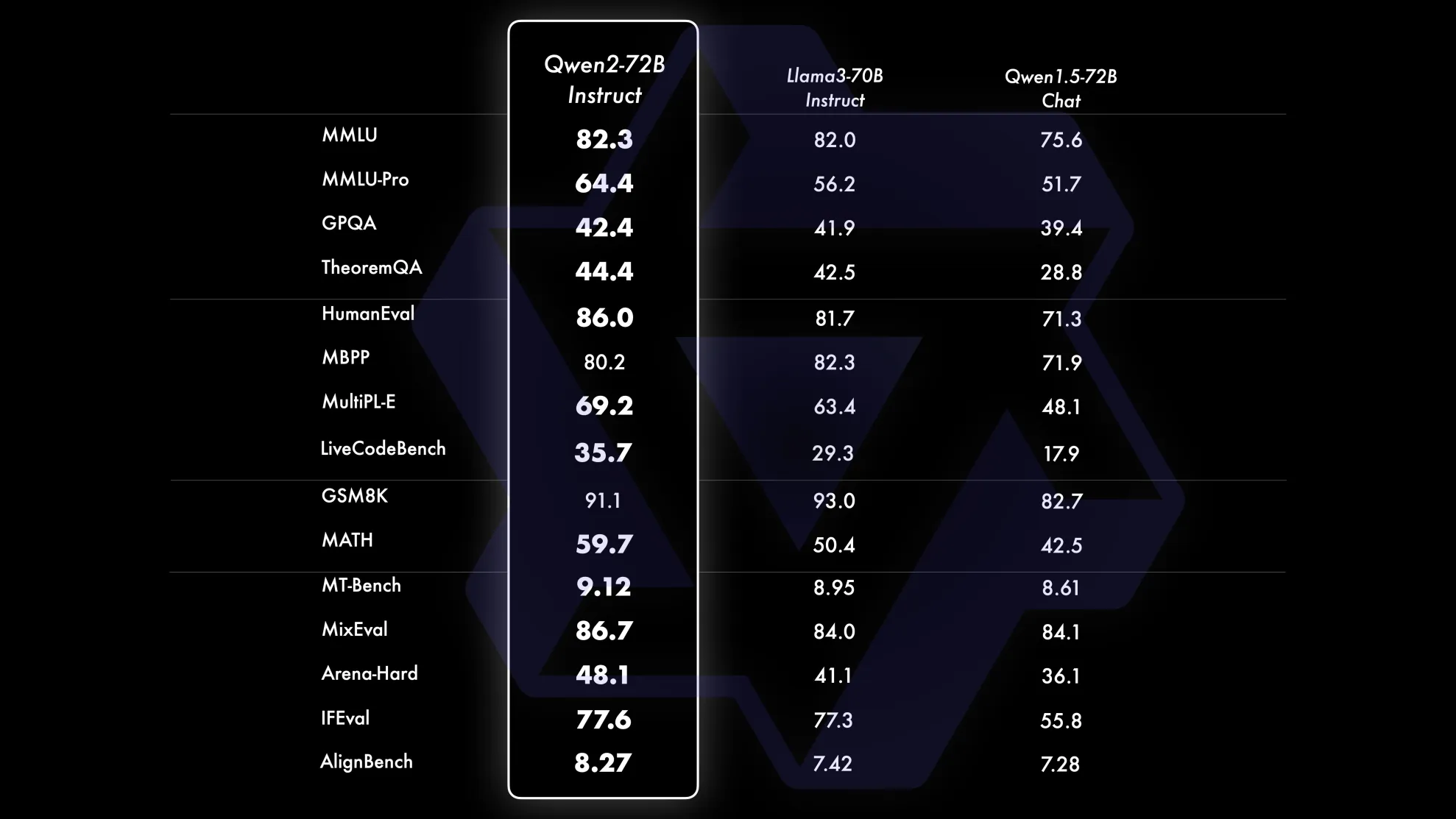

阿里巴巴通义千问团队发布了qwen2系列开源模型,该系列模型包括5个尺寸的预训练和指令微调模型:qwen2-0.5b、qwen2-1.5b、qwen2-7b、qwen2-57b-a14b以及qwen2-72b。对比当前最优的开源模型,qwen2-72b在包括自然语言理解、知识、代码、数学及多语言等多项能力上均显著超越当前领先的llama3-70b等大模型。

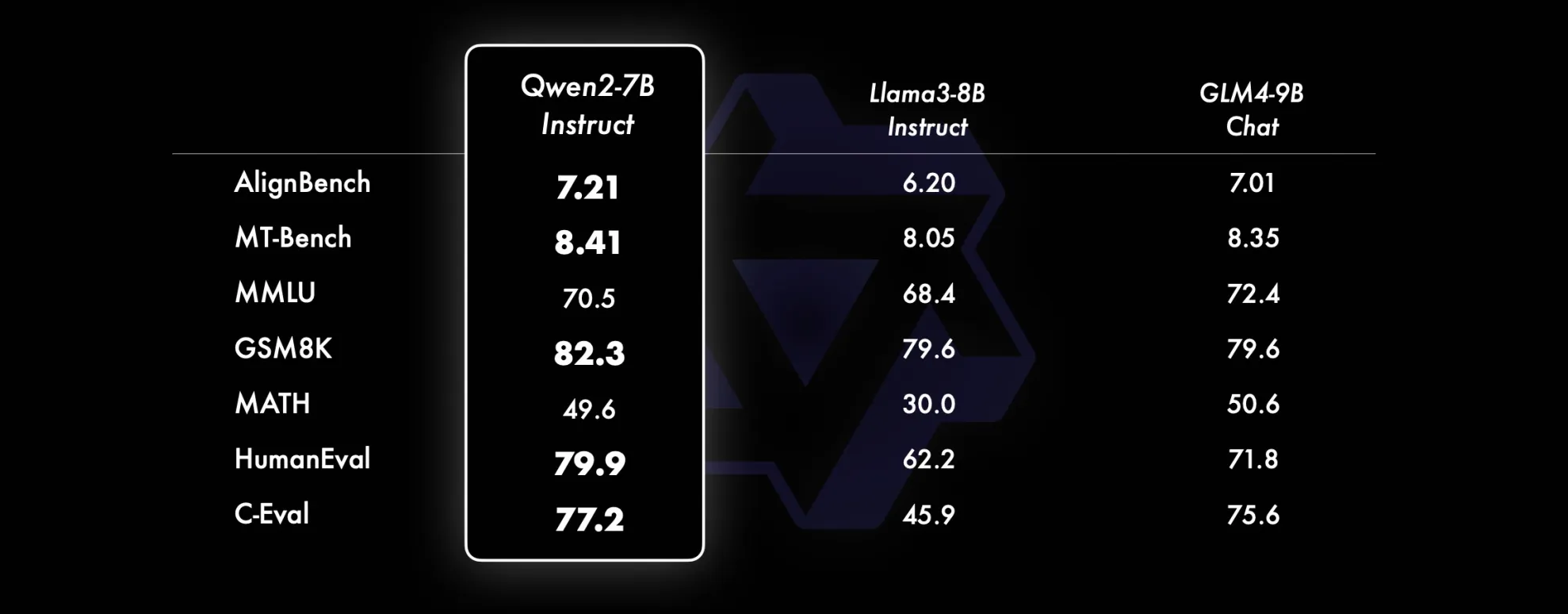

老牛同学今天部署和体验qwen2-7b-instruct指令微调的中等尺寸模型,相比近期推出同等规模的开源最好的llama3-8b、glm4-9b等模型,qwen2-7b-instruct依然能在多个评测上取得显著的优势,尤其是代码及中文理解上。

特别注意: 虽然qwen2开源了,但仍然需要遵循其模型许可,除qwen2-72b依旧使用此前的qianwen license外,其余系列版本模型,包括qwen2-0.5b、qwen2-1.5b、qwen2-7b以及qwen2-57b-a14b等在内,均采用apache 2.0许可协议。

下载qwen2-7b-instruct模型文件

为了简化模型的部署过程,我们直接下载gguf文件。关于gguf文件介绍,请详见部署llama3-8b大模型的文章:玩转ai,笔记本电脑安装属于自己的llama 3 8b大模型和对话客户端

打开qwen2-7b-instruct-gguf模型文件列表(https://modelscope.cn/models/qwen/qwen2-7b-instruct-gguf/files),我们选择qwen2-7b-instruct-q5_k_m.gguf并下载:

我们可以根据自己需要,选择下载其它版本的模型文件!

启动qwen2-7b-instruct大模型

gguf模型量化文件下载完成后,我们就可以来运行qwen2-7b大模型了。

在启动qwen2-7b大模型之前,我们首先需要安装python依赖包列表:

pip install llama-cpp-python

pip install openai

pip install uvicorn

pip install starlette

pip install fastapi

pip install sse_starlette

pip install starlette_context

pip install pydantic_settings

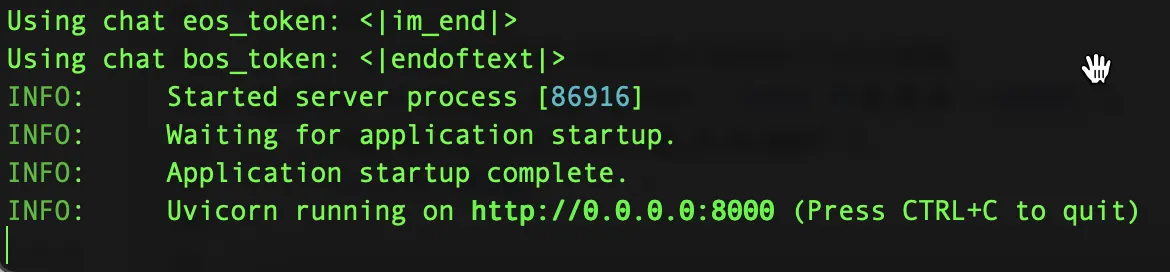

然后打开一个terminal终端窗口,切换到gguf模型文件目录,启动qwen2-7b大模型(./qwen2-7b-instruct-q5_k_m.gguf即为上一步下载的模型文件路径):

# 启动qwen2大模型

# n_ctx=20480代表单次回话最大20480个token数量

python -m llama_cpp.server \

--host 0.0.0.0 \

--model ./qwen2-7b-instruct-q5_k_m.gguf \

--n_ctx 20480

qwen2-7b-instruct 命令行对话客户端

cli命令行的客户端,可以参考之前llama3-8b大模型的文章:https://mp.weixin.qq.com/s/mekcujdhkzuunoykkgoh2g

# client.py

from openai import openai

# 注意服务端端口,因为是本地,所以不需要api_key

client = openai(base_url="http://127.0.0.1:8000/v1",

api_key="not-needed")

# 对话历史:设定系统角色是一个只能助理,同时提交“自我介绍”问题

history = [

{"role": "system", "content": "你是一个智能助理,你的回答总是容易理解的、正确的、有用的和内容非常精简."},

]

# 首次自我介绍完毕,接下来是等代码我们的提示

while true:

completion = client.chat.completions.create(

model="local-model",

messages=history,

temperature=0.7,

stream=true,

)

new_message = {"role": "assistant", "content": ""}

for chunk in completion:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="", flush=true)

new_message["content"] += chunk.choices[0].delta.content

history.append(new_message)

print("\033[91;1m")

user_input = input("> ")

if user_input.lower() in ["bye", "quit", "exit"]: # 我们输入bye/quit/exit等均退出客户端

print("\033[0mbye bye!")

break

history.append({"role": "user", "content": user_input})

print("\033[92;1m")

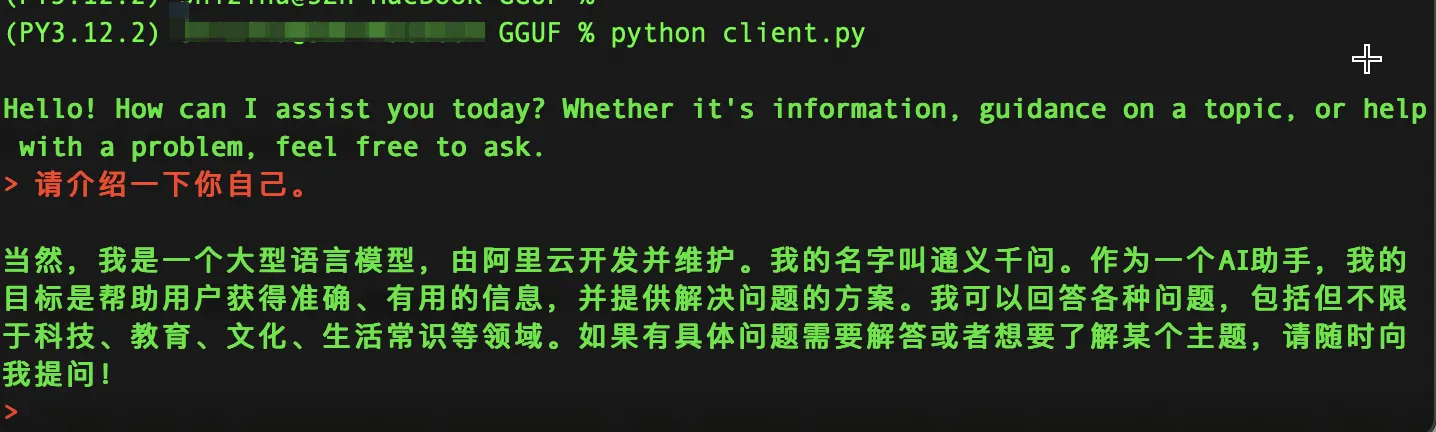

启动cli对话客户端:python client.py

至此,我们可以与qwen2-7b-instruct进行对话,体验qwen2大模型的魅力了。

如果我们主要是通过api的方式使用qwen2大模型,那么qwen2部署就到此结束了。

接下来的章节,我们部署webui对话客户端,通过web界面的方式使用qwen2大模型,并且可以分享出去~

qwen2-7b-instruct webui客户端

结合ollama工具,搭建webui客户端,可参考之前llama3-8b大模型的文章:一文彻底整明白,基于ollama工具的llm大语言模型web可视化对话机器人部署指南

第一步: 我们需要下载安装ollama本地大模型管理工具:

ollama提供了macos、linux和windows操作系统的安装包,大家可根据自己的操作系统,下载安装即可:

安装包下载之后的安装过程,和日常安装其他软件没有差别,包括点击next以及install等安装ollama到命令行。安装后续步骤中,我们可无需安装任何模型,因为我们在上文中我们已经安装了qwen2-7b大模型,后面可以直接使用。

第二步: 安装node.js编程语言工具包

安装node.js编程语言工具包和安装其他软件包一样,下载安装即可:https://nodejs.org

安装完成之后,可以验证一下 node.js 的版本,建议用目前的最新v20版本:

node -v

老牛同学安装的版本:v20.13.1(最新版本)

第三步: 基于gguf模型文件创建ollama模型

在我们存放qwen2-7b的 gguf 模型文件目录中,创建一个文件名为modelfile的文件,该文件的内容如下:

from ./qwen2-7b-instruct-q5_k_m.gguf

然后在terminal终端,使用这个文件创建ollama模型,这里我把ollama的模型取名为qwen2-7b:

$ ollama create qwen2-7b -f ./modelfile

transferring model data

using existing layer sha256:258dd2fa1bdf98b85327774e1fd36e2268c2a4b68eb9021d71106449ee4ba9d5

creating new layer sha256:14f4474ef69698bf4dbbc7409828341fbd85923319a801035e651d9fe6a9e9c9

writing manifest

success

最后,通过ollama启动我们刚创建的大语言模型:

ollama run qwen2-7b

启动完毕,其实我们已经有了一个和之前差不多的控制台对话界面,也可以与qwen2-7b对话了。

如果我们不想要这个模型了,也可以通过命令行删除模型文件:ollama rm qwen2-7b

我们也可以查看本地ollama管理的模型列表:ollama list

ollama存放模型文件根目录:~/.ollama

第四步: 部署ollama大模型web对话界面

控制台聊天对话界面体验总归是不太好,接下来部署 web 可视化聊天界面。

首先,下载ollama-webuiweb 工程代码:git clone https://github.com/ollama-webui/ollama-webui-lite

然后切换ollama-webui代码的目录:cd ollama-webui-lite

设置 node.js 工具包镜像源,以接下来下载 node.js 的依赖包更加快速:npm config set registry http://mirrors.cloud.tencent.com/npm/

安装 node.js 依赖的工具包:npm install

最后,启动 web 可视化界面:npm run dev

如果看到以上输出,代表 web 可视化界面已经成功了!

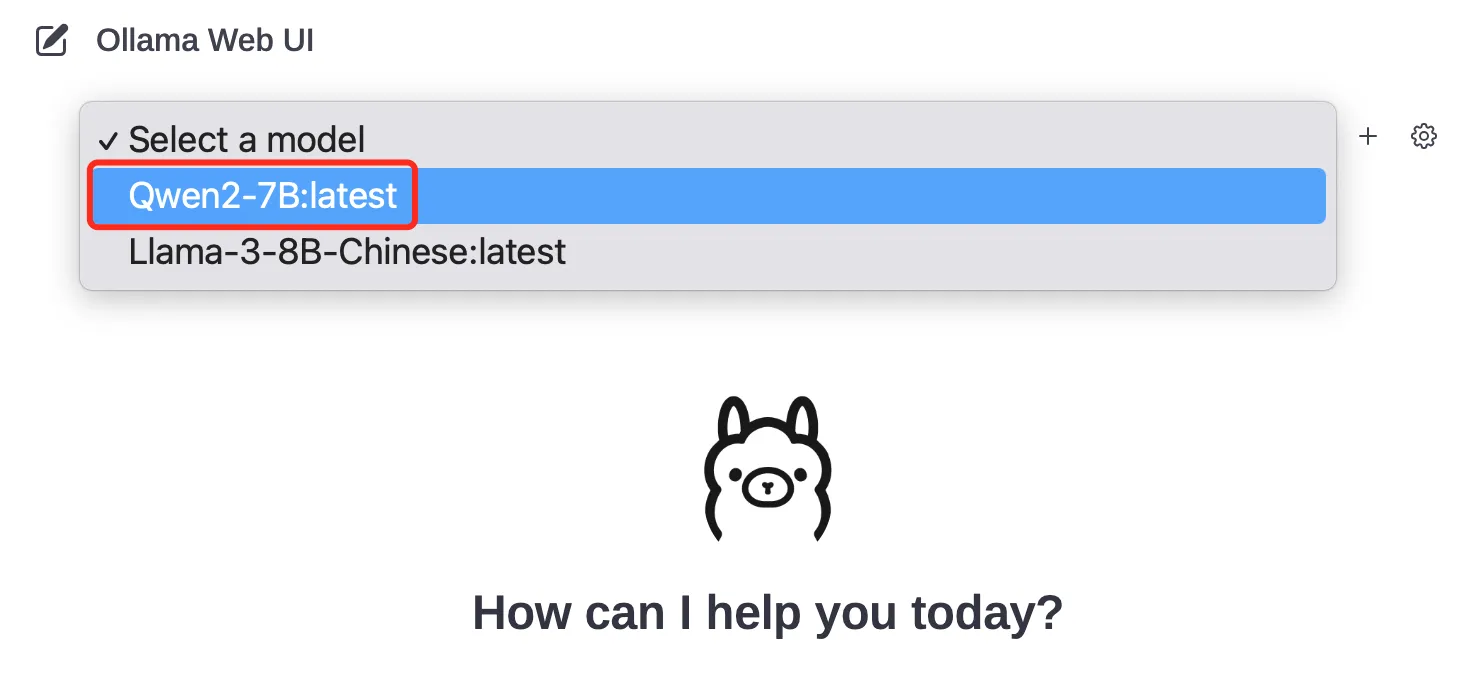

第五步: 通过webui愉快与qwen2-7b对话

浏览器打开 web 可视化界面:http://localhost:3000/

可以看到ollama的初始化页面,默认没有模型,需要选择,我们选择刚创建并部署的qwen2-7b模型:

底部就是聊天输入框,至此可以愉快的与qwen2-7b聊天对话了:

总结:qwen2-7b比llama3-8b快

老牛同学验证和对比,在文本推理上,qwen2-7b确实比llama3-8b要快很多。后续老牛同学中文文本推理相关的api接口,就主要采用更快qwen2-7b大模型了~

其他:ollama工具常用用法

从上文的介绍可以看到,基于ollama部署一个大模型的 web 可视化对话机器人,还是非常方便。下面整理了部分ollama提供的用法或者。

ollama 命令工具

# 查看当前ollama的模型

ollama list

# 增量更新当前部署的模型

ollama pull qwen2-7b

# 删除一个模型文件

ollama rm qwen2-7b

# 复制一个模型

ollama cp qwen2-7b qwen2-newmodel

ollama api结果返回

curl http://localhost:11434/api/generate -d '{

"model": "qwen2-7b",

"prompt":"为什么天空是蓝色的?"

}'

ollama api聊天对话

curl http://localhost:11434/api/chat -d '{

"model": "qwen2-7b",

"messages": [

{ "role": "user", "content": "为什么天空是蓝色的?" }

]

}'

关注本公众号,我们共同学习进步👇🏻👇🏻👇🏻

微信公众号:老牛同学

qwen2-7b 开源大模型

qwen2 阿里最强开源大模型(qwen2-7b)本地部署、api调用和webui对话机器人

llama3-8b 开源大模型

玩转 ai,笔记本电脑安装属于自己的 llama 3 8b 大模型和对话客户端

一文彻底整明白,基于 ollama 工具的 llm 大语言模型 web 可视化对话机器人部署指南

基于llama 3搭建中文版(llama3-chinese-chat)大模型对话聊天机器人

glm-4-9b 开源大模型

本地部署glm-4-9b清华智谱开源大模型方法和对话效果体验

chattts 文本转语音模型

chattts 开源文本转语音模型本地部署、api使用和搭建webui界面

大模型应用

借助ai大模型,三分钟原创一部儿童故事短视频(附完整操作步骤)

高效编写大模型 prompt 提示词,解锁 ai 无限创意潜能

python 小游戏

python游戏编程:一步步用python打造经典贪吃蛇小游戏

发表评论