pandas是一个强大的数据分析工具,广泛应用于数据清洗、处理和分析。在数据处理的过程中,经常需要读取和写入文本文件,如txt和csv。本文将介绍pandas中的read_csv和to_csv函数,详细解释其参数,并提供实例演示。

1. 读取csv文件

read_csv函数是pandas中用于读取csv文件的主要函数。以下是一些常用参数的解释:

filepath_or_buffer: 文件路径或url,指定要读取的csv文件的位置。sep: 列之间的分隔符,默认为逗号。header: 指定哪一行作为列名,默认为第一行。index_col: 指定用作行索引的列,默认为none。usecols: 选择要读取的列,可以是列名或列索引。dtype: 指定每列的数据类型。skiprows: 跳过文件开头的行数。nrows: 读取文件的前n行。

以下是一个简单的示例:

import pandas as pd

# 读取csv文件

df = pd.read_csv('example.csv')

# 打印数据框的前几行

print(df.head())

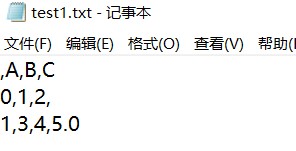

2. 读取文本文件

除了csv文件,read_csv也可以读取其他文本文件,比如txt文件。需要注意的是,参数设置可能需要根据文件格式进行调整。

import pandas as pd

# 读取txt文件,指定分隔符为制表符

df_txt = pd.read_csv('example.txt', sep='\t')

# 打印数据框的前几行

print(df_txt.head())

3. 写入csv文件

to_csv函数用于将数据框写入csv文件。以下是一些常用参数的解释:

path_or_buf: 文件路径或对象,指定要写入的文件的位置。sep: 列之间的分隔符,默认为逗号。index: 是否写入行索引,默认为true。header: 是否写入列名,默认为true。mode: 写入模式,如覆盖文件或追加数据。

以下是一个写入csv文件的示例:

import pandas as pd

# 创建一个数据框

data = {'name': ['alice', 'bob', 'charlie'],

'age': [25, 30, 35],

'city': ['new york', 'san francisco', 'los angeles']}

df_new = pd.dataframe(data)

# 将数据框写入csv文件

df_new.to_csv('new_example.csv', index=false)

4. 高级参数设置

除了上述基本参数外,read_csv和to_csv还提供了一些高级参数,用于更灵活地处理数据。

4.1read_csv高级参数

encoding: 指定文件编码,常用的有’utf-8’、'gbk’等。na_values: 指定要识别为缺失值的值。parse_dates: 将指定列解析为日期。skip_blank_lines: 是否跳过空白行,默认为true。comment: 指定注释字符,以该字符开始的行将被忽略。

import pandas as pd

# 读取csv文件,指定编码和解析日期

df_advanced = pd.read_csv('advanced_example.csv', encoding='utf-8', parse_dates=['date'])

# 打印数据框的前几行

print(df_advanced.head())

4.2to_csv高级参数

date_format: 指定日期列的输出格式。line_terminator: 指定行终止符,默认为’\n’。compression: 指定压缩格式,如’gzip’、'xz’等。decimal: 指定小数点符号。

import pandas as pd

# 创建一个包含日期的数据框

data_advanced = {'name': ['alice', 'bob', 'charlie'],

'age': [25, 30, 35],

'date': pd.to_datetime(['2022-01-01', '2022-02-01', '2022-03-01'])}

df_advanced = pd.dataframe(data_advanced)

# 将数据框写入csv文件,指定日期格式和压缩格式

df_advanced.to_csv('advanced_example.csv', index=false, date_format='%y-%m-%d', compression='gzip')

5. 处理缺失值和数据清洗

在实际数据处理中,经常会遇到缺失值和需要进行数据清洗的情况。pandas提供了一些方法来处理这些问题。

5.1 处理缺失值

read_csv和to_csv函数有一些参数可以用于处理缺失值。例如,na_values参数用于指定哪些值被识别为缺失值,而dropna参数用于删除包含缺失值的行。

import pandas as pd

# 读取csv文件,指定缺失值为-1

df_missing = pd.read_csv('missing_example.csv', na_values=-1)

# 删除包含缺失值的行

df_missing_cleaned = df_missing.dropna()

# 打印清理后的数据框

print(df_missing_cleaned)

5.2 数据清洗

数据清洗通常涉及到对数据进行过滤、替换或重命名等操作。例如,可以使用query方法进行数据过滤,或者使用replace方法替换特定值。

import pandas as pd

# 读取csv文件

df_dirty = pd.read_csv('dirty_example.csv')

# 使用query方法进行数据过滤

df_cleaned = df_dirty.query('age > 0')

# 使用replace方法替换特定值

df_cleaned['city'].replace({'nyc': 'new york city'}, inplace=true)

# 打印清理后的数据框

print(df_cleaned)

6. 异常处理与日志记录

在实际数据处理中,经常会遇到各种异常情况,例如文件不存在、文件格式错误等。为了更好地处理异常,可以使用try-except语句进行异常处理,并使用日志记录来记录异常信息,方便排查问题。

import pandas as pd

import logging

# 设置日志记录

logging.basicconfig(filename='data_processing.log', level=logging.error)

try:

# 尝试读取csv文件

df = pd.read_csv('nonexistent_file.csv')

except filenotfounderror as e:

# 处理文件不存在的异常

logging.error(f'file not found: {e}')

except pd.errors.parsererror as e:

# 处理文件格式错误的异常

logging.error(f'error parsing file: {e}')

else:

# 如果没有异常,执行正常的数据处理操作

print(df.head())

7. 数据分析与可视化

一旦成功读取和清理数据,接下来通常会进行数据分析和可视化。pandas和其它库(如matplotlib和seaborn)提供了丰富的功能来帮助进行数据探索和可视化。

7.1 数据分析

使用pandas的统计函数,可以轻松获取有关数据集的各种统计信息,例如均值、中位数、标准差等。

import pandas as pd

# 读取csv文件

df_analysis = pd.read_csv('analysis_example.csv')

# 输出数据集的统计信息

print(df_analysis.describe())

7.2 数据可视化

结合matplotlib和seaborn等可视化库,可以创建各种图表,如折线图、散点图、直方图等,更直观地呈现数据分布和趋势。

import pandas as pd

import matplotlib.pyplot as plt

import seaborn as sns

# 读取csv文件

df_visualization = pd.read_csv('visualization_example.csv')

# 绘制散点图

sns.scatterplot(x='age', y='income', data=df_visualization)

plt.title('scatter plot of age vs income')

plt.show()

8. 性能优化和大数据处理

在处理大规模数据集时,性能可能成为一个重要问题。pandas提供了一些方法来优化性能,例如适当选择数据类型、使用分块处理等。

import pandas as pd

# 读取大规模csv文件,指定分块大小

chunk_size = 10000

df_large = pd.read_csv('large_example.csv', chunksize=chunk_size)

# 逐块处理数据

for chunk in df_large:

# 进行数据处理操作

process_chunk(chunk)

9. 数据处理中的时间序列操作

在实际的数据分析中,经常会遇到时间序列数据,如股票价格、气象数据等。pandas提供了丰富的时间序列操作功能,使得处理时间相关的数据变得更加方便。

9.1 日期解析和索引

pandas可以自动解析字符串格式的日期,并将其转换为datetime类型,方便后续的时间序列操作。同时,可以将日期作为数据框的索引。

import pandas as pd

# 读取包含日期列的csv文件,进行日期解析和设置索引

df_time_series = pd.read_csv('time_series_example.csv', parse_dates=['date'], index_col='date')

# 打印数据框的前几行

print(df_time_series.head())

9.2 时间范围生成

pandas提供了date_range函数,用于生成一段时间范围内的日期序列。这在创建时间序列数据框时非常有用。

import pandas as pd

# 生成一个包含日期范围的时间序列数据框

date_range = pd.date_range(start='2022-01-01', end='2022-01-10', freq='d')

df_time_range = pd.dataframe({'value': range(1, 11)}, index=date_range)

# 打印数据框

print(df_time_range)

9.3 时间重采样和滚动窗口

对时间序列进行重采样和滚动窗口计算是常见的操作。pandas提供了resample和rolling方法,方便进行时间频率的调整和窗口计算。

import pandas as pd

# 读取包含日期列的csv文件,进行日期解析和设置索引

df_resample = pd.read_csv('time_series_example.csv', parse_dates=['date'], index_col='date')

# 按月重采样,计算均值

df_monthly_mean = df_resample['value'].resample('m').mean()

# 使用滚动窗口计算移动平均值

df_rolling_mean = df_resample['value'].rolling(window=3).mean()

# 打印结果

print(df_monthly_mean)

print(df_rolling_mean)

10. 深入机器学习与数据挖掘

最后,作为数据处理的延伸,进一步深入机器学习和数据挖掘是提升数据分析能力的关键一步。pandas与scikit-learn等机器学习库无缝结合,为构建和评估模型提供了便利。

import pandas as pd

from sklearn.model_selection import train_test_split

from sklearn.ensemble import randomforestclassifier

from sklearn.metrics import accuracy_score

# 读取csv文件

df_ml = pd.read_csv('machine_learning_example.csv')

# 分割数据集为训练集和测试集

x = df_ml.drop('label', axis=1)

y = df_ml['label']

x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.2, random_state=42)

# 创建随机森林分类器

clf = randomforestclassifier(n_estimators=100, random_state=42)

# 训练模型

clf.fit(x_train, y_train)

# 预测并评估模型

y_pred = clf.predict(x_test)

accuracy = accuracy_score(y_test, y_pred)

# 打印准确率

print(f'model accuracy: {accuracy}')

总结

本文深入介绍了pandas在数据处理领域的关键功能,从文件读写到数据清洗、异常处理、时间序列操作、机器学习,覆盖了数据科学领域的多个方面。以下是本文的主要内容总结:

- 文件读写操作: 学习了pandas中的

read_csv和to_csv函数,掌握了它们的基本用法、参数解释,以及一些高级参数的应用。 - 数据清洗与处理: 演示了如何处理缺失值、进行数据清洗,并使用

query和replace等方法进行数据过滤和替换。 - 异常处理与日志记录: 强调了在实际项目中使用

try-except语句来处理异常,结合日志记录,提高代码的健壮性。 - 数据分析与可视化: 展示了如何使用pandas的统计函数获取数据的统计信息,并结合matplotlib和seaborn进行数据可视化。

- 时间序列操作: 演示了pandas对日期的解析和索引、时间范围生成、时间重采样和滚动窗口等时间序列操作。

- 机器学习与数据挖掘: 介绍了pandas与scikit-learn等机器学习库的结合,展示了数据集分割、模型训练和评估的全流程。

通过学习这些关键功能,读者将能够在数据处理和分析中更加熟练、灵活地应对各种挑战。同时,本文还提醒了读者关注异常处理和日志记录,以及在大数据处理时的性能优化方法。这些技能对于从事数据科学和相关领域的从业者具有重要价值。

以上就是pandas文件处理中read_csv和to_csv参数详解与实战指南的详细内容,更多关于pandas文件处理的资料请关注代码网其它相关文章!

发表评论